ai-assistent in beveiligingsonderzoek: navigeren door het dreigingslandschap

Definieer eerst wat een AI-assistent is. Een AI-assistent is een systeem dat mensen helpt door data te verwerken, suggesties te doen en repetitieve taken uit te voeren. Vervolgens levert een AI-assistent in beveiligingscontexten contextuele analyse, zoekfunctionaliteit en aanbevelingen tijdens een beveiligingsonderzoek. Hij kan logs parseren, gebeurtenissen taggen en relevant bewijs naar voren halen voor een analist. Bijvoorbeeld, een beveiligingsassistent die video en telemetrie ondersteunt helpt operators om sneller op bewijs gebaseerde beslissingen te nemen.

Daarnaast verandert het dreigingslandschap continu. Nieuwe beveiligingsdreigingen verschijnen snel. Kwaadwillenden gebruiken automatisering en geavanceerde tools. Daarom hebben menselijke teams schaalbare hulpmiddelen nodig om bij te blijven. AI-tools ondersteunen onderzoekers door patronen te zien in grote datasets die een enkele analist niet snel kan doorzoeken.

Data toont de groeiende afhankelijkheid van deze systemen. In onderzoeken gebruikt meer dan 60% van de professionals nu AI voor beveiligingsadvies tijdens ontwikkeling en incidentrespons, wat brede adoptie binnen teams weerspiegelt (60% gebruikt AI voor beveiligingsadvies). Tegelijkertijd is voorzichtigheid geboden. Een grote studie ontdekte dat 45% van de AI-antwoorden op beveiligingsvragen problemen bevatte, dus beoordeling blijft essentieel (45% van AI-antwoorden kan problemen bevatten).

Bovendien merkte een expert op dat “AI-assistenten de manier waarop beveiligingsteams dreigingsdetectie benaderen transformeren door realtime inzichten te bieden die eerder onmogelijk waren op schaal” (Akond Rahman). Dit citaat benadrukt zowel belofte als verantwoordelijkheid. In de praktijk moeten beveiligingsanalisten AI-uitvoer combineren met menselijke verificatie om misstappen te voorkomen.

Daarnaast introduceert dit hoofdstuk trefwoorden en mogelijkheden die u opnieuw zult tegenkomen. Een AI-assistent helpt bijvoorbeeld bij triage en snelle query-afhandeling. Hij ondersteunt natuurlijke taal en contextuele zoekopdrachten. Hij versterkt de beveiligingshouding door de tijd te verkorten die nodig is om kritische informatie te verzamelen. Ten slotte laat visionplatform.ai zien hoe on-prem AI-systemen controlekamers in staat stellen video te doorzoeken met natuurlijke taal en alarmen te verifiëren terwijl gegevens binnen de locatie blijven, wat compliance ondersteunt en onderzoeken versnelt (privacy- en compliancezorgen).

automatiseren van securityoperaties en alerts met ai

Allereerst automatiseren AI-gedreven tools routinematige securityoperaties. Ze parseren telemetrie en logs, correleren gebeurtenissen en geven een alert wanneer ze afwijkende patronen detecteren. Vervolgens integreren deze tools met SIEM-platforms om geverifieerde gebeurtenissen in bestaande securityoperaties te voeden. Bijvoorbeeld, veel teams sturen AI-geverifieerde bevindingen naar Splunk voor verdere correlatie en dashboarding. Dit verbetert de gemiddelde tijd tot triage en vermindert repetitieve taken voor beveiligingsanalisten.

Ook kan AI real-time alerting-workflows stroomlijnen. Een AI-platform neemt streams in, scoort gebeurtenissen en opent vervolgens een ticket met het contextuele bewijs. Daarna kan een beveiligingsanalist de geannoteerde tijdlijn bekijken, een korte forensische clip afspelen en actie ondernemen. Deze workflow maakt dat mensen zich kunnen richten op analyses met hogere toegevoegde waarde. Het vermindert ook false positives door meerdere signalen te controleren voordat een incident wordt gemarkeerd.

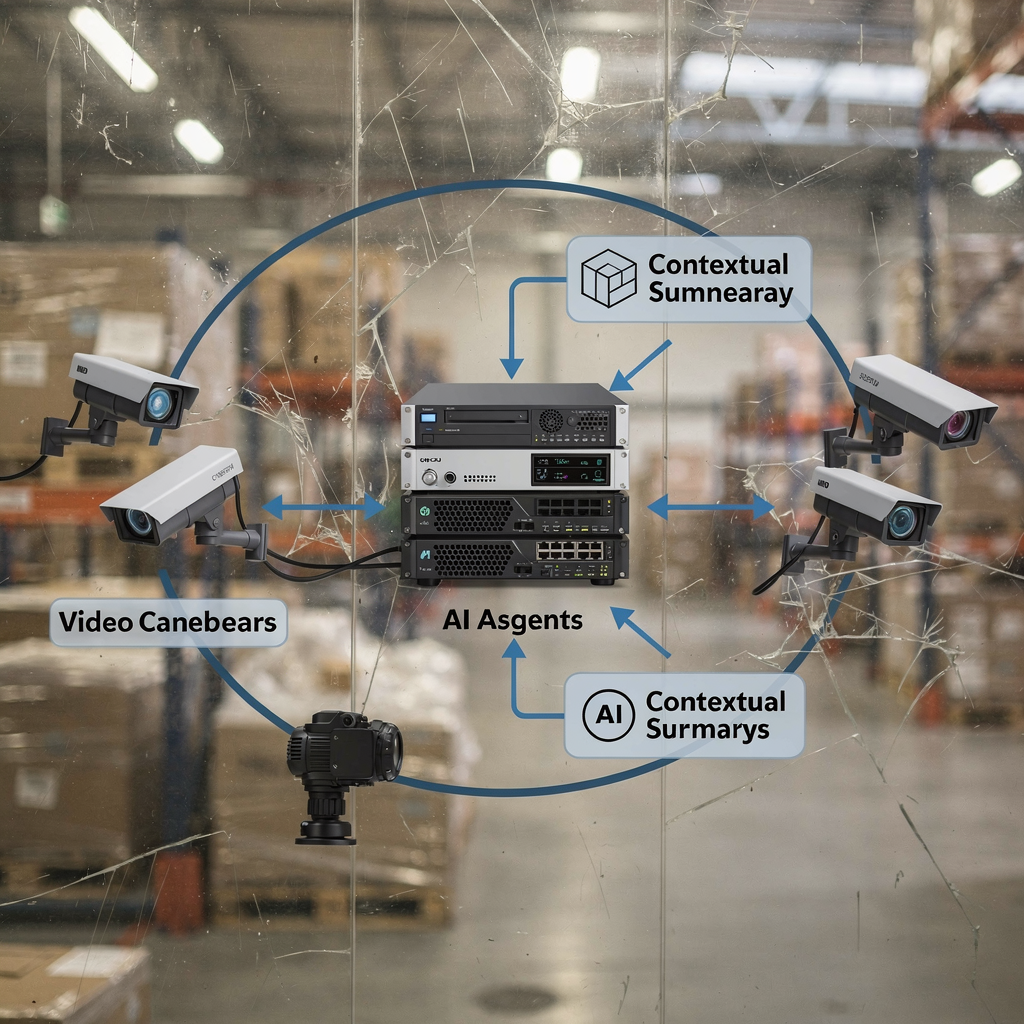

Data ondersteunt deze aanpak. In bedrijfsomgevingen hebben AI-gedreven monitoringtools de detectieratio’s met maximaal 30% verbeterd, wat onderzoekstijd en reactietijd verkort (tot 30% betere detectie). Daarnaast combineren leveranciers en teams nu AI-agents en LLM’s om contextuele samenvattingen te produceren, wat beslissingen verder versnelt.

Ook is alert fatigue een reëel probleem. Geautomatiseerde verificatie en prioritering helpen. Bijvoorbeeld kan een generatieve AI-beveiligingsassistent gebeurtenissen samenvatten en de meest waarschijnlijke oorzaak suggereren. Dit vermindert de belasting van het beveiligingsteam en verbetert de nauwkeurigheid. Een door AI aangedreven aanpak moet nog steeds governance en toegangscontroles respecteren. Daarom houden veel organisaties modellen op locatie of gebruiken hybride implementaties om gevoelige data te beschermen. visionplatform.ai, bijvoorbeeld, biedt een on-prem Vision Language Model dat video-evenementen uitlegt en agentische automatisering ondersteunt zonder video naar externe clouds te sturen.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Belangrijke use cases van ai-assistent om het beveiligingsteam te versnellen

Allereerst incidenttriage en prioritering. Een AI-assistent helpt ruisige alerts te filteren en de meest urgente beveiligingsincidenten te rangschikken. Hij controleert contextuele signalen, vergelijkt ze met eerdere incidenten en raadt aan welke items onmiddellijke aandacht nodig hebben. Deze triagestap verkort de onderzoekstijd en vermindert onderbroken workflows voor beveiligingsanalisten. Daardoor besteden mensen meer tijd aan complexe dreigingsanalyse in plaats van handmatig sorteren.

Ten tweede threat hunting en anomaliedetectie. AI-modellen vinden subtiele patronen en opkomende dreigingsactiviteit die regelgebaseerde tools missen. Ze scannen telemetrie, netwerkstromen en videobeschrijvingen om abnormaal gedrag te detecteren. Bijvoorbeeld, het combineren van videometadata met toegangslogs helpt het threat-intelligence-team misbruik van inloggegevens of insider-activiteit op te sporen.

Derde, digitale forensiek en bewijs-correlatie. AI assisteert bij logparsing, tijdlijnopbouw en cross-source correlatie. Forensische zoektools laten analisten query’s uitvoeren over video, VMS-metadata en logs. visionplatform.ai biedt forensisch zoeken dat opgenomen video en gebeurtenissen transformeert naar mensleesbare beschrijvingen zodat teams in gewone taal kunnen zoeken (forensisch onderzoek op luchthavens).

Ook, kwantificeer impact. Triagautomatisering kan de initiële beoordelingsduur met 40–60% verminderen in pilot-implementaties. Ondersteuning bij threat hunting kan de gemiddelde detectietijd met een vergelijkbare marge verlagen. Forensiek die AI-samenvattingen gebruikt verlaagt vaak de handmatige onderzoekstijd met uren per incident. Deze winst hangt af van de inrichting, gegevenskwaliteit en governance.

Tot slot, reduceer fouten. Een AI-geassisteerde workflow vermindert false positives en versnelt bevestigde respons. Deze use cases vertrouwen op zorgvuldige tuning en menselijk toezicht. In de praktijk adopteren teams AI-gestuurde assistenten geleidelijk. Ze beginnen met aanbevelingen, schakelen dan acties in en gaan later naar gecontroleerde automatisering. Deze gefaseerde aanpak beschermt het beveiligingsprogramma terwijl het duidelijk rendement op investering toont voor beveiligingscapaciteiten.

Beheren van beveiligingsdata in cloudbeveiliging en SaaS met ai

Allereerst zijn de uitdagingen van het omgaan met logs en telemetrie in multi-cloud en SaaS-omgevingen aanzienlijk. Logs komen in uiteenlopende formaten. Systemen genereren grote hoeveelheden telemetrie die handmatige beoordeling overweldigen. Daarnaast moeten cloudbeveiligingsteams snelheid afwegen tegen compliance. Regels over gegevensresidency, zoals de AVG, bemoeilijken grensoverschrijdende verwerking.

Vervolgens versnelt AI logparsing, correlatie en root-cause-analyse. Een model kan verschillende logs normaliseren, entiteiten taggen en gerelateerde gebeurtenissen koppelen. Daarna produceert het model een beknopte samenvatting en suggereert het volgende stappen. Dit stroomlijnt het proces en vermindert de tijd die wordt besteed aan het zoeken door ruwe bestanden. Het verbetert ook de onderzoeksnauwkeurigheid door context te koppelen die mensen mogelijk missen.

Ook zijn privacy en compliance belangrijk. Organisaties moeten beleid aannemen dat trainingsdata en modeluitvoer controleert. VeraSafe waarschuwt dat “de omgang met persoonlijke informatie door AI-systemen transparant en compliant met privacyregelgeving moet zijn” (VeraSafe over AI-privacy). Daarom kiezen veel teams voor on-prem oplossingen of private clouds voor gevoelige video en telemetrie. De on-prem aanpak van visionplatform.ai ondersteunt afstemming op de EU AI Act en voorkomt het verplaatsen van video offsite, wat teams helpt compliance te beheren in een multi-tenant wereld.

Verder vereisen SaaS-integraties zorgvuldige toegangscontrole. AI-agents moeten het least-privilege-principe volgen bij het verbinden met systemen. Bijvoorbeeld, het integreren van VMS-gegevens met een AI-platform moet retentiebeleid en audittrajecten respecteren. Gebruik gestructureerde exports, webhooks en getokeniseerde API’s om controle te houden. Daarnaast ondersteunt logging van AI-beslissingen en geautomatiseerde acties audits en helpt het verantwoordelijkheid in kaart te brengen wanneer incidenten zich voordoen.

Tot slot, adopteer praktijken om de beveiligingshouding te versterken. Valideer modellen met testdata. Volg datalijnage. En zet monitoring in voor model drift. Deze stappen verminderen risico’s en vergroten vertrouwen in AI-geassisteerde onderzoeken.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Bevoeg security-experts met ai voor proactieve beveiliging

Allereerst, gebruik AI voor voorspellende risicomodellering en vroege waarschuwingen. Modellen kunnen assets scoren op waarschijnlijke blootstelling, kwetsbare systemen markeren en voorspellen waar aanvallers mogelijk als volgende toeslaan. Dit helpt beveiligingsexperts prioriteiten te stellen voor patching en verdedigingsmaatregelen. Als gevolg daarvan verschuiven teams van reactieve naar proactieve beveiliging. De aanpak ondersteunt posture management over assets en cloudproviders heen.

Ook, verdedig AI-systemen tegen adversarial attacks en manipulatie. Aanvallers kunnen inputs vergiftigen of adversariale voorbeelden maken die modeluitvoer veranderen. Experts merken op dat het beveiligen van AI essentieel is om te voorkomen dat aanvallers beslissingsprocessen exploiteren (Aanvallen op AI). Daarom moeten teams integriteitschecks, input-sanitisatie en monitoring toevoegen voor verdacht modelgedrag.

Vervolgens, balanceer geautomatiseerd advies met menselijk oordeel. Een AI-assistent helpt bewijs naar voren te brengen en een handelwijze voor te stellen. Echter behouden beveiligingsexperts de autoriteit voor kritische keuzes. Dit human-in-the-loop-patroon vermindert risico’s van incorrecte modelaanbevelingen en behoudt auditbaarheid. Bijvoorbeeld kan een door AI aangedreven securityworkflow incidentrapporten automatisch invullen terwijl een mens vereist is om externe meldingen goed te keuren.

Ook, integreer domeinkennis. Threat intelligence en playbooks voeden modellen met contextuele regels. Een threat-intelligence-team kan gelabelde voorbeelden aanleveren om detectie te verbeteren. Daarnaast produceren tools die generatieve AI gebruiken begeleide analyses en samenvattingen die analisten helpen gerichte vragen in natuurlijke taal te stellen. Deze natuurlijke taalinteractie maakt onderzoeken toegankelijker en sneller.

Tot slot, governance is belangrijk. Stel beleid op voor modelupdates, toegangsbeheer en incidentlogging. Train beveiligingsanalisten om AI-uitvoer te valideren en modelvertrouwen te evalueren. Deze praktijken helpen teams weloverwogen beslissingen te nemen en de beveiliging in de hele organisatie te versterken.

AI benutten om securityoperaties te versnellen

Allereerst wijzen toekomstige trends op meer geavanceerde generatieve AI en integraties van grote taalmodellen in onderzoeken. Teams zullen LLM’s gebruiken om complexe tijdlijnen samen te vatten, voorgedefinieerde playbooks voor te stellen en incidentnarratieven te genereren. Daarnaast zullen agentische systemen meerdere AI-agents coördineren om multi-stap responsen te beheren. Deze mogelijkheden zullen onderzoeken en respons verder versnellen.

Vervolgens, pas best practices toe voor governance, validatie en continue verbetering. Pilot nieuwe mogelijkheden in een gecontroleerde omgeving. Meet dan de impact op mean time to detect en mean time to respond. Volg ook false positives en pas drempels aan. Deze governance vermindert risico’s en schaalt effectieve automatisering.

Ook, creëer een duidelijke roadmap voor geleidelijke adoptie: pilot, opschalen en impact meten. Begin met kleine use cases zoals e-mailtriage of logparsing. Breid daarna uit naar integratie van videoanalyse en SIEM-workflows. visionplatform.ai laat zien hoe on-prem VP Agent-functies een controlekamer kunnen brengen van ruwe detectie naar contextuele actie. Deze stapsgewijze aanpak stelt teams in staat AI-gestuurde workflows te adopteren terwijl data en operaties beschermd blijven.

Verder, combineer menselijke vaardigheden met AI-tools. Train beveiligingsanalisten om vragen in natuurlijke taal te stellen en begeleide analyses uit te voeren. Gebruik tools die kritische informatie naar voren brengen en uitvoerbare aanbevelingen geven. Dit hybride model levert sterkere beveiligingsmogelijkheden en helpt het beveiligingsprogramma volwassen te worden.

Tot slot, monitor het ecosysteem van dreigingen en kwetsbaarheden. Aanvallers evolueren snel. Daarom investeer in continu testen en red teaming van AI-hulpmiddelen. Houd ook transparantie en audittrails bij voor alle geautomatiseerde acties. Deze stappen helpen teams onderzoeken te versnellen, de beveiliging te versterken en de controle te behouden naarmate AI-technologieën zich ontwikkelen.

FAQ

Wat is een AI-assistent in een beveiligingsonderzoek?

Een AI-assistent is een hulpmiddel dat onderzoekers ondersteunt door data te analyseren, gebeurtenissen te correleren en vervolgstappen voor te stellen. Het versnelt taken zoals logparsing, bewijszoekopdrachten en prioritering van alerts, terwijl een mens betrokken blijft bij kritieke beslissingen.

Hoe betrouwbaar zijn AI-uitkomsten voor beveiligingsbeslissingen?

AI-uitkomsten kunnen zeer nuttig zijn maar zijn niet foutloos. Een grote studie toonde aan dat tot 45% van de AI-antwoorden op beveiligingsvragen problemen had, dus menselijke beoordeling en validatie blijven essentieel (studie).

Kan AI de onderzoekstijd verkorten?

Ja. AI verkort onderzoekstijd door triage te automatiseren, logs te correleren en relevant bewijs aan te dragen. Organisaties melden verbeteringen in detectieratio’s en verkorting van mean time to respond wanneer ze AI-geassisteerde workflows toepassen (detectieverbeteringen).

Hoe gaat AI om met cloudbeveiliging en SaaS-telemetrie?

AI normaliseert en correleert telemetrie uit multi-cloud en SaaS-bronnen om eenduidige tijdlijnen te creëren. Teams moeten zorgen voor gegevensresidency en privacy-compliance en bij voorkeur on-prem of hybride implementaties gebruiken voor gevoelige video of logs om te voldoen aan regelgeving zoals de AVG.

Wat zijn veelvoorkomende use cases voor AI in beveiliging?

Veelvoorkomende use cases zijn incidenttriage, threat hunting, anomaliedetectie, digitale forensiek en bewijs-correlatie. AI helpt ook bij het automatiseren van repetitieve workflows en het vooraf invullen van incidentrapporten om onderzoeken te versnellen.

Hoe moeten organisaties AI voor beveiliging besturen?

Governance vereist beleid voor modelupdates, data-toegang en auditlogging. Pilot functies eerst en schaal vervolgens met duidelijke metrics voor mean time to detect en false positives. Houd menselijke goedkeuring voor risicovolle acties.

Zijn AI-systemen kwetsbaar voor aanvallen?

Ja. AI-modellen kunnen te maken krijgen met adversariale inputs en poisoning-aanvallen. Experts adviseren integriteitschecks, inputvalidatie en monitoring van ongebruikelijk modelgedrag om risico’s te verminderen (aanvallen op AI).

Hoe integreren AI-assistenten met bestaande tools zoals SIEM of Splunk?

AI-assistenten integreren via API’s, webhooks en connectors om verrijkte alerts naar SIEMs of Splunk-dashboards te sturen. Ze leveren geannoteerde gebeurtenissen, contextueel bewijs en voorgestelde acties voor snellere respons.

Kan AI helpen bij videogebaseerde onderzoeken?

Ja. AI die on-prem vision language-modellen gebruikt kan video omzetten in doorzoekbare beschrijvingen en alarmen verifiëren met contextuele data. Bijvoorbeeld bieden forensische zoekfuncties operators de mogelijkheid incidenten te vinden met gewone zoekopdrachten en tijdlijnen (forensisch onderzoek op luchthavens).

Hoe begin ik met het adopteren van AI in mijn beveiligingsprogramma?

Begin klein met een pilot gericht op één use case, zoals triage of logparsing. Meet de impact, verfijn modellen en breid uit. Gebruik on-prem oplossingen wanneer dataprivacy of compliance een zorg is, en train beveiligingsanalisten om AI-uitvoer te valideren.