فهم التضمينات متعددة النمط للبحث الدلالي في تحليل الفيديو

أولاً، حدِّد الفرق بين البحث الدلالي في الفيديو والبحث القديم المعتمد على الكلمات المفتاحية. يفسّر البحث الدلالي للفيديو المعنى من المشاهد، والعناصر، والإجراءات. بالمقابل، تعتمد طرق الكلمات المفتاحية على الوسوم، أو أسماء الملفات، أو بيانات وصفية نادرة، لذا فهي تفوّت السياق. بعد ذلك، فكّر في كيفية تغيير التضمينات متعددة النمط لهذا الديناميكية. تجمع التضمينات متعددة النمط بين الإطارات البصرية، والمسارات الصوتية، والنصوص المنطوقة في فضاء متجهات مشترك. ثم يمكن لاستعلام واحد أن يطابق الإطارات والمقاطع والتعليقات التوضيحية عبر التشابه الدلالي. كنتيجة لذلك، يصبح الاسترجاع متعلقاً بالمعنى، وليس بالكلمات فقط.

أيضاً، تُحسّن هذه المقاربة الدقة. على سبيل المثال، أنظمة البحث الدلالي عن الفيديو تُبلغ عن مكاسب في الدقة بنسبة 30–40% مقارنة بقاعديات الكلمات المفتاحية في الدراسات الأكاديمية الميزة الدلالية – نظرة عامة | ScienceDirect Topics. في اختبارات على نطاق واسع، ارتفع متوسط الدقة الوسيط (mean average precision) من 0.55 إلى 0.78 على عشرة آلاف ساعة من اللقطات، مما يظهر فوائد واضحة لتحليل الفيديو على نطاق واسع أداة ذكاء اصطناعي جديدة تُظهر قوة البحث التتابعي. لذلك، الفرق التي تطبق التضمينات متعددة النمط ترى نتائج بحث أسرع وأكثر دقة وتقلص الوقت المستغرق في العثور على المقاطع ذات الصلة.

علاوة على ذلك، والأهم من ذلك، تدعم التضمينات متعددة النمط الاستعلام باللغة الطبيعية. يكتب المستخدم استعلاماً نصياً ويُرجع النظام مقاطع فيديو دقيقة حيث يظهر نفس المحتوى الدلالي. هذا يمكّن اكتشاف المحتوى عبر مكتبات الفيديو بأكملها، ويجعل البحث والاسترجاع يبدو إنسانياً. لأغراض المراقبة والعمليات، تستخدم visionplatform.ai نموذج لغة بصري محلي لتحويل الفيديو إلى أوصاف نصية لهذا الغرض بالذات. على سبيل المثال، يستفيد البحث الجنائي في المطارات من هذه المقاربة لأن المحققين يمكنهم البحث في الأوصاف بدلاً من معرفات الكاميرا أو البيانات الوصفية الخام البحث الجنائي في المطارات. أخيراً، تقلل التضمينات متعددة النمط من الإيجابيات الخاطئة في أنابيب الكشف لأن التشابه يُحكم عليه في فضاء ترميز يلتقط المعنى الدلالي والعلاقات السياقية.

توليد التضمينات والتمثيلات المتجهية باستخدام نموذج التضمين والذكاء الاصطناعي

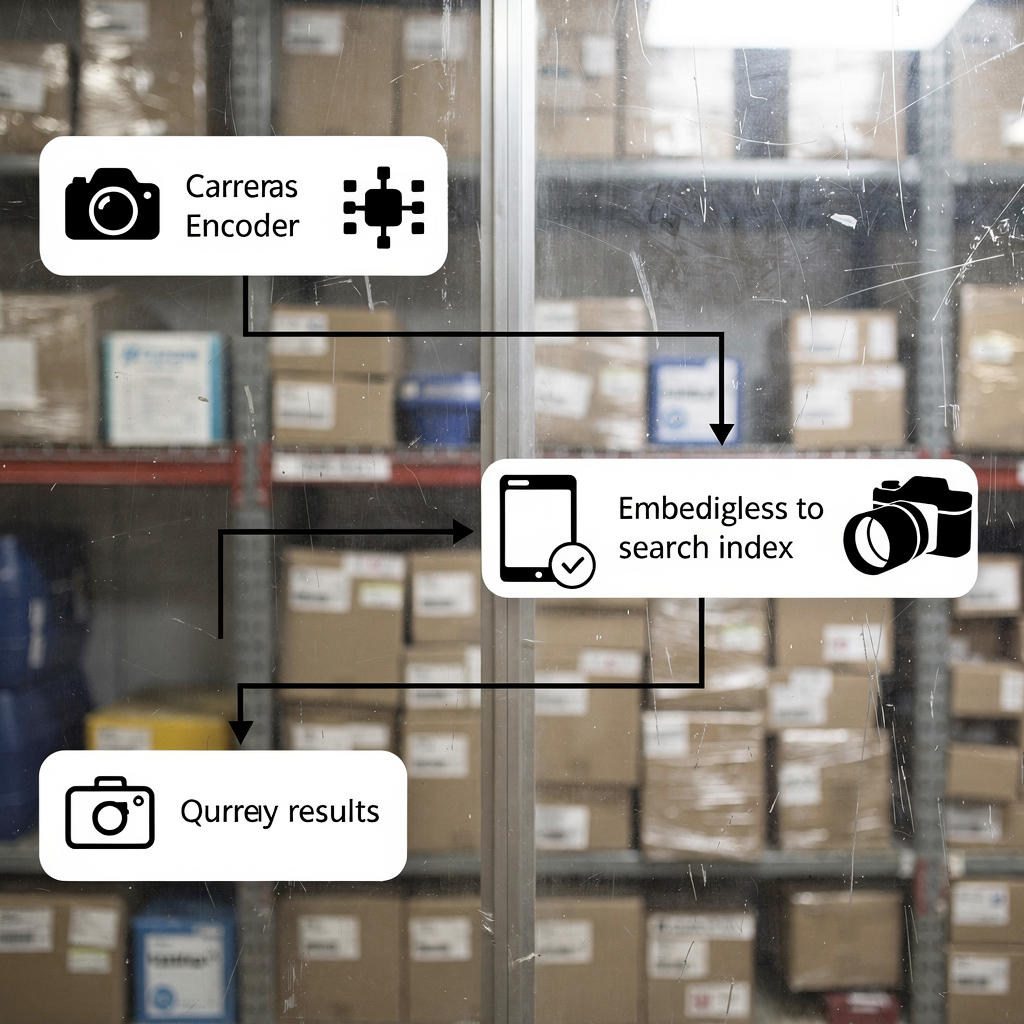

أولاً، اشرح كيفية توليد التضمينات من الفيديو. تُقسّم ملفات الفيديو أولاً إلى إطارات ومقاطع صوتية. ثم تُمرر الإطارات عبر مُشفّر بصري قائم على الالتفاف أو الترانسفورمر. بعد ذلك، يُنصّخ الصوت وتُشفّر مخططات الطيف الخاصة به. كما تُحوَّل النصوص المنطوقة إلى متجهات تضمين نصية. أخيراً، تُدمَج التضمينات من كل نمط في متجه متعدد النمط واحد يمثل مقطع الفيديو. تتيح هذه العملية مطابقة استعلام نصي مع المحتوى البصري والصوتي عبر التشابه.

ثانياً، صف فهرسة المتجهات للبحث السريع بالتشابه. تُخزن المتجهات في فهرس مثل Faiss أو فهرس متجهات OpenSearch لإجراء بحث k-nn. تخلق الفهرسة تمثيلات مدمجة قابلة للبحث بحيث تعيد الاستعلامات مقاطع الفيديو المطابقة في غضون أجزاء من الثانية. في الممارسة العملية، يُنتج بحث المتجهات كلّاً من نتائج الجار الأقرب الدقيقة والتقريبية. لذلك، توازن الأنظمة بين الاستدعاء والكمون. على سبيل المثال، تعمل خوارزميات البحث التتابعي على تنقيح النتائج بشكل تكراري باستخدام الضربات السابقة لتحسين الاسترجاع، كما هو موضح في أبحاث المقاييس أداة ذكاء اصطناعي جديدة تُظهر قوة البحث التتابعي.

ثالثاً، بيّن كيف تتعلم نماذج الترانسفورمر السياق من أجل استرجاع أفضل. تلتقط الترانسفورمرات الاعتمادات طويلة المدى عبر الإطارات والكلمات. تتعلم ترميز الأفعال، وتغيرات المشهد، ونوايا الممثلين في فضاء التضمين. وبالتالي، تُرجِع عمليات البحث التي تستخدم استعلاماً باللغة الطبيعية مقاطع فيديو ذات صلة حتى عند غياب الكلمات المفتاحية الدقيقة. هذا ضروري للفيديو الذكي والتحقيقات الآلية. بالنسبة لفرق المراقبة التي تستخدم visionplatform.ai، يحول نموذج اللغة البصرية الاكتشافات الخام إلى أوصاف قابلة للبحث، وتتReasoning الوكلاء بالذكاء الاصطناعي عبر تلك التضمينات لمساعدة المشغلين. باختصار، توليد التضمينات، وبناء فهرس متجهات، ثم تشغيل مطابقة التشابه لتنفيذ بحث دلالي قوي واسترجاع.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

بناء نموذج التضمين بأدوات مفتوحة المصدر على AWS وAmazon SageMaker

أولاً، قارن المكتبات والأدوات. استخدم Faiss للفهرسة ANN عالية الأداء وHugging Face للوصول إلى النماذج. يوفر Faiss k-nn مسرّعاً على GPU وتكمية متجهات مرنة. يجلب Hugging Face نماذج ترانسفورمر مسبقة التدريب يمكن تحسينها لمهام الفيديو. أيضاً، تدعم الأدوات المفتوحة المصدر خطوط أنابيب قابلة للتكرار وتتجنب الحبس مع مزود واحد. للفرق التي تفضّل خدمات مُدارة، توفر AWS البنية التحتية وتكاملات MLOps التي تُبسّط التدريب والنشر.

ثانياً، خطط خطوط التدريب على AWS EC2 وAmazon SageMaker. ابدأ بتحضير البيانات على Amazon S3 حيث تعيش بيانات الفيديو والبيانات الوصفية. ثم شغّل مثيلات EC2 مزوّدة بـ GPU للتدريب الأولي واسع النطاق أو التحسين الدقيق. بدلاً من ذلك، استخدم Amazon SageMaker للتدريب الموزع مع مثيلات spot مُدارة وضبط معلمات فائق مدمج. تُؤتمت SageMaker pipelines إصدار نسخ البيانات، والتدريب، والتقييم. بعد التدريب، صدّر نموذج التضمين وقطع التسجيل. تدعم هذه الخطوة حوكمة النموذج وإمكانية التكرار. لأولئك الراغبين في مسار استدلال مُدار، انشر النماذج على نقاط نهاية Amazon SageMaker وقم بموازنتها تلقائياً خلف بوابة API.

ثالثاً، تعرّض نشر النقاط النهائية والموازنة التلقائية. انشر حاويات نماذج التضمين على SageMaker أو باستخدام ECS مع مثيلات مدعومة بـ GPU. قم بتكوين قواعد الموازنة التلقائية استناداً إلى زمن استجابة الطلبات واستخدام CPU/GPU. أيضاً، استخدم مراقبة النموذج لاكتشاف الانحراف وتحفيز مهام إعادة التدريب. للامتثال الصارم ومحاذاة قانون الاتحاد الأوروبي للذكاء الاصطناعي، يحتفظ العديد من الفرق بالنماذج محلياً أو يستخدمون نشرات هجينة. تدعم visionplatform.ai نشر نموذج لغة بصرية محلي بحيث تبقى الفيديوهات والنماذج والقدرات الاستنتاجية داخل بيئة العميل. أخيراً، ضع في الاعتبار المقايضات بين التكلفة والإنتاجية واختر جداول تدريب تقلل الانقطاعات في مثيلات spot مع تعظيم جودة النموذج.

التضمين والفهرسة للبحث متعدد النمط الفوري في OpenSearch Serverless

أولاً، اعرض كيفية تضمين ميزات الفيديو والبيانات الوصفية في OpenSearch. استخرج التضمينات البصرية والنصية لكل مقطع مؤرخ زمنياً. ثم خزّن المتجهات جنباً إلى جنب مع بيانات تعريف الكاميرا، ومعرّفات الكاميرا، والطوابع الزمنية في فهرس متجه opensearch. هذا يمكّن البحث داخل كتلة واحدة ويجعل استرجاع مقاطع الفيديو ذات الصلة أمراً مباشراً. استخدم حجم تضمين ثابت لتحسين أداء الفهرس ومعدل استجابة الاستعلامات. عملياً، يخزن المهندسون كلّاً من البيانات الوصفية الخام والمتجهات لدعم ترتيب هجيني يوازن بين صلة النص وتشابه المتجه.

ثانياً، قم بتكوين الإدخال في الزمن الحقيقي وبحث المتجه في بيئة بدون خادم. يقبل Amazon OpenSearch Serverless واجهات برمجة تطبيقات الإدخال الجماعي ويدعم الفهرسة شبه اللحظية. استخدم Lambda أو مستهلكات حاويات لدفع التضمينات من المشفرات الحية إلى الفهرس. ثم يمكن لاستعلامات لوحات المشغل تشغيل بحث المتجه مع عوامل تصفية k-nn وقيود بوليانية. تدعم هذه البنية وقت استجابة منخفض للبحث الجنائي والتنبيهات الآلية. كما تدعم الاستعلامات المختلطة، حيث يتم دمج استعلام نصي مع عوامل تصفية بيانات وصفية مثل منطقة الكاميرا أو نافذة زمنية. لتطبيقات المراقبة، تسرّع مثل هذه القدرات التحقيقات وتقلل وقت الحصول على الأدلة.

ثالثاً، أبرز مقاييس الكمون وكفاءة التكلفة. في المقاييس، تُعيد خطوط أنابيب المتجهات المحسّنة جيداً النتائج في أقل من 200 ms لوسيط الاستعلامات عند مقياس معتدل. أيضاً، يقلّل البحث الدلالي عن الفيديو في كثير من الأحيان أوقات البحث بنحو 25%، مما يقلص عبء عمل المشغلين مباشرةً بناء تحليلات وكيلية باستخدام العروض الدلالية – Snowflake. علاوة على ذلك، تُقلّل الخيارات بدون خادم العبء التشغيلي وتتمدد تلقائياً مع حمل الاستعلامات. للفرق التي تحتاج سيطرة كلية، تجمع الإعدادات الهجينة بين مشفرات محلية وAmazon OpenSearch Serverless للفهرسة. النتيجة هي بحث وتحليل سريع وفعال من حيث التكلفة عبر مكتبات فيديو ضخمة.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

حالة استخدام: تحليل الفيديو بدعم الذكاء الاصطناعي والبحث الدلالي للمراقبة والإعلام

أولاً، قدّم سيناريو مراقبة. يحتاج المشغل إلى العثور على كل حالة “شخص يتسكع قرب البوابة بعد ساعات العمل”. يستقبل النظام الفيديو ويشغّل نماذج الكشف لإنتاج أحداث. ثم يحول نموذج لغة بصري الاكتشافات إلى أوصاف نصية وتضمينات. أخيراً، يُرجع استعلام نصي واحد الطوابع الزمنية ومقاطع الفيديو التي تطابق السلوك. تقلّل هذه سير العمل من الفرز اليدوي وتدعم جمع الأدلة. للمطارات والمواقع الآمنة، ترتبط ميزات مثل كشف التسكع وكشف التسلل طبيعياً بسير عمل الحوادث الأوسع كشف التسكع في المطارات وكشف التسلل في المطارات.

ثانياً، أظهر مكاسب إنتاج الوسائط. يبحث المحررون عبر ساعات من اللقطات الأولية للعثور على إيماءة أو لقطة محددة. يقدم البحث الدلالي للفيديو المقاطع الصحيحة دون الاعتماد على بيانات وصفية غير كاملة. في التجارب، أبلغت الفرق عن تقليل وقت البحث بنحو 25% بناء تحليلات وكيلية باستخدام العروض الدلالية – Snowflake. كنتيجة لذلك، تضغط جداول الإنتاج وتتسارع القرارات الإبداعية. كما يدمج المحررون استعلامات نصية مع بحث تشابه بصري للعثور على لقطات B-roll المطابقة.

ثالثاً، قوّم الأثر التجاري. استخدم متوسط الدقة الوسيط (mean average precision) لقياس جودة الاسترجاع. أظهرت المقاييس تحسينات mAP من 0.55 إلى 0.78 على مجموعات بيانات فيديو كبيرة، مما يدل على استرجاع أكثر دقة للمقاطع ذات الصلة أداة ذكاء اصطناعي جديدة تُظهر قوة البحث التتابعي. أيضاً، تُقلّل أنظمة البحث الدلالي الوقت المستغرق لكل تحقيق وتحسن رضا المستخدم. للممارسين، يُترجم ذلك إلى خفض تكاليف العمالة وتسريع حل الحوادث. تُقدّم visionplatform.ai هذه القدرات في غرفة تحكم مدعومة بالذكاء الاصطناعي حتى يتمكن الفرق من العثور بسرعة على الفيديو ذي الصلة، والتحقق من الإنذارات، والتصرف بثقة.

سير النشر مع GitHub: استخدم الذكاء الاصطناعي متعدد النمط على نطاق واسع

أولاً، حدِّد سير عمل CI/CD للنماذج والفهارس. استخدم GitHub لإصدار الشيفرة والنماذج. خزّن خطوط التدريب، وملفات المعالجة المسبقة، ومنطق الوسم في المستودعات. ثم نفّذ اختبارات آلية تتحقق من جودة التضمين واتساق الفهرس. بعد ذلك، بنِ GitHub Actions التي تُطلق عمليات التدريب، وتعبئة النماذج، وبناء الحاويات. أيضاً، أنشئ سجلّاً لقطع نماذج التضمين ولقطات مجموعات البيانات لضمان التكرار. تدعم هذه المقاربة إمكانية المراجعة والنشر المُتحكم فيه للنماذج الجديدة.

ثانياً، دمج نشرات OpenSearch Serverless عبر Terraform أو AWS CDK. استخدم IaC لتوفير موارد فهرس المتجهات في opensearch ومجموعات الأمان وخطوط أنابيب الإدخال. ثم اربط خطوط نشر لدفع خرائط الفهرس وسياسات دورة الحياة تلقائياً. للبيئات التي تحتاج حوكمة قوية، أضف بوابات موافقة يدوية في GitHub Actions لمراجعة تغييرات مخطط الفهرس قبل نشرها. بالإضافة إلى ذلك، تضمّن مقاييس قياسية آلية تُنفّذ بعد النشر لتتبع الكمون وmAP على مجموعة تحقق.

ثالثاً، حدِّد المراقبة، خطوط الأنابيب متعددة النمط، والتحسينات. راقب زمن استجابة الاستعلام، وحجم الفهرس، وانحراف النموذج. أيضاً، تتبّع التضمينات المولّدة في الساعة وتوزيع أحجام التضمين. استخدم المقاييس لتحفيز إعادة التدريب عند انخفاض الأداء. للتحسين المستمر، دمج التعلم النشط حيث يُعلّم المشغلون الإيجابيات الخاطئة ويعيدون تغذية تلك البيانات في تحديثات النموذج. تدعم visionplatform.ai هذا النوع من الحلقة من خلال كشف بيانات VMS وتدفقات الأحداث للاستدلال المهيكل وإعادة التدريب. أخيراً، خطط لتحسينات مستقبلية مثل التكامل مع amazon bedrock لاستضافة النماذج المُدارة أو مع amazon titan للتضمينات متعددة النمط للنمذجة السريعة للنماذج متعددة النمط على أمازون. تجعل هذه التكاملات تنفيذ قدرات بحث الفيديو على نطاق أوسع أسهل مع الحفاظ على السيطرة على اللقطات الحساسة.

الأسئلة الشائعة

ما هو البحث الدلالي في الفيديو وكيف يختلف عن البحث المعتمد على الكلمات المفتاحية؟

يفسّر البحث الدلالي في الفيديو معنى المشاهد والإجراءات والعناصر بدلاً من المطابقة على الكلمات الحرفية فقط. يستخدم التضمينات لربط استعلامات النص بالمحتوى البصري والصوتي، لذا تعيد عمليات البحث مقاطع فيديو ذات صلة حتى عند غياب الكلمات المفتاحية.

كيف تعمل التضمينات متعددة النمط للفيديو؟

تجمع التضمينات متعددة النمط التشفيرات البصرية والصوتية والنصية في تمثيل متجه مشترك. يلتقط المتجه المدمج السياق عبر النمطين، مما يمكّن استعلام نصي واحد من استرجاع المقاطع الزمنية ومقاطع الفيديو المطابقة.

ما هي أدوات المصدر المفتوح المفيدة لبناء خطوط أنابيب التضمين؟

Faiss شائع للفهرسة ANN وHugging Face يوفر ترانسفورمرات مدربة مسبقاً للتشفير. يتكامل كلاهما بشكل جيد مع التدريب والاستدلال على AWS، ويدعمان تقنيات متقدمة للبحث الدلالي.

هل يمكن بناء بحث في الزمن الحقيقي باستخدام OpenSearch Serverless؟

نعم. يمكن لـ OpenSearch Serverless فهرسة المتجهات وتقديم استعلامات k-nn في شبه الزمن الحقيقي عند اقترانها مع خطوط أنابيب الإدخال. هذا يمكّن المشغلين من البحث داخل اللقطات الحية والمسجلة بزمن استجابة منخفض.

كم يحسن البحث الدلالي في الفيديو دقة الاسترجاع؟

تُظهر المقاييس مكاسب في الدقة بنسبة 30–40% مقابل طرق الكلمات المفتاحية، وتحسينات mAP من 0.55 إلى 0.78 على مجموعات بيانات كبيرة الميزة الدلالية – نظرة عامة | ScienceDirect Topics. تقلّل هذه المكاسب وقت البحث اليدوي وتزيد الرضا.

ما هي أنماط النشر الشائعة على AWS؟

تستخدم الفرق EC2 للتدريب الثقيل المسبق، وAmazon SageMaker للتدريب والنقاط النهاية المُدارة، وAmazon OpenSearch Serverless لفهرسة المتجهات. تربط IaC عبر Terraform أو AWS CDK الأجزاء معاً في خطوط CI/CD على GitHub.

كيف تتناسب visionplatform.ai مع البحث الدلالي في الفيديو؟

تحول visionplatform.ai الاكتشافات إلى أوصاف مقروءة بشرياً عبر نموذج لغة بصري محلي وتعرض تلك الأوصاف للبحث الجنائي والاستدلال. يدعم هذا التحقق السريع وتقليل الإيجابيات الخاطئة مع إبقاء البيانات داخل بيئات العملاء.

هل يمكن أن يساعد البحث الدلالي في الفيديو في إنتاج الوسائط؟

نعم. يجد المحررون المقاطع ذات الصلة أسرع لأن البحث يستخدم المعنى والتشابه، وليس الوسوم فقط. أظهرت التجارب تقليص أوقات البحث بحوالي 25% في سير العمل الإنتاجي بناء تحليلات وكيلية باستخدام العروض الدلالية – Snowflake.

ما هي مخاوف الخصوصية أو الامتثال الشائعة، وكيف يتم التعامل معها؟

تنشأ مخاوف الخصوصية عندما يغادر الفيديو والبيانات الوصفية البيئات المؤمنة. لمواجهة ذلك، انشر النماذج محلياً واحتفظ بالفيديو في دلاء خاصة. تدعم visionplatform.ai عمليات النشر المحلية ومحاذاة قانون الاتحاد الأوروبي للذكاء الاصطناعي لتقليل تعرض البيانات.

كيف أبدأ بتنفيذ البحث الدلالي في الفيديو في مؤسستي؟

ابدأ بمشروع تجريبي: اختر مجموعة بيانات، ولّد التضمينات، وبنِ فهرس متجه صغير. ثم أجرِ تجارب مستخدمين لقياس mAP والكمون. استخدم تلك النتائج لتوسيع نطاق التدريب والاستثمار في أتمتة الإدخال وCI/CD مع GitHub.