las últimas noticias

Búsqueda forense de vídeo para salas de control

Investigaciones forenses y vigilancia por vídeo en salas de control Las salas de control son el centro neurálgico de muchas investigaciones forenses modernas. Recogen señales en directo y grabadas de CCTV, sistemas de control de accesos, sensores y dispositivos inteligentes. Como resultado, los operadores ven pantallas situacionales consolidadas y pueden coordinar las respuestas. La centralización […]

Software de búsqueda de video forense

software de búsqueda forense: unificar flujos de videovigilancia Los sistemas forenses modernos deben unificar feeds fragmentados, y deben hacerlo con rapidez. Muchos emplazamientos usan cámaras de varios fabricantes, y cada flujo de cámara viene en formatos distintos. Los equipos forenses se enfrentan a redes de cámaras aisladas, VMS incompatibles y registros independientes que ralentizan una […]

Modelos de visión y lenguaje para la detección forense de anomalías en vídeo

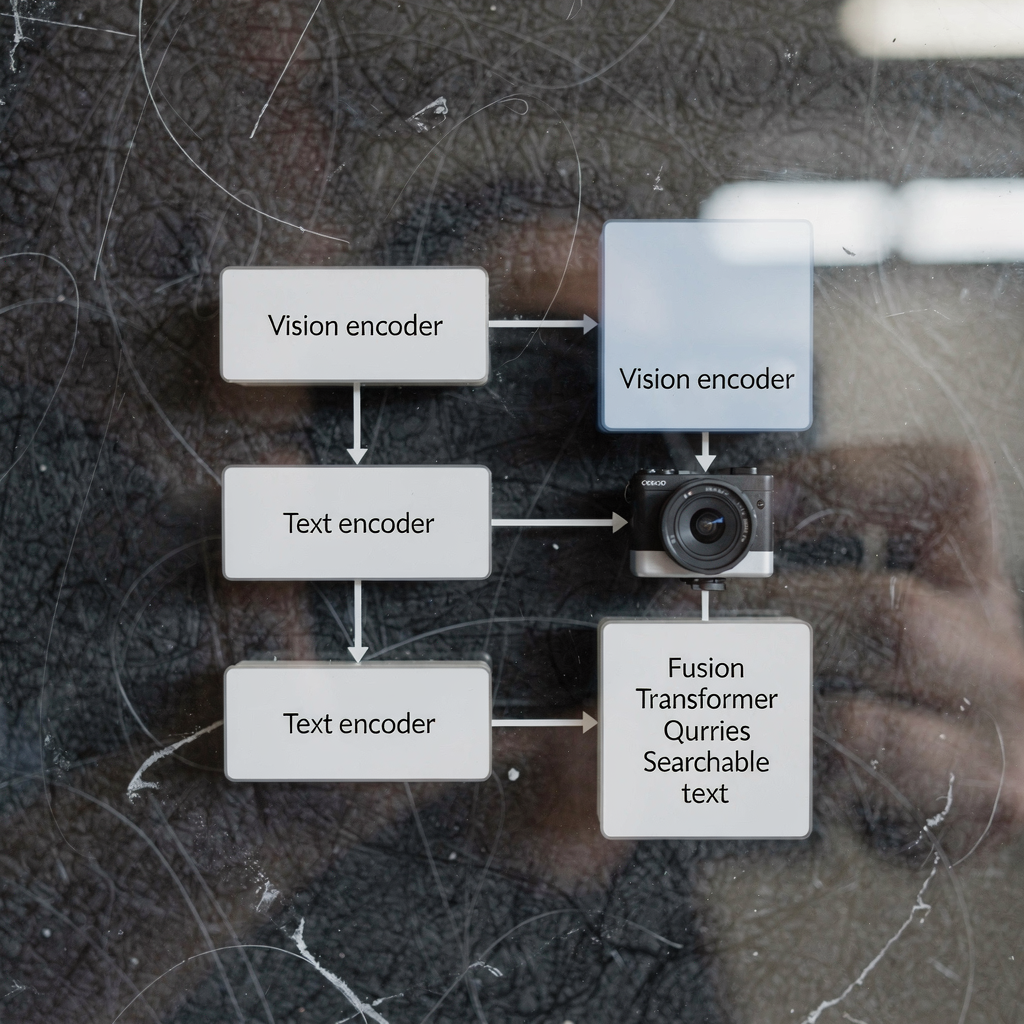

Modelos visión-lenguaje Los modelos visión-lenguaje presentan una nueva forma de procesar imágenes o vídeos y texto juntos. Primero, combinan codificadores de visión por computadora con codificadores de lenguaje. A continuación, fusionan esas representaciones en un espacio latente compartido para que un único sistema pueda razonar sobre señales visuales y lenguaje humano. En el contexto de […]

Modelos de lenguaje visual para Milestone XProtect

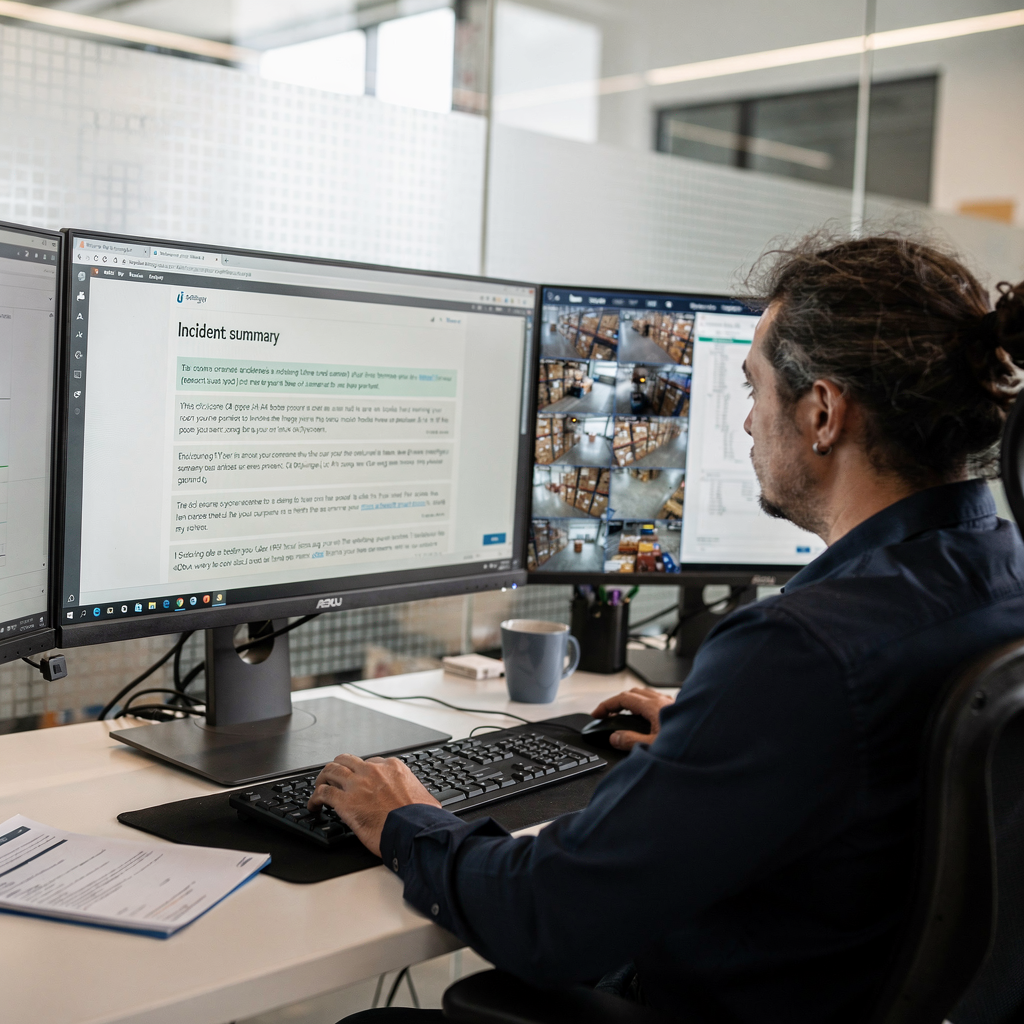

el modelo de lenguaje visual resume horas de grabación en texto conciso con IA generativa La tecnología de modelos de lenguaje visual convierte largas líneas de tiempo de vídeo en narrativas de incidentes legibles, y este cambio importa para los equipos reales. Además, estos sistemas combinan el procesamiento de imágenes y lenguaje para crear descripciones […]

Modelos de visión y lenguaje para la integración de VMS con VLMS

modelo de lenguaje y modelo visión-lenguaje: introducción Un modelo de lenguaje predice texto. En contextos VMS, un modelo de lenguaje asigna palabras, frases y comandos a probabilidades y acciones. Un modelo visión-lenguaje añade visión a esa capacidad. Combina entradas visuales con razonamiento textual para que los operadores de VMS puedan hacer preguntas y recibir descripciones […]

Modelos de visión y lenguaje de IA para análisis de vigilancia

Sistemas de IA e IA agentiva en la gestión de video Los sistemas de IA ahora configuran la gestión moderna de video. Primero, ingieren las fuentes de video y las enriquecen con metadatos. A continuación, ayudan a los operadores a decidir qué es importante. En entornos de seguridad, la IA agentiva lleva esas decisiones más […]