AI-videozoek: basisprincipes van gebeurtenisgestuurde videoanalyse in videobewaking

Gebeurtenisgestuurde CCTV-zoekopdrachten veranderen de manier waarop teams omgaan met grote hoeveelheden beeldmateriaal. AI-videozoek indexeert fragmenten op basis van gebeurtenissen, niet op tijd. Deze benadering vervangt langzaam handmatig doorzoeken door snelle, gerichte terugvinding. Traditionele videobeoordeling dwong operatoren om uren aan beeldmateriaal te bekijken. Daarentegen halen gebeurtenisgestuurde systemen betekenis uit beelden, taggen incidenten en maken opgenomen video binnen enkele seconden doorzoekbaar. Het resultaat transformeert reactie- en casemanagement voor veiligheids- en beveiligingsoperaties. Daarnaast gebruiken AI-systemen deep learning en leermodellen om gestructureerde beschrijvingen van personen of objecten te creëren. Bijvoorbeeld, moderne objectdetectie en vision-AI kunnen objectklassen labelen, personen of objecten identificeren en specifieke gebeurtenissen markeren zonder menselijke beoordeling. Daardoor vinden onderzoekers direct relevante beelden en relevante fragmenten, wat onderzoekers helpt en menselijke fouten vermindert.

De kerncomponenten omvatten detectiemotoren, metadata-extractors, indexeringsdiensten en een zoekinterface. AI verzorgt detectie en beschrijving. Vervolgens slaat metadata attributen op zoals tijd, locatie, object_class en gedrag. De metadata maakt videogegevens doorzoekbaar en stelt gebruikers in staat het archief te doorzoeken met natuurlijke taal. Met ai smart search kunnen operatoren een gewone-Engelse zoekopdracht typen en precieze treffers krijgen over camerastromen heen. Deze door AI aangedreven zoekfunctie verkort de tijd per alarm en versnelt inspecties. Voor luchthavens en enterprise video-implementaties is het gebruikelijk AI te koppelen aan video management systemen voor betrouwbare werking. visionplatform.ai bouwt voort op dit principe door een redeneellaag toe te voegen die detecties omzet in operationele inzichten en besluitvormingsondersteuning.

Gebeurtenisgestuurde indexering versnelt beveiligingsoperaties in verschillende use cases. Voor beveiligingsteams maakt het snelle verificatie van dreigingen mogelijk en exporteerbaar bewijs voor opsporingsinstanties. Voor operations ondersteunt het toegangcontrole-audits en detectie van procesanomalieën. Voor verkeersmonitoring verminderen kentekenherkenning en voertuigtracking de onderzoekstijd. Studies tonen aan dat intelligente systemen detectiepercentages kunnen verbeteren maar nog steeds problemen hebben bij nachtelijke scènes; bijvoorbeeld meldde een verkeersmonitoringsysteem 56,7% nauwkeurigheid in moeilijke nachtomstandigheden, wat duidt op een behoefte aan synthetische data en verbeterde modellen (56,7% nauwkeurigheid in nachtelijke scènes). Over het algemeen zet gebeurtenisgestuurde zoekopdracht video om in doorzoekbare, bruikbare inlichtingen terwijl alarmmoeheid wordt verminderd en grote hoeveelheden opgenomen beeldmateriaal weer nuttig worden.

Het integreren van metadata en objectdetectie over camera’s in VMS

Metadata-tagging en objectdetectie werken samen om fragmenten te indexeren zodat operatoren snel specifieke gebeurtenissen kunnen vinden. Eerst identificeert objectdetectie personen, voertuigen en andere doelwitten. Vervolgens legt metadata attributen vast zoals kleur, richting, gedrag en kentekentekst. Daarna indexeert het VMS die tags zodat gebruikers het archief kunnen doorzoeken. In de praktijk streamt een moderne video management system-opstelling events van camera-analytics en slaat compacte metadata op in plaats van ruwe beelden. Deze benadering schaalt beter en verlaagt kosten terwijl de mogelijkheid behouden blijft om ruwe beelden opnieuw te openen wanneer dat nodig is. Forensisch zoeken profiteert omdat alleen relevante fragmenten worden opgehaald voor gedetailleerde beoordeling en bewijsexport.

Het koppelen van meerdere camerastromen creëert een uniforme zoekfunctie over een locatie heen. Een cross-camera workflow stelt operatoren in staat een persoon te traceren over camerasystemen en een tijdlijn van acties op te bouwen. Bijvoorbeeld kan een medewerker zoeken naar iemand die rond een toegangspoort staat te wachten en die persoon vervolgens automatisch volgen over meerdere camerazichten. Deze cross-camera correlatie helpt alarmen te verifiëren en vermindert valse positieven. visionplatform.ai ondersteunt deze workflows met een VP Agent die VMS-gegevens blootstelt en video omzet in mensleesbare beschrijvingen zodat gebruikers kunnen zoeken zonder camera-ID’s. Meer over rondhangen-detectie en hoe deze integreert, vindt u op onze pagina over rondhangen-detectie op luchthavens.

VMS-eisen voor naadloze metadata-uitwisseling omvatten open API’s, gestandaardiseerde evenementenschema’s en ondersteuning voor MQTT of webhooks. Daarnaast moeten systemen bidirectionele controle toestaan zodat AI een incident kan markeren en het VMS kan terugroepen voor het ophalen van opgenomen beelden. Integratie met toegangbeheer en case management-systemen voegt context toe voor besluitvorming. Voor degenen die op schaal uitrollen, overweeg compatibiliteit met derdepartijplatforms zoals Genetec Security Center voor centrale rapportage en uniforme dashboards (forensisch onderzoek op luchthavens). Ten slotte dient u te zorgen dat het VMS en de AI-modules data-localiteit behouden indien naleving verwerking op locatie vereist. Dit behoudt privacy en voldoet aan de EU AI Act voor gevoelige locaties.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Optimaliseren van AI-gestuurde meldingen en detectie om onderzoeken te versnellen

AI-gestuurde meldingen veranderen de manier waarop teams reageren op incidenten. In plaats van ruwe alarmen ontvangen operatoren geverifieerde, toegelichte meldingen die context en betrouwbaarheidscores bevatten. Bijvoorbeeld kan een melding een perimeterinbraak melden, videothumbnails bevatten en bijbehorende toegangcontrole-logs opsommen. Dit maakt elke notificatie actiegericht en vermindert de tijd die nodig is voor triage. De VP Agent Reasoning van visionplatform.ai verifieert alarmen door VMS-events, metadata en procedurele controles te correleren, wat onderzoekers helpt en valse positieven verlaagt.

Detectieregels omvatten rondhangen, perimeterinbraak, inbraak en achtergelaten-object-scenario’s. Wanneer een systeem een persoon detecteert die rond een beveiligde ingang blijft hangen, triggert het een melding en slaat het event op als doorzoekbare metadata. Dat event wordt onderdeel van de forensische zoekindex zodat gebruikers later naar vergelijkbare incidenten kunnen zoeken. Voor kentekenworkflows kan de detectie van een kenteken vergelijken met watchlists en voertuigen van belang direct markeren. Studies tonen aan dat multi-camera IVS-systemen eventdetectie verbeteren en slimmer stadsinfrastructuur ondersteunen (voordelen van netwerkcamera's).

Het kwantificeren van impact: geautomatiseerde meldingen kunnen herzieningstijden met ordegroottes verminderen. Bijvoorbeeld het vervangen van handmatige beoordeling van uren aan video door gebeurtenisgebonden fragmenten kan onderzoekstijd terugbrengen van uren naar minuten. Ook vermindert AI die een alarm valideert door extra sensoren te cross-checken het aantal valse positieven en daardoor onnodige inzet. In de praktijk melden teams snellere beslissingen en minder escalaties wanneer AI-agents voorgestelde acties en vooraf ingevulde casusgegevens bieden. Een duidelijke workflow die meldingen koppelt aan case management en bewijsexport maakt de controlekamer efficiënter en stelt operatoren in staat zich te concentreren op complexe incidenten in plaats van routinematige validatie.

Slimme video benutten voor schaalbaar forensisch zoeken en ruwe videobeoordeling

Smart video-functies filteren ruwe video naar gebeurtenisspecifieke fragmenten en maken archieven doorzoekbaar. In plaats van uren aan beeldmateriaal te scannen, kan een onderzoeker relevante fragmenten ophalen gefilterd op gedrag, objectklasse of kenteken. De forensische zoektool biedt vervolgens frame-niveau toegang en exporteerbaar bewijs. Deze workflow zet ruwe video om in bruikbare inlichtingen en houdt de ruwe beelden beschikbaar voor juridische procedures. Voor enorme archieven indexeren schaalbare architecturen metadata apart van videobestanden om opslag te verminderen en queries te versnellen.

Schaalbare opslagstrategieën omvatten gelaagde retentie, on-prem GPU-versnelling en geïndexeerde objectstores. Bijvoorbeeld kunnen hot events en hun bijbehorende frames op snellaag-opslag blijven, terwijl ouder ruwe beeldarchief gearchiveerd wordt. Wanneer een onderzoeker het archief bevraagt, streamt het systeem alleen relevante frames, niet volledige bestanden, wat ophaaltijden en bandbreedte vermindert. Deze benadering maakt enterprise video-oplossingen praktisch voor locaties met duizenden camera’s en grote hoeveelheden opgenomen data. Voor hoogbeveiligde omgevingen zoals een luchthaven ondersteunt een combinatie van lokale AI-inference en robuuste retentiebeleid compliance en snelle bewijsopvraging (kentekenherkenning en ANPR op luchthavens).

Forensisch zoeken vereist tools die natuurlijke-taalqueries, tijdlijnen en multi-broncorrelatie ondersteunen. Met een Vision Language Model kunnen operatoren vragen om “alle alarmen waarbij geen daadwerkelijke inbraak plaatsvond” en exporteerbare fragmenten, tijdstempels en contextuele aantekeningen ontvangen. Deze door AI aangedreven zoekfunctie vermindert de afhankelijkheid van handmatige tagging en versnelt juridische beoordelingen. Daarnaast automatiseert integratie met case management het maken van rapporten en keten-van-bewaringrecords zodat bewijs toelaatbaar blijft. Als gevolg krijgen teams sneller accurate resultaten, wat de uitkomsten verbetert in zowel beveiligings- als operationele onderzoeken.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Zoekmogelijkheden verbeteren met kentekenherkenning en detectie van rondhangen

Kentekenherkenningsworkflows zijn centraal voor voertuigtracking en watchlists. Eerst leest een ANPR-engine het kenteken van een rijdend voertuig. Vervolgens vergelijkt het systeem het kenteken met lijsten en genereert een melding voor voertuigen van belang. Deze melding koppelt aan tijdstempels en camerafeeds zodat operatoren onmiddellijk eerdere bewegingen kunnen vinden en bewijs kunnen exporteren. Het combineren van kentekenherkenning met cross-camera tracking stelt onderzoekers in staat routes over een campus of stad te traceren. Voor luchthavenimplementaties ondersteunt ANPR curbbeheer en security screening, en het koppelt natuurlijk met andere camera-analytics om een vollediger beeld te creëren.

Algoritmen voor detectie van rondhangen markeren abnormaal voetgangersgedrag door tijd-op-locatie, nabijheid tot beperkte gebieden en bewegingspatronen te monitoren. Wanneer iemand bij gevoelige infrastructuur blijft staan, creëert het systeem een event dat doorzoekbaar wordt. In deze gevallen verandert de zoekopdracht van een eenvoudige zoekterm in een gedragsgestuurde tijdlijn. Tools die zowel rondhangen als ANPR ondersteunen, kunnen een verdachte persoon correleren met een voertuig, waardoor snelle reconstructie van incidenten en duidelijke onderzoeksaanwijzingen mogelijk zijn.

Wanneer gecombineerd produceren ANPR en detectie van rondhangen krachtige cross-event correlatie. Bijvoorbeeld, als rondhangen wordt gedetecteerd bij een laadplek en een kentekenwaarneming overeenkomt met een voertuig van belang, maakt het systeem een gekoppelde zaak aan met relevante fragmenten, metadata en voorgestelde vervolgstappen. Die exporteerbare resultaten verminderen handmatig werk en helpen onderzoekers zich te concentreren op incidenten met hoge waarschijnlijkheid. In de praktijk verkorten deze functies, uitgerold over meerdere cameroposities, de tijd tot oplossing en verbeteren ze de situationele bewustwording. Meer over detectie van rondhangen bij gateway-locaties vindt u op onze bron over rondhangen-detectie op luchthavens.

Bandbreedte verminderen en veiligheidsteams ondersteunen met AI-analytics

Bandbreedte- en opslagkosten lopen snel op met ruwe videobeelden. AI-analytics helpen door video aan de edge te verwerken en alleen metadata of gebeurtenisfragmenten over het netwerk te sturen. Bijvoorbeeld kan een edge-node ai-objectdetectie uitvoeren en alleen meldingen en laag-bitrate thumbnails naar de controlekamer streamen. Dit behoudt bandbreedte terwijl operatoren direct geïnformeerd blijven. AI aan de edge vermindert de hoeveelheid videogegevens die een locatie verlaten, wat privacy en lokale nalevingsvereisten ondersteunt. Visionplatform.ai benadrukt on-prem verwerking om modellen en video binnen de omgeving te houden en onnodige clouduitgaande data te vermijden.

Technieken voor bandbreedte-efficiënt streamen omvatten adaptieve framerates, selectieve frame-extractie voor events en compacte metadata-sheets voor elk incident. Daarnaast kunnen VMS en AI onderhandelen om laagprioritaire camerafeeds op verminderde bitrates te houden totdat een gebeurtenis hogere kwaliteit streamt. Deze methoden verlagen kosten en maken duizenden camera’s beheersbaar zonder onderzoeksvermogen aan te tasten. Als resultaat ontvangen beveiligingsteams actiegerichte meldingen en kunnen ze direct kritieke beelden vinden zonder het netwerk te overbelasten.

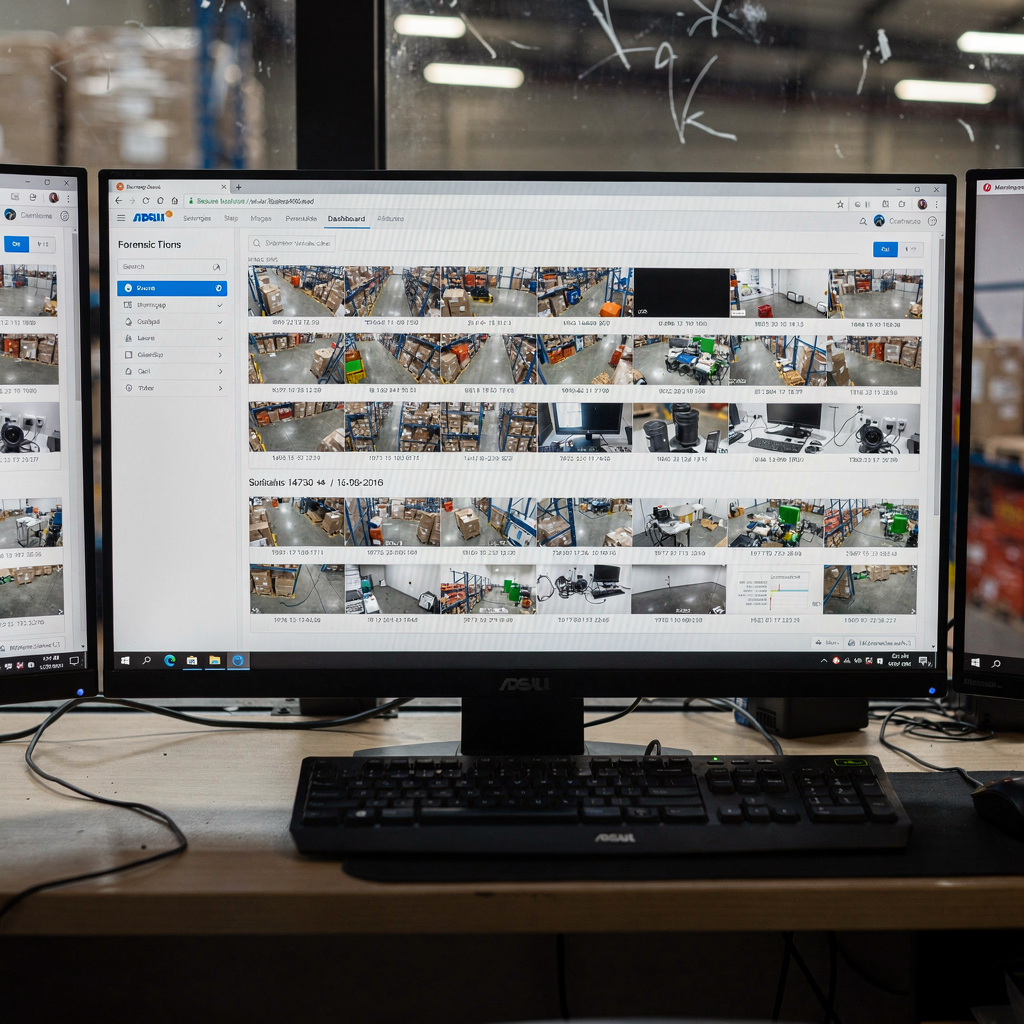

Gecentraliseerde dashboards aggregeren meldingen, metadata en casestatussen zodat operatoren operationele inzichten in één overzicht krijgen. Deze dashboards ondersteunen begeleide workflows en verminderen cognitieve belasting door acties aan te bevelen of rapporten vooraf in te vullen. Door AI-gestuurde meldingen te combineren met case management en procedurele automatisering, verwerken teams meer incidenten met hetzelfde personeel. Uiteindelijk maakt slim gebruik van ai-analytics en edge-processing surveillancesystemen schaalbaar, kosteneffectief en nuttiger voor zowel veiligheid als beveiliging.

Veelgestelde vragen

Wat is gebeurtenisgestuurde CCTV-zoekopdracht?

Gebeurtenisgestuurde CCTV-zoekopdrachten indexeren video op gedetecteerde gebeurtenissen in plaats van op tijd. Dit stelt operatoren in staat snel fragmenten op te halen die verband houden met specifieke gedragingen, objecten of incidenten zonder uren aan opgenomen beeldmateriaal te kijken.

Hoe verbetert metadata de zoekfunctie?

Metadata registreert attributen zoals tijd, locatie, objecttype en gedrag. Als resultaat leveren zoekopdrachten gerichte resultaten op en kunnen onderzoekers het archief doorzoeken op beschrijvende termen of zoekcriteria in plaats van op camera-ID’s.

Kan AI valse positieven verminderen?

Ja. AI-systemen die meerdere bronnen correleren en contextuele controles toepassen verlagen valse positieven. Systemen die meldingen verifiëren aan de hand van toegangbeheer of meerdere camera-perspectieven leveren nauwkeurigere resultaten en verminderen onnodige reacties.

Welke rol speelt kentekenherkenning?

Kentekenherkenning helpt voertuigen te traceren en te matchen met watchlists. Het ondersteunt voertuigforensica, curbbeheer en snelle identificatie van voertuigen van belang over camerastromen heen.

Heb ik nieuwe camera’s nodig om AI-zoekfunctie te gebruiken?

Niet altijd. Veel implementaties benutten bestaande camera’s en voegen AI toe aan de edge of in het VMS. Echter, camera’s met hogere resolutie of IR-capaciteit kunnen de nauwkeurigheid voor bepaalde detectietaken verbeteren.

Hoe werkt forensisch zoeken?

Forensisch zoeken indexeert metadata en biedt frame-niveau toegang tot relevante fragmenten. Onderzoekers kunnen zoeken op gedragingen of beschrijvingen en fragmenten en tijdstempels exporteren voor bewijsvoering.

Kunnen AI-analytics on-prem werken voor naleving?

Ja, on-prem AI houdt video en modellen binnen uw omgeving en vermindert cloudblootstelling. Dit ondersteunt naleving, controleerbaarheid en sluit aan bij strengere gegevensbeschermingsregimes.

Hoeveel bandbreedte kan AI besparen?

Aanzienlijke hoeveelheden. Door alleen events, thumbnails of metadata te streamen in plaats van volledige streams, snijden systemen in bandbreedte- en opslagkosten. Edge-verwerking vermindert bovendien de netwerkbelasting terwijl toegang tot noodzakelijk beeldmateriaal behouden blijft.

Wat is het voordeel van cross-camera zoeken?

Cross-camera zoeken traceert personen of voertuigen over meerdere camerazichten, waardoor snellere reconstructie van incidenten mogelijk is. Deze capaciteit verandert video in een operationele tijdlijn in plaats van geïsoleerde fragmenten.

Hoe snel kunnen teams relevante beelden vinden?

Met gebeurtenisgestuurde indexering en AI-gestuurde zoekfunctie vinden teams relevante beelden binnen enkele seconden tot minuten in plaats van uren aan handmatige beoordeling. Deze snelheid verbetert uitkomsten en ondersteunt snellere besluitvorming.