Dokumentacja Avigilon: wyszukiwanie tekstu w materiałach wideo Avigilon

avigilon Możliwości wyszukiwania tekstu

Na początek krótki przegląd pomaga wyjaśnić, co wyszukiwanie tekstu może zrobić w nowoczesnych systemach wideo. Ponadto Avigilon dostarcza nakładki podlegające wyszukiwaniu, które łączą metadane z nagraniem wideo. Następnie VMS może indeksować tekst z nakładek punktów sprzedaży, numerów rejestracyjnych i identyfikatorów dostępu. Na przykład identyfikatory transakcji i kwoty mogą pojawiać się na osi czasu wideo, a następnie śledczy mogą je znaleźć za pomocą słowa kluczowego. Dodatkowo wyszukiwalny tekst znacząco skraca czas dochodzenia. W rzeczywistości systemy analityki wideo mogą zmniejszyć czas dochodzenia nawet o 70% w porównaniu z ręcznym przeglądem Przewodnik po technologii analityki wideo: korzyści, rodzaje i przykłady. Również systemy warstwowe łączące LPR, radio i VMS poprawiają reakcję na incydenty. Jak zauważa jedno źródło, „Integracja systemów takich jak analityka wideo Avigilon, Vigilant LPR i radio Motorola pozwala zespołom działać szybko z jasnym kontekstem” Co oznacza „warstwowe” w strategii bezpieczeństwa fizycznego. W związku z tym wyszukiwalny tekst dodaje szybkości i przejrzystości. Platforma dopasowuje ciągi tekstowe do zindeksowanych klatek. Następnie operatorzy przechodzą bezpośrednio do momentów, które mają znaczenie. Ponadto wyszukiwanie tekstu obsługuje filtry takie jak kamera, zakres czasu i próg ufności. Następnie użytkownicy otrzymują zarówno miniatury, jak i materiał w pełnej rozdzielczości w wynikach. Wreszcie ta funkcja łączy się z innymi analizami, dzięki czemu zespoły mogą korelować wykrycia osób, wykrycia pojazdów i anomalne zachowania. Dla czytelników potrzebujących głębszych możliwości przeszukiwania kryminalistycznego nasz VP Agent Search konwertuje wideo na opisy zrozumiałe dla człowieka, dzięki czemu zespoły mogą zadawać pytania w języku naturalnym. Na przykład dowiedz się więcej o naszym przeszukiwaniu kryminalistycznym na lotniskach tutaj: przeszukiwanie kryminalistyczne na lotniskach. Ogólnie rzecz biorąc, wyszukiwalny tekst zmniejsza nakład manualnej pracy, poprawia świadomość sytuacyjną i przyspiesza podejmowanie decyzji.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

avigilon System Requirements and Installation

Po pierwsze, instalacja wyszukiwania tekstu wymaga zgodnych kamer i urządzeń z obsługą AI. Następnie powinieneś wybrać kamery o wysokiej rozdzielczości, które obsługują wejścia nakładek i strumienie metadanych. Ponadto zaawansowana analityka Avigilon działa najlepiej na systemach z przyspieszeniem GPU lub na certyfikowanym sprzęcie serwerowym. Dla ogólnych wskazówek Avigilon dokumentuje zalecane specyfikacje serwerów i wersje VMS na swoich stronach produktowych. Dodatkowo niektóre funkcje AI wymagają określonego firmware’u w kamerach. Dlatego przed wdrożeniem zweryfikuj modele kamer i wersje firmware. W integracjach LPR sparuj kamery z obsługą ANPR oraz moduły LPR. Na przykład integracja z rozpoznawaniem numerów rejestracyjnych poprawia indeksowanie i wyszukiwanie. Co więcej, nasza platforma często integruje się z przepływami pracy ANPR/LPR w transporcie i na lotniskach; zobacz nasze rozwiązania ANPR/LPR dla lotnisk tutaj: anpr-lpr na lotniskach. Następnie konfiguracja systemu obejmuje instalację VMS, włączenie modułu wyszukiwania tekstu oraz skonfigurowanie wejść nakładek z systemów POS lub kontroli dostępu. Następnie zaimportuj formaty takie jak NMEA, ASCII lub ustrukturyzowany JSON dla nakładek transakcyjnych. Ponadto zapewnij synchronizację kodów czasu między systemami, aby wideo i tekst pozostały zsynchronizowane. Dodatkowo niektórzy dostawcy wymagają licencji na narzędzia LPR lub ekstrakcji tekstu; w takich przypadkach funkcje mogą być dostępne tylko przy użyciu licencjonowanego oprogramowania. Na koniec szkolenie administratorów ma znaczenie. Zorganizuj sesje praktyczne, aby administratorzy nauczyli się regulować progi dopasowania słów kluczowych i harmonogramy indeksowania. Nasze doświadczenie pokazuje, że zespoły, które testują nakładki na reprezentatywnych próbkach, ograniczają fałszywe trafienia i przyspieszają strojenie. Dla lotnisk i miejsc o dużym natężeniu ruchu rozważ przetwarzanie na krawędzi i lokalne indeksowanie, aby uniknąć transferu do chmury i spełnić cele zgodności z AI Act UE. Ponadto jeśli planujesz skalować do wielu strumieni, zaplanuj zasoby magazynowe i indeksujące odpowiednio.

avigilon Video Analytics Integration

Po pierwsze, integracja wiąże nakładki tekstowe z klatkami wideo. Następnie VMS przechwytuje nakładki w pasmie lub za pomocą kanałów metadanych. Ponadto analityka AI parsuje znaki i normalizuje ciągi do indeksowania. Na przykład procedury OCR wydobywają sekwencje alfanumeryczne z nakładek i strumieni POS. Dodatkowo modele neuronowe klasyfikują i oceniają dokładność tekstu przed indeksowaniem. Zgodnie z wytycznymi dotyczącymi bezpieczeństwa warstwowego, integracja systemów takich jak analityka wideo i LPR daje zespołom jasny kontekst do działania Co oznacza „warstwowe” w strategii bezpieczeństwa fizycznego. Ponadto dostawcy mogą oferować wtyczki lub API do przesyłania danych transakcji bezpośrednio do VMS. Następnie VMS koreluje zdarzenia, więc trafienie LPR łączy się z pobliskimi kamerami i aktywnością kart dostępu. Również partnerzy tacy jak Motorola dostarczają powiązań ekosystemowych między radiami a VMS, które wzbogacają procedury reakcji Zintegrowany ekosystem technologii bezpiecznych Motorola Solutions. W związku z tym Twoja lokalizacja zyskuje bogatszą świadomość sytuacyjną. Rola AI wykracza poza prosty OCR. AI filtruje odczyty niskiej jakości i oznacza trafienia o niskiej ufności do ręcznej weryfikacji. Ponadto AI sortuje wyniki, tak aby operatorzy widzieli najprawdopodobniejsze trafienia jako pierwsze. Następnie synchronizacja z systemami POS, kontroli dostępu i LPR zwykle wymaga mapowania schematów i znaczników czasu. W praktyce ustaw okno tolerancji synchronizacji i zweryfikuj je testowymi transakcjami. Dla lotnisk, gdzie przepustowość i dokładność mają znaczenie, łącz analitykę wideo taką jak wykrywanie osób i ANPR z nakładkami tekstowymi, aby przyspieszyć dochodzenia. Zobacz nasze rozwiązania wykrywania osób na lotniskach, aby uzyskać pomysły na integrację: wykrywanie osób na lotniskach. Wreszcie zaplanuj API do eksportu i zasilania agentów AI, aby metadane stały się działaniem, a nie tylko przechowywanymi informacjami.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

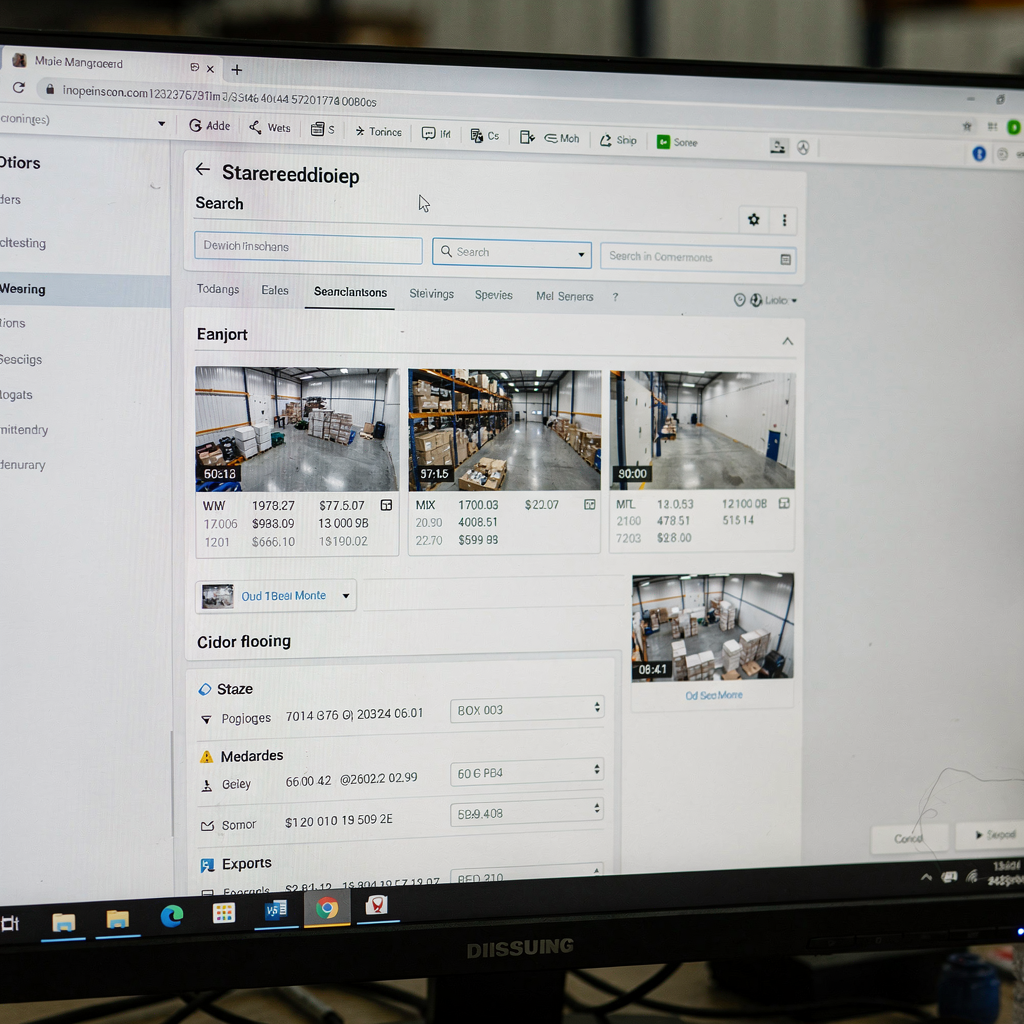

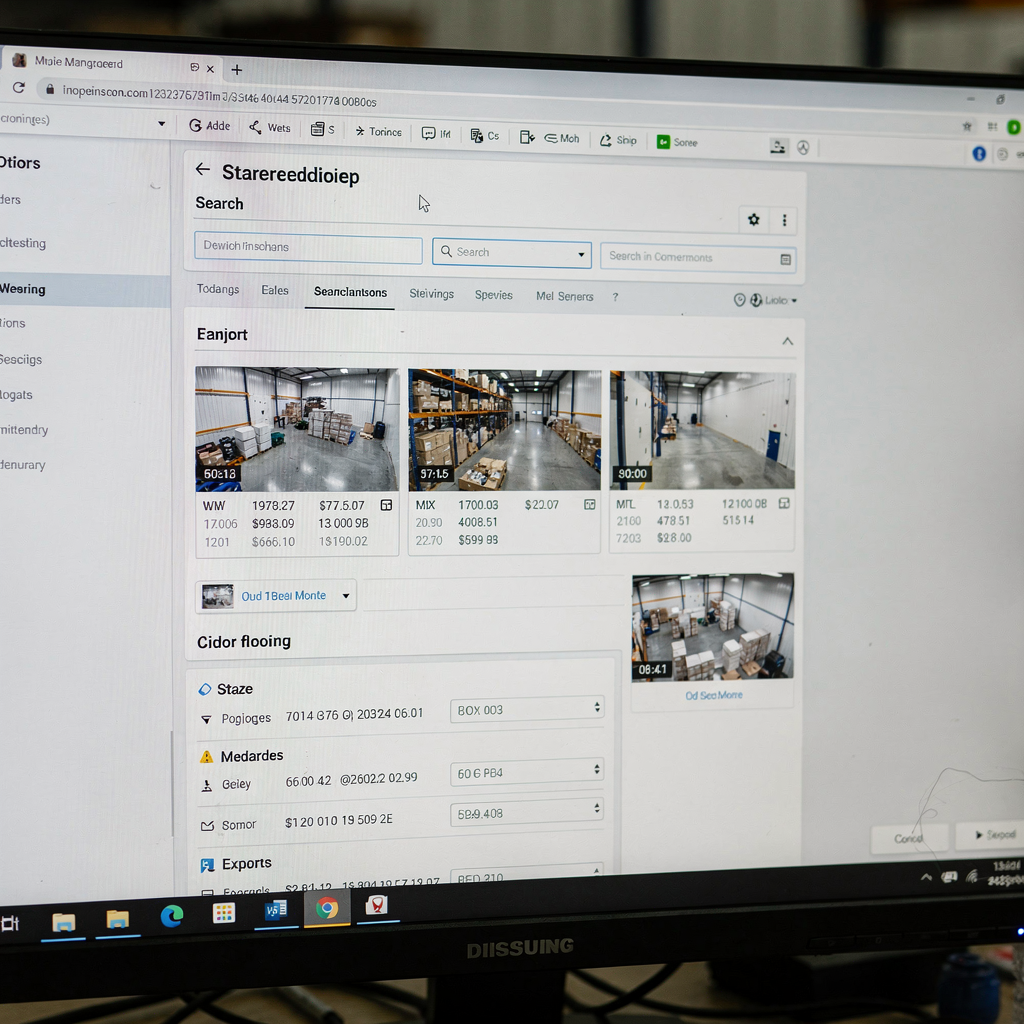

avigilon Performing a Text Search

Najpierw otwórz VMS i wybierz widok przeszukania kryminalistycznego lub odtwarzania. Następnie wybierz zakres czasu i zestaw kamer. Również wpisz słowo kluczowe, takie jak identyfikator transakcji, numer rejestracyjny lub kod identyfikatora. Następnie ustaw próg ufności, aby zrównoważyć recall i precyzję. Na przykład podniesienie progu zmniejsza fałszywe trafienia, ale może pominąć nakładki o niskiej jakości. Dodatkowo filtruj według grupy kamer, typu zdarzenia lub tagu analitycznego. Wiele interfejsów VMS pokazuje natychmiast miniatury dopasowanych klatek. Następnie kliknij miniaturę, aby przejść do dokładnej klatki w wysokiej rozdzielczości. Potem przejrzyj otaczający materiał, aby potwierdzić kontekst. Jeśli musisz wyeksportować, wybierz klip i określ format eksportu, opcje wypalenia i czy dołączyć sumę kontrolną. Ponadto dołącz metadane do pakietu eksportu, aby zachować łańcuch przechowywania dowodów. W przypadku wniosków prawnych postępuj zgodnie z politykami lokalnymi i rejestruj każdy eksport. W praktyce operatorzy często używają wyników wyszukiwania do tworzenia pakietów incydentowych z zakładkami i notatkami. Dodatkowo nasz VP Agent Search może konwertować zapytania w języku naturalnym na precyzyjne filtry, gdy zespoły nie znają identyfikatorów kamer. Na przykład możesz poprosić o „wszystkie wejścia z czerwonym pojazdem przy Dok B wczoraj wieczorem” i otrzymać pasujące klipy. Również gdy wyszukiwanie numerów rejestracyjnych zwraca wiele bliskich dopasowań, interfejs pokazuje oceny ufności, dzięki czemu możesz priorytetyzować. Następnie gdy wyniki pokazują fałszywe trafienia, dostosuj progi OCR lub popraw kontrast nakładek. Ponadto trenowanie modeli na specyficznych dla miejsca czcionkach i układach poprawia wskaźniki rozpoznawania. Dla szerszych procesów dowodowych zintegrować eksporty VMS z systemami zarządzania sprawami, aby usprawnić raportowanie i przegląd. Na koniec przechowuj dzienniki audytu dla zgodności i późniejszej weryfikacji.

avigilon Best Practices and Optimisation

Po pierwsze, wybieraj czytelne źródła tekstu. Ponadto upewnij się, że nakładki używają czcionek o wysokim kontraście i stabilnego położenia na klatce. Następnie preferuj czcionki stałoszerokowe lub proste bezszeryfowe dla lepszych wyników OCR. Dodatkowo utrzymuj rozmiar tekstu wystarczająco duży w stosunku do rozdzielczości kamery i odległości. Również unikaj ruchomych nakładek lub dynamicznych teł, które mylą algorytmy ekstrakcji. Następnie planuj konserwację indeksu w godzinach niskiego obciążenia. Dla dużych archiwów indeksowanie przyrostowe zmniejsza obciążenie i utrzymuje świeżość wyszukań. Dodatkowo archiwizuj lub usuwaj dane przeterminowane zgodnie z polityką retencji, aby zachować wydajność indeksu. Kolejno monitoruj kondycję indeksu i ponownie indeksuj segmenty, które wykazują pogorszone wyniki rozpoznawania. Ponadto kalibruj progi dopasowania słów kluczowych dla każdego miejsca. Na przykład kasy detaliczne często wymagają ścisłego dopasowania numerycznego, a odczyty identyfikatorów dostępu wymagają dokładnych ciągów. Również stosuj profile specyficzne dla kamery, aby skompensować dystorsję obiektywu lub kąt. Następnie egzekwuj silne kontrole dostępu użytkowników. Na przykład ogranicz uprawnienia do wyszukiwania tekstu i eksportu do śledczych i audytorów. Ponadto rejestruj każde wyszukiwanie i eksport, aby zachować ślad audytu. Dodatkowo szyfruj eksportowane dowody i przechowuj sumy kontrolne dla łańcucha przechowywania dowodów. Dla zgodności wyważ korzyści z wyszukiwalnymi metadanymi z przepisami o prywatności i ograniczeniami prawnymi. Jak zauważono w przeglądzie prawnym, „System wyszukiwalny zawierający dane lokalizacyjne wraz ze zdjęciami wideo musi również naruszać …” podczas gdy rodzi to obawy o prywatność, ostrożne polityki i kontrole dostępu ograniczają ryzyko Analityka wideo a wizja czwartej poprawki. Na koniec przetestuj ustawienia na rzeczywistych przykładach. Również iteruj szybko, ponieważ niewielkie zmiany parametrów często przynoszą duże zyski w dokładności. Dla wdrożeń na lotniskach dopasuj strojenie wyszukiwania tekstu z analizą perymetru i tłumu, aby poprawić detekcję i reakcję. Zobacz nasze strony dotyczące wykrywania tłumu i liczenia osób po powiązane wskazówki optymalizacyjne: wykrywanie gęstości tłumu na lotniskach.

avigilon Use Cases and Troubleshooting

Po pierwsze, zapobieganie stratom w detalicznym handlu korzysta bezpośrednio z wyszukiwania tekstu. Również zespoły mogą wyszukiwać identyfikatory transakcji i kwoty, aby szybko znaleźć podejrzane nagrania. Na przykład nakładki transakcji połączone z OCR o wysokiej ufności mogą skrócić czas dochodzenia o połowę. Ponadto skonfiguruj kasy, aby eksportowały czytelne, strukturyzowane nakładki. Następnie organy ścigania korzystają z zintegrowanego LPR, aby szybko zlokalizować podejrzanych. Na przykład znalezienie dopasowania numeru rejestracyjnego w ciągu minut skraca czas reakcji. Również dokładność ANPR poprawia się, gdy jest sparowana z wysokorozdzielczymi strumieniami i odpowiednim oświetleniem. Dla audytów kontroli dostępu wyszukiwanie tekstu weryfikuje numery identyfikatorów i kody wejścia. Potem połącz wyniki wyszukiwania z logami dostępu, aby potwierdzić lub obalić twierdzenia o wejściu. Ponadto częste problemy obejmują nierozpoznany tekst, błędne odczyty i fałszywe trafienia. W przypadku nierozpoznanego tekstu zweryfikuj format strumienia nakładki i rozdzielczość. Również sprawdź, czy znaczniki czasu są zsynchronizowane między systemami. Następnie jeśli fałszywe trafienia pojawiają się często, zaostrz próg ufności OCR lub zastosuj filtrację poźniejszą według kamery lub lokalizacji. Dodatkowo dodaj kroki ręcznej weryfikacji dla krytycznych dopasowań. Dla problemów sprzętowych sprawdź ostrość kamery, prędkość migawki i ustawienia kompresji. Również zmniejsz rozmycie ruchu, regulując liczbę klatek na sekundę lub ekspozycję. Następnie dla błędów integracji potwierdź mapowania API i nazwy pól między systemami. Również sprawdź, czy zewnętrzne strumienie wysyłają dane konsekwentnie. Dla specyficznych usterek dostawcy konsultuj notatki wsparcia i informacje o wydaniach firmware. Jak jeden partner podkreślił, integracje łączące radio, kontrolę dostępu i wideo dostarczają szybkich, kontekstowych reakcji, gdy działają wspólnie Zintegrowany ekosystem technologii bezpiecznych Motorola Solutions. W procesie rozwiązywania problemów rejestruj błędy i odtwarzaj problem na klipie testowym. Na koniec dla zaawansowanej automatyzacji rozważ dodanie agentów AI do rozumowania nad dopasowaniami, dostarczania kontekstu i sugerowania działań. Nasz VP Agent Reasoning może przeprowadzać krzyżowe sprawdzenia wykryć, streszczać ustalenia i nawet wstępnie wypełniać raporty incydentów, aby usprawnić procesy.

FAQ

What is text search in video surveillance?

Wyszukiwanie tekstu wydobywa i indeksuje nakładki tekstowe oraz metadane ze strumieni wideo. Następnie pozwala operatorom znaleźć nagranie za pomocą słów kluczowych, takich jak identyfikatory transakcji, numery rejestracyjne czy kody identyfikatorów.

Which overlays work best for OCR?

Nakładki o wysokim kontraście i statycznym położeniu z prostymi czcionkami działają najlepiej. Ponadto większe rozmiary czcionki i stabilne pozycje na klatce poprawiają skuteczność rozpoznawania.

What hardware do I need to enable text search?

Potrzebujesz kamer, które dostarczają nakładki lub strumienie metadanych oraz VMS obsługującego indeksowanie tekstu. Dla dużych wdrożeń użyj serwerów z przyspieszeniem GPU i wystarczającą pojemnością magazynową.

How accurate is OCR on video overlays?

Dokładność zależy od jakości obrazu, projektu nakładki i oświetlenia. Ogólnie rzecz biorąc, połączenie wysokiej jakości kamer z analityką zasilaną przez AI daje wskaźniki rozpoznawania powyżej 90% w wielu scenariuszach Co oznacza „warstwowe” w strategii bezpieczeństwa fizycznego.

Can text search integrate with LPR systems?

Tak. Wyszukiwanie tekstu często integruje się z systemami ANPR/LPR, aby indeksować tablice rejestracyjne i łączyć je z wideo. Dla wdrożeń na lotniskach integracje ANPR poprawiają przepustowość i dochodzenia; zobacz nasze wskazówki dotyczące ANPR: anpr-lpr na lotniskach.

How do I export evidence from a text search result?

Wybierz dopasowany klip w VMS, wybierz opcje eksportu i w razie potrzeby dołącz metadane. Ponadto zachowaj dzienniki audytu i sumy kontrolne dla łańcucha przechowywania dowodów.

What if the system returns false positives?

Dostosuj progi ufności, dopracuj profile kamer i dodaj filtry poźniejsze według lokalizacji. Również przetrenuj lub skalibruj modele OCR używając reprezentatywnych próbek.

Are there privacy concerns with searchable video text?

Tak. Wyszukiwalne metadane zwiększają ryzyko nadużyć, jeśli dostęp nie jest kontrolowany. Dlatego egzekwuj rygorystyczne uprawnienia użytkowników i ślady audytu, aby ograniczyć dostęp.

Can AI help verify text search hits?

Tak. Agenci AI mogą rozumować nad wykryciami, korylować dane i sugerować kroki weryfikacyjne. Na przykład nasz VP Agent Reasoning sprawdza wiele źródeł, aby potwierdzić dopasowania przed eskalacją.

How do I get started with text search at scale?

Rozpocznij od pilota obejmującego reprezentatywne kamery i nakładki. Następnie mierz wskaźniki rozpoznawania, dostrajaj ustawienia i zaplanuj indeksowanie oraz magazynowanie przed pełnym wdrożeniem. Również konsultuj przewodniki dostawcy i dokładnie testuj integracje.