Analisi video guidata dall’IA per accelerare le indagini forensi nella videosorveglianza

L’analisi video guidata dall’IA costituisce ora la spina dorsale del lavoro forense moderno. In primo luogo, gli algoritmi di rilevamento del movimento e di riconoscimento facciale riducono il tempo che gli analisti dedicano alla revisione manuale delle registrazioni. Ad esempio, i filtri di movimento e il tracciamento mirato possono ridurre la revisione manuale fino al 50% se combinati con flussi di lavoro intelligenti di anteprime e indicizzazione (studio sull’analisi del movimento). Inoltre, questa velocità aiuta gli investigatori ad accelerare i tempi dei casi e a chiudere le indagini più rapidamente.

In secondo luogo, l’IA riduce il rumore e evidenzia gli eventi probabili per l’analista. Una pipeline forense alimentata dall’IA segnala gli eventi, estrae una miniatura e collega le prove video correlate tra i sistemi di telecamere. Di conseguenza, la ricerca permette ai team di passare da ore di registrazioni a filmati rilevanti in pochi secondi. Pertanto, il carico di lavoro della sala controllo diminuisce e il tempo di intervento si accorcia. Il VP Agent Search converte i video registrati in descrizioni leggibili dall’uomo, permettendo agli operatori di cercare usando query in linguaggio naturale, come “camion rosso che entra nell’area di carico ieri sera.” Questo approccio forense basato sull’IA trasforma uno strumento potente in una capacità quotidiana per i team investigativi.

In terzo luogo, il deep learning consente il matching di pattern nel tempo e nello spazio. Le reti di deep learning apprendono caratteristiche che si generalizzano tra ambienti e angoli di ripresa. Pertanto, il sistema può abbinare volti o caratteristiche di oggetti attraverso più feed e telecamere. In pratica, collegare un oggetto o una persona tra viste diverse migliora i tassi di risoluzione dei casi, perché gli investigatori trovano più velocemente prove video corroboranti (studio sul valore delle telecamere CCTV). Inoltre, il riconoscimento facciale restringe i risultati di ricerca in modo che gli analisti verifichino piste, invece di setacciare ore di filmati.

Infine, gli agenti IA combinano l’analisi video con gli eventi VMS per fornire contesto. L’analisi video forense beneficia quando la gestione video e gli output dell’IA sono unificati. Per esempio, un allarme può innescare una revisione e la ricerca potenziata dall’IA precompila clip rilevanti, timestamp e metadati per un recupero e una riproduzione più rapidi. Questo processo riduce i passaggi manuali e rende scalabile il flusso di lavoro forense.

Uso dei metadati e dei filtri di ricerca per velocizzare le indagini e affinare i risultati di ricerca

L’estrazione dei metadati è essenziale per ridurre rapidamente l’ambito di ricerca. I team forensi estraggono timestamp, log degli eventi e tag degli oggetti dai formati CCTV proprietari. Quindi, utilizzano filtri di ricerca per individuare clip per data, ora, ID telecamera e dati dei sensori. Questo flusso di lavoro aiuta gli investigatori ad accelerare le indagini e a trovare prove video con molto meno sforzo manuale. Ad esempio, generare metadati strutturati permette a una ricerca di restituire clip in minuti anziché ore di video, e le ricerche sul recupero automatico evidenziano come il trattamento di formati proprietari sia ora comune nei flussi di lavoro forensi (studio sul recupero automatico).

In seguito, i filtri di ricerca restringono i risultati includendo soglie di movimento, tipo di oggetto e metadati della scena. Una tipica sequenza di ricerca mirata può iniziare con data e ora, quindi aggiungere tag di oggetti come “veicolo” e un filtro per colore. Di conseguenza, l’ambito di ricerca può ridursi di oltre il 70% in molti casi, poiché il sistema esclude i periodi inattivi irrilevanti. La piattaforma quindi mette in evidenza un set di miniature legate agli eventi. L’anteprima della miniatura accelera la triage, perché gli investigatori possono scansionare le immagini per decidere quali clip richiedono la riproduzione.

Inoltre, i metadati provenienti da controllo accessi e sensori ausiliari migliorano il filtraggio. Correlando i log di controllo accessi con i timestamp delle telecamere, gli investigatori escludono rapidamente falsi positivi. Questo è particolarmente utile in siti con molte telecamere dove timeline naive generano risultati schiaccianti. Il VP Agent di Visionplatform.ai estrae descrizioni in linguaggio naturale e genera metadati lato server per mantenere i dati on-premise e conformi alle policy. Ciò mantiene i dati video locali, riduce i rischi legati al cloud e supporta un recupero pronto per audit nelle analisi forensi formali dei video.

Infine, metadati di alta qualità abilitano ricerche forensi più avanzate, come la cucitura cronologica degli eventi tra telecamere. In pratica, un flusso di lavoro che combina ID telecamera, tag di movimento e attributi degli oggetti velocizza il recupero e aiuta i team investigativi a passare dalla scoperta alla raccolta delle prove con meno passaggi.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Integrazione avanzata della ricerca forense con sistemi di telecamere e integrazioni partner per unificare le prove video

L’integrazione senza soluzione di continuità tra produttori di telecamere, VMS e sistemi di terze parti unifica le prove video per indagini multisito. In primo luogo, API e plugin collegano sistemi di telecamere e piattaforme di gestione video. Per esempio, Genetec e Axis Communications spesso espongono stream di eventi e metadati tramite protocolli standardizzati, permettendo agli strumenti forensi di ingerire e interrogare video registrati. Una piattaforma unificata migliora le capacità di ricerca ed elimina la necessità di aprire più console.

In secondo luogo, le integrazioni con partner consentono ai dati video e ai sensori di terze parti di unirsi al repository. Quando i team unificano eventi VMS e video di terze parti, il sistema può correlare gli allarmi con i video per confermare un incidente. Questo riduce i falsi positivi e offre agli operatori un contesto situazionale più ricco. Visionplatform.ai enfatizza l’integrazione fluida con i VMS tramite agenti leggeri lato server che espongono i dati agli agenti IA mantenendo il video on-premise. Il risultato è un archivio ricercabile e verificabile per processi legali.

In terzo luogo, un repository unificato semplifica le indagini multisito. Gli investigatori possono interrogare più siti da un’unica interfaccia e ottenere miniature corrispondenti, timestamp e log di controllo accessi correlati. La ricerca forense tra siti velocizza il reperimento dei filmati rilevanti, poiché la piattaforma normalizza i metadati ed espone campi di ricerca coerenti. Inoltre, l’integrazione con Genetec Security Center o altri sistemi di gestione video permette di eseguire query su archivi distribuiti senza esportazioni manuali.

Infine, l’uso di una piattaforma unificata riduce la necessità di hardware aggiuntivo. Con API adeguate e integrazioni partner, le organizzazioni evitano complesse appliance di ingestione separate. Invece, sfruttano le integrazioni VMS esistenti per generare indici ricercabili e supportare flussi di lavoro come la generazione di metadati, l’esportazione di clip e la conservazione della catena di custodia delle prove video.

Capacità scalabili di ricerca video forense e analitiche per Genetec e altri VMS

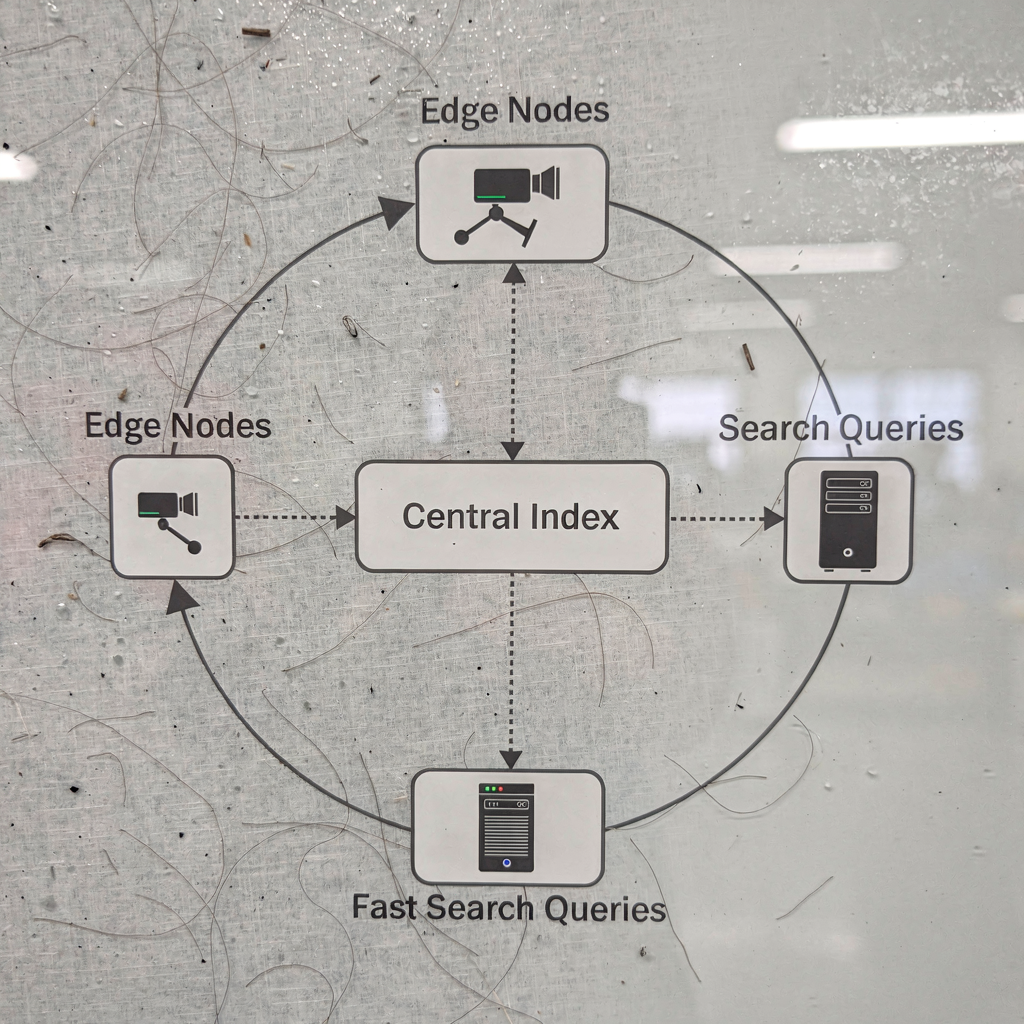

La scalabilità è importante quando gli archivi raggiungono dimensioni di petabyte. La ricerca video forense scalabile si basa su tecniche di indicizzazione distribuita per mantenere le query veloci. Ad esempio, indici shardati e sistemi di file invertito permettono ai motori di ricerca di restituire miniature e timestamp in pochi secondi, anche su dataset molto grandi. Nelle implementazioni su larga scala, le prestazioni delle query in una configurazione multisito beneficiano dell’indicizzazione al bordo e di query federate che riducono i colli di bottiglia centrali. Di conseguenza, i team possono cercare attraverso molti siti con una velocità simile a quella delle query su singolo sito.

In secondo luogo, le analitiche aiutano a gestire il carico di recupero e riproduzione. Quando una query restituisce molti risultati, il sistema prioritizza i risultati in base al punteggio di confidenza, rilevanza e prossimità temporale. Questa ricerca mirata riduce le richieste di riproduzione sui server di storage e l’attenzione degli operatori. Visionplatform.ai supporta implementazioni scalabili da poche decine di stream fino a migliaia, e si integra con i sistemi di gestione video per distribuire i compiti di indicizzazione.

In terzo luogo, consideriamo un caso municipale: una rete di videosorveglianza urbana elabora circa 1 PB di filmati al mese. Utilizzando indicizzazione distribuita e agenti lato server, il sistema shardizza i metadati su più nodi. Di conseguenza, gli investigatori possono eseguire una ricerca avanzata che restituisce clip candidate da dozzine di telecamere in meno di un minuto. Questo approccio preserva la capacità di cercare prove a scala senza aggiungere ulteriore hardware o spostare i video fuori sede.

Infine, il design del sistema influisce sulla latenza delle query. Le implementazioni su singolo sito spesso mostrano una latenza assoluta inferiore, mentre le query multisito aggiungono overhead di rete. Per mitigare ciò, caching e prefetching di timeline popolari possono garantire prestazioni interattive coerenti. In breve, architetture distribuite e un accurato design delle analitiche rendono la ricerca forense veloce e scalabile sia per Genetec che per altre piattaforme VMS (ricerca sui log HIKVISION).

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Uso dell’analisi video e del riconoscimento delle targhe per migliorare sorveglianza e indagini

Il riconoscimento delle targhe gioca un ruolo centrale in molte indagini. I sistemi di riconoscimento targhe basati sull’IA offrono alti tassi di lettura e bassa latenza. Nelle implementazioni reali, i modelli moderni raggiungono letture rapide con tassi di falsi positivi accettabili quando le telecamere sono posizionate correttamente. Inoltre, collegare una targa tra più telecamere crea una traccia di movimento che gli investigatori usano per ricostruire percorsi e identificare punti di sosta.

In secondo luogo, combinare il riconoscimento targhe con il tracciamento degli oggetti e la classificazione dei veicoli arricchisce il dataset. Conoscere il tipo di veicolo insieme alla targa aiuta gli investigatori a dare priorità alle piste. Per esempio, una query può filtrare per targa più tipo di veicolo per ridurre i risultati alle corrispondenze più probabili. Questa ricerca mirata è inestimabile nell’applicazione delle normative sul traffico, nel controllo dei parcheggi, nella difesa perimetrale e nella prevenzione delle perdite.

In terzo luogo, il collegamento tra telecamere è vitale. Quando un sistema LPR legge una targa a un cancello e poi la legge di nuovo in un altro punto, il sistema collega quegli eventi attraverso più telecamere e feed. Di conseguenza, i team investigativi ricostruiscono le timeline con fiducia. Questa capacità supporta indagini sul traffico e inchieste penali dove il movimento del veicolo è un elemento chiave.

Inoltre, integrare LPR con VMS e sistemi di controllo accessi fornisce contesto operativo. Per esempio, correlare una lettura di targa con un evento di apertura cancello mostra la legittimità dell’accesso. Visionplatform.ai integra le analitiche ANPR/LPR con i dati VMS e può mettere in evidenza tali correlazioni per l’operatore. Così si ottiene una verifica rapida, si riducono i falsi allarmi e si supportano obiettivi di sicurezza e protezione.

Infine, LPR automatizzato può innescare flussi di lavoro a valle, come allarmi automatici o misure di contenimento. Quando abbinato a filtri di ricerca granulare e agenti IA, il riconoscimento delle targhe diventa parte di una pipeline di ricerca potenziata dall’IA che aiuta gli investigatori a individuare filmati rilevanti e a chiudere i casi più rapidamente.

Filtri di ricerca granulari e ricerca avanzata per risultati forensi efficaci con l’IA

I filtri di ricerca granulari permettono agli investigatori di raffinare le query per tipo di oggetto, vettore di movimento e colore. Per esempio, un profilo di ricerca potrebbe combinare “persona”, direzione del movimento verso un’uscita e il tag colore giacca rossa. I moduli di ricerca avanzata poi valutano i risultati per rilevanza e confidenza. Questo aiuta gli analisti a dare priorità alle clip da riprodurre. Inoltre, integrare gli output di riconoscimento facciale e targhe nella stessa query riduce la necessità di catene di strumenti separate.

In seguito, la ricerca forense avanzata fonde descrizioni generate da VLM con indici strutturati. VP Agent Search di Visionplatform.ai trasforma il contenuto delle immagini video in testo ricercabile. Di conseguenza, gli investigatori possono eseguire ricerche in testo libero che assomigliano a come gli esseri umani descrivono gli eventi. Questo rende la ricerca più intuitiva e riduce i tempi di formazione per i nuovi operatori. Allo stesso tempo, l’elaborazione lato server mantiene i modelli e i video locali, supportando la conformità ai vincoli del Regolamento UE sull’IA.

In terzo luogo, la ricerca predittiva e il rilevamento delle anomalie sono la prossima frontiera. I modelli di machine learning possono mettere in luce pattern anomali che i filtri umani non rilevano. Per esempio, un rivelatore di anomalie segnala pattern di movimento che deviano dalla baseline. Successivamente, una ricerca potenziata dall’IA può restituire eventi passati simili, il che facilita l’indagine e la scoperta di pattern. La combinazione di filtri granulari e modelli predittivi fornisce uno strumento potente per il lavoro proattivo e reattivo.

Infine, funzionalità pratiche come miniature ricercabili, ritaglio della riproduzione e flussi di lavoro di esportazione rendono il risultato utilizzabile in tribunale. La ricerca avanzata supporta la concatenazione: una query restituisce clip, l’operatore affina in base ai controlli visivi e la piattaforma annota il sottoinsieme per l’esportazione come prova video. Questo flusso di lavoro riduce il carico cognitivo sugli investigatori e permette ai team di concentrarsi sull’interpretazione piuttosto che sul recupero.

FAQ

Cos’è la ricerca video forense e perché è importante?

La ricerca video forense è il processo di individuazione ed estrazione di prove video rilevanti dagli archivi di sorveglianza. È importante perché fa risparmiare tempo agli investigatori, riduce il carico di lavoro e migliora le probabilità di risolvere i casi facendo emergere rapidamente i filmati pertinenti.

In che modo l’IA migliora le indagini forensi?

L’IA automatizza il rilevamento, l’indicizzazione e la classificazione degli eventi, accelerando la revisione e riducendo i passaggi manuali. L’IA inoltre collega clip correlate tra telecamere e timeline in modo che gli investigatori possano seguire gli eventi e chiudere i casi più velocemente.

I metadati possono davvero accelerare le indagini?

Sì. I metadati come timestamp, ID telecamera e tag degli oggetti possono filtrare migliaia di ore di video fino a pochi minuti. Questo approccio mirato riduce le richieste di recupero e riproduzione e semplifica la raccolta delle prove.

È possibile unificare filmati provenienti da diversi VMS e marchi di telecamere?

Sì. Usando API e integrazioni con partner, i sistemi possono unificare video di terze parti ed eventi VMS in un unico repository ricercabile. Le integrazioni con piattaforme comuni come Genetec Security Center aiutano a creare una piattaforma unificata per indagini multisito.

Quanto è accurato il riconoscimento targhe in condizioni reali?

L’accuratezza dell’LPR dipende dal posizionamento della telecamera, dall’illuminazione e dalla risoluzione dell’immagine, ma i sistemi moderni raggiungono alti tassi di lettura se configurati correttamente. Collegare le letture delle targhe tra telecamere fornisce preziose tracce di movimento per le indagini.

Che ruolo svolge il deep learning nella forense video?

Il deep learning estrae caratteristiche robuste per volti, veicoli e comportamenti, migliorando il matching tra angoli di ripresa e variazioni di qualità dell’immagine. Alimenta inoltre il rilevamento delle anomalie e la ricerca predittiva per una rilevazione anticipata di pattern sospetti.

In che modo l’elaborazione on-prem aiuta la conformità?

L’elaborazione on-prem mantiene i dati video e i modelli all’interno dell’organizzazione, riducendo i rischi legati al trasferimento sul cloud e aiutando a soddisfare requisiti legali e normativi come il Regolamento UE sull’IA. Supporta inoltre catene di custodia verificabili per le prove video.

La ricerca forense avanzata può funzionare con telecamere senza analitica integrata?

Sì. L’indicizzazione lato server e la vision machine possono analizzare video registrato proveniente da telecamere senza analitica incorporata. La piattaforma può generare metadati e miniature per un accesso ricercabile.

In che modo gli agenti IA assistono gli operatori della sala controllo?

Gli agenti IA verificano gli allarmi, forniscono spiegazioni contestuali e raccomandano azioni basate sui dati correlati provenienti da video, controllo accessi e procedure. Questo riduce i falsi allarmi e supporta decisioni più rapide.

Dove posso trovare maggiori informazioni sulle funzionalità di ricerca forense focalizzate sugli aeroporti?

Per soluzioni specifiche per aeroporti, consulta le risorse sulla ricerca forense negli aeroporti e le funzionalità di rilevamento correlate come il rilevamento persone e ANPR/LPR negli aeroporti. Queste pagine spiegano come le analitiche integrate supportino le esigenze operative e di sicurezza: ricerca forense negli aeroporti, rilevamento persone negli aeroporti, e ANPR/LPR negli aeroporti.