KI-gestützte Videoanalyse zur Beschleunigung forensischer Ermittlungen in der Videoüberwachung

KI-gestützte Videoanalyse bildet heute das Rückgrat moderner forensischer Arbeit. Erstens reduzieren Bewegungserkennungs- und Gesichtserkennungsalgorithmen die Zeit, die Analysten für die manuelle Sichtung von Aufnahmen aufwenden. Beispielsweise können Bewegungsfilter und zielgerichtetes Tracking die manuelle Sichtung um bis zu 50 % verkürzen, wenn sie mit intelligenten Vorschaubildern und Indexierungs-Workflows kombiniert werden (Studie zur Bewegungsanalyse). Außerdem hilft diese höhere Geschwindigkeit Ermittlern, Fallfristen zu verkürzen und Fälle schneller abzuschließen.

Zweitens reduziert KI Stördaten und hebt wahrscheinliche Ereignisse für den Analysten hervor. Eine KI-gestützte forensische Pipeline markiert Ereignisse, extrahiert ein Vorschaubild und verknüpft verwandte Videobeweise über Kamerasysteme hinweg. Dadurch ermöglicht die Suche Teams, von Stunden an Video in Sekundenschnelle zu relevanten Aufnahmen zu springen. Daher sinkt die Arbeitsbelastung im Kontrollraum und die Zeit bis zur Reaktion verkürzt sich. Der VP Agent Search von Visionplatform.ai wandelt aufgezeichnetes Video in menschenlesbare Beschreibungen um, sodass Bediener mit einfachen Abfragen in natürlicher Sprache suchen können, wie z. B. „roter Lkw fährt gestern Abend in den Ladebereich ein“. Dieser KI-forensische Ansatz macht ein leistungsfähiges Werkzeug zu einer alltäglichen Fähigkeit für Untersuchungsteams.

Drittens ermöglicht Deep Learning das Musterabgleich über Zeit und Raum. Deep-Learning-Netzwerke lernen Merkmale, die über Umgebungen und Kamerawinkel hinweg generalisieren. So kann das System Gesichter oder Objektmerkmale über mehrere Kamerafeeds und Standorte hinweg abgleichen. In der Praxis verbessert das Verknüpfen eines Objekts oder einer Person über verschiedene Blickwinkel die Aufklärungsquoten, weil Ermittler schneller ergänzende Videobeweise finden (Studie zum Wert von CCTV-Überwachungskameras). Außerdem verengt die Gesichtserkennung die Suchergebnisse, sodass Analysten Hinweise verifizieren, statt Stunden an Aufnahmen durchzusehen.

Schließlich kombinieren KI-Agenten Videoanalyse mit VMS-Ereignissen, um Kontext zu liefern. Forensische Videoanalyse profitiert, wenn Videomanagement und KI-Ausgaben vereinheitlicht werden. Beispielsweise löst ein Alarm eine Überprüfung aus, und die KI-gestützte Suche füllt relevante Clips, Zeitstempel und Metadaten vor, um schnellere Wiederherstellung und Wiedergabe zu ermöglichen. Dieser Prozess reduziert manuelle Schritte und macht den forensischen Workflow skalierbar.

Verwendung von Metadaten und Suchfiltern zur Beschleunigung von Ermittlungen und Verfeinerung der Suchergebnisse

Die Extraktion von Metadaten ist wesentlich, um den Suchumfang schnell einzugrenzen. Forensische Teams extrahieren Zeitstempel, Ereignisprotokolle und Objekttags aus proprietären CCTV-Formaten. Anschließend verwenden sie Suchfilter, um Clips nach Datum, Uhrzeit, Kamera-ID und Sensordaten zu lokalisieren. Dieser Workflow hilft Ermittlern, Untersuchungen zu beschleunigen und Videobeweise mit deutlich weniger manuellem Aufwand zu finden. Zum Beispiel lässt eine strukturierte Metadatengenerierung eine Suche nach Beweismitteln Clips in Minuten statt in Stunden von Video zurückgeben, und Untersuchungen zur automatisierten Wiederherstellung zeigen, dass der Umgang mit proprietären Formaten mittlerweile in forensischen Workflows üblich ist (Studie zur automatisierten Wiederherstellung).

Als Nächstes verengen Suchfilter die Ergebnisse, indem sie Bewegungsschwellen, Objekttyp und Szenenmetadaten einbeziehen. Eine typische gezielte Suchsequenz beginnt mit Datum und Uhrzeit und fügt dann Objekttags wie „Fahrzeug“ und einen Farbfilter hinzu. Infolgedessen kann der Suchumfang in vielen Fällen um über 70 % sinken, da das System irrelevante Leerlaufphasen ausschließt. Die Plattform zeigt dann eine Reihe von Vorschaubildern, die mit Ereignissen verknüpft sind. Die Vorschaubildvorschau beschleunigt die Triage, weil Ermittler Bilder scannen können, um zu entscheiden, welche Clips eine Wiedergabe erfordern.

Außerdem verbessern Metadaten aus Zutrittskontrolle und Hilfssensoren das Filtern. Durch die Korrelation von Zutrittsprotokollen mit Kamera-Zeitstempeln schließen Ermittler falsch-positive Hinweise schnell aus. Das ist besonders nützlich an Standorten mit vielen Kameras, bei denen naive Zeitachsen überwältigende Ergebnisse erzeugen. Der VP Agent von Visionplatform.ai extrahiert natürlichsprachliche Beschreibungen und erzeugt serverseitig Metadaten, um Daten lokal zu halten und konform mit Richtlinien zu bleiben. Dadurch verbleiben Videodaten vor Ort, Cloud-Risiken werden reduziert und eine revisionsbereite Wiederherstellung für formelle forensische Videoanalyse unterstützt.

Schließlich ermöglichen hochwertige Metadaten fortgeschrittenere forensische Suchfunktionen, wie die chronologische Zusammenfühung von Ereignissen über Kameras hinweg. In der Praxis beschleunigt ein Workflow, der Kamera-IDs, Bewegungstags und Objektattribute kombiniert, die Wiederherstellung und hilft Untersuchungsteams, mit weniger Schritten von der Entdeckung zur Beweissicherung zu gelangen.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Erweiterte forensische Suchintegration mit Kamerasystemen und Partnerintegrationen zur Vereinheitlichung von Videobeweisen

Nahtlose Integration über Kamerahersteller, VMS und Drittanbietersysteme vereinheitlicht Videobeweise für standortübergreifende Ermittlungen. Erstens verbinden APIs und Plugins Kamerasysteme und Videomanagementplattformen. Beispielsweise stellen Genetec und Axis Communications häufig Ereignisströme und Metadaten über standardisierte Protokolle bereit, die forensische Tools das Ingestieren und Abfragen aufgezeichneter Videos erlauben. Eine einheitliche Plattform verbessert die Suchmöglichkeiten und erspart das Öffnen mehrerer Konsolen.

Zweitens ermöglichen Partnerintegrationen, dass Drittanbieter-Video- und Sensordaten in das Repository einfließen. Wenn Teams VMS-Ereignisse und Drittanbieter-Video vereinheitlichen, kann das System Alarme mit Video korrelieren, um einen Vorfall zu bestätigen. Das reduziert Fehlalarme und liefert Bedienern reichhaltigeren situativen Kontext. Visionplatform.ai betont nahtlose Integration mit VMS durch leichtgewichtige serverseitige Agents, die Daten für KI-Agenten exponieren und gleichzeitig Video vor Ort belassen. Das Ergebnis ist ein durchsuchbares, prüfbares Archiv für rechtliche Prozesse.

Drittens vereinfacht ein einheitliches Repository standortübergreifende Ermittlungen. Ermittler können mehrere Standorte von einer Oberfläche aus abfragen und erhalten passende Vorschaubilder, Zeitstempel und zugehörige Zutrittsprotokolle. Forensische Suche über Standorte hinweg beschleunigt die Auffindung relevanter Aufnahmen, weil die Plattform Metadaten normalisiert und konsistente Suchfelder bereitstellt. Außerdem erlaubt die Integration mit Genetec Security Center oder anderen Videomanagementsystemen, Abfragen über verteilte Archive auszuführen, ohne manuelle Exporte.

Schließlich reduziert die Nutzung einer einheitlichen Plattform den Bedarf an zusätzlicher Hardware. Mit geeigneten APIs und Partnerintegrationen vermeiden Organisationen komplexe separate Ingest-Appliances. Stattdessen nutzen sie bestehende VMS-Integrationen, um durchsuchbare Indizes zu erzeugen und Workflows wie Metadatengenerierung, Clip-Export und Erhaltung der Beweiskette für Videobeweise zu unterstützen.

Skalierbare forensische Videosuchfunktionen und Analytik für Genetec und andere VMS

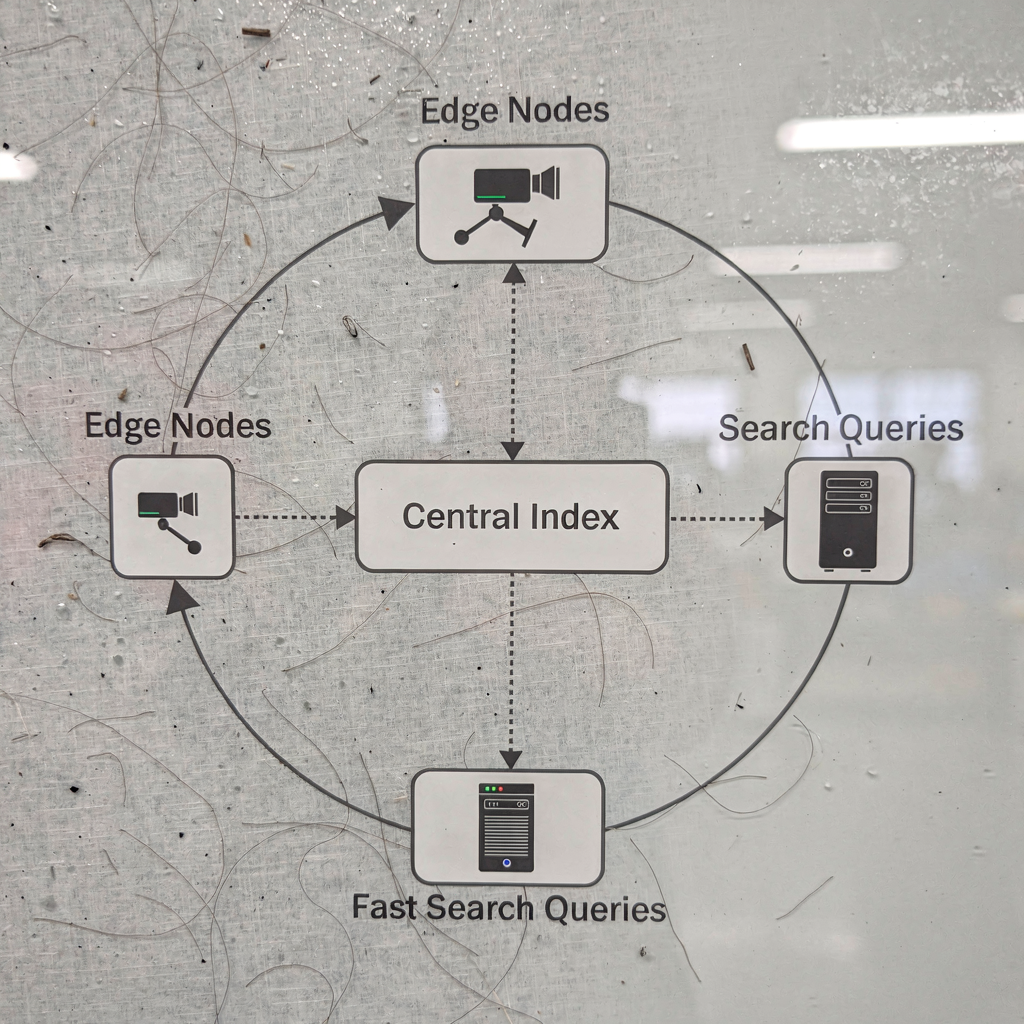

Skalierbarkeit ist entscheidend, wenn Archive Petabyte-Größen erreichen. Skalierbare forensische Videosuche beruht auf verteilten Indexierungstechniken, um Abfragen schnell zu halten. Zum Beispiel erlauben gesharde Indizes und invertierte Dateisysteme Suchmaschinen, Vorschaubilder und Zeitstempel innerhalb von Sekunden zurückzugeben, selbst bei sehr großen Datensätzen. In größeren Deployments profitiert die Abfrageleistung in einer Multi-Site-Umgebung von Edge-Indexierung und föderierten Abfragen, die zentrale Engpässe reduzieren. Dadurch können Teams mit ähnlicher Geschwindigkeit über viele Standorte suchen wie bei Einzelstandort-Abfragen.

Zweitens hilft Analytik, Abruf- und Wiedergabelasten zu steuern. Wenn eine Abfrage viele Treffer zurückliefert, priorisiert das System Ergebnisse nach Konfidenzscore, Relevanz und zeitlicher Nähe. Diese zielgerichtete Suche reduziert Wiedergabeanforderungen an Speicherserver und die Aufmerksamkeit der Bediener. Visionplatform.ai unterstützt skalierbare Deployments von wenigen Streams bis zu Tausenden und integriert sich mit Videomanagementsystemen, um Indexierungsaufgaben zu verteilen.

Drittens: Betrachten Sie einen kommunalen Fall: Ein städtisches Überwachungsnetz verarbeitet etwa 1 PB Videomaterial pro Monat. Mit verteilter Indexierung und serverseitigen Agents shardet das System Metadaten über mehrere Knoten. Folglich können Ermittler eine erweiterte Suche durchführen, die Kandidatenclips aus Dutzenden von Kameras in unter einer Minute zurückgibt. Dieser Ansatz bewahrt die Fähigkeit, nach Beweisen in großem Maßstab zu suchen, ohne zusätzliche Hardware hinzuzufügen oder Video offsite zu verschieben.

Schließlich beeinflusst das Systemdesign die Abfragelatenz. Einzelstandort-Deployments zeigen oft geringere absolute Latenz, während Multi-Site-Abfragen Netzwerk-Overhead hinzufügen. Zur Milderung können Caching und Prefetching populärer Zeitachsen konstante interaktive Performance liefern. Kurz gesagt, verteilte Architekturen und durchdachtes Analytik-Design machen forensische Suche sowohl schnell als auch skalierbar für Genetec und andere VMS-Plattformen (HIKVISION-Protokoll-Forschung).

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Verwendung von Videoanalyse und Kennzeichenerkennung zur Verbesserung der Überwachung und Ermittlungen

Kennzeichenerkennung spielt in vielen Ermittlungen eine zentrale Rolle. KI-basierte Systeme zur Kennzeichenerkennung liefern hohe Leseraten und geringe Latenz. In realen Einsätzen erzielen moderne Modelle schnelle Lesungen mit akzeptablen Fehlalarmraten, wenn Kameras richtig positioniert sind. Außerdem schafft die Verknüpfung eines Kennzeichens über mehrere Kameras hinweg eine Bewegungsaufzeichnung, die Ermittler nutzen, um Routen zu rekonstruieren und Haltepunkte zu identifizieren.

Zweitens bereichert die Kombination aus Kennzeichenerkennung, Objektverfolgung und Fahrzeugklassifizierung den Datensatz. Die Kenntnis des Fahrzeugtyps neben dem Kennzeichen hilft Ermittlern, Hinweise zu priorisieren. Beispielsweise kann eine Abfrage nach Kennzeichen plus Fahrzeugtyp die Ergebnisse auf die wahrscheinlichsten Treffer reduzieren. Diese gezielte Suche ist in Verkehrsüberwachung, Parkraummanagement, Perimeterschutz und Verlustprävention von unschätzbarem Wert.

Drittens ist die standortübergreifende Verknüpfung entscheidend. Wenn ein LPR-System ein Kennzeichen an einem Tor liest und später an einem anderen, verknüpft das System diese Ereignisse über mehrere Kameras und Feeds hinweg. Infolgedessen können Untersuchungsteams Zeitabläufe mit Zuversicht rekonstruieren. Diese Fähigkeit unterstützt Verkehrsuntersuchungen und strafrechtliche Ermittlungen, in denen Fahrzeugbewegungen ein zentrales Element sind.

Außerdem liefert die Integration von LPR mit VMS- und Zutrittskontrollsystemen operativen Kontext. Beispielsweise zeigt die Korrelation einer Kennzeichenlesung mit einem Torauf-Event die Legitimität des Zugangs. Visionplatform.ai integriert ANPR/LPR-Analytik mit VMS-Daten und kann diese Korrelationen dem Bediener darstellen. Dadurch erfolgen schnelle Verifizierungen, Fehlalarme werden reduziert und Sicherheits- sowie Schutzziele werden unterstützt.

Schließlich kann automatisiertes LPR nachgelagerte Workflows auslösen, wie automatisierte Alarme oder Eindämmungsmaßnahmen. In Kombination mit granularen Suchfiltern und KI-Agenten wird die Kennzeichenerkennung Teil einer KI-gestützten Suchpipeline, die Ermittlern hilft, relevante Aufnahmen zu finden und Fälle schneller abzuschließen.

Granulare Suchfilter und erweiterte Suche für effiziente forensische Ergebnisse mit KI

Granulare Suchfilter ermöglichen Ermittlern, Abfragen nach Objekttyp, Bewegungsvektor und Farbe zu verfeinern. Beispielsweise könnte ein Suchprofil „Person“, Bewegungsrichtung zu einem Ausgang hin und ein rotes Jacken-Farb-Tag kombinieren. Erweiterte Suchmodule bewerten dann Ergebnisse nach Relevanz und nach Konfidenz. Das hilft Analysten, Clips für die Wiedergabe zu priorisieren. Außerdem reduziert die Integration von Gesichtserkennungs- und Kennzeichenerkennungsausgaben in dieselbe Abfrage den Bedarf an separaten Toolchains.

Als Nächstes verbindet erweiterte forensische Suche VLM-generierte Beschreibungen mit strukturierten Indizes. Der VP Agent Search von Visionplatform.ai verwandelt Videoinhalte in durchsuchbaren Text. Folglich können Ermittler Freitextsuchen durchführen, die der menschlichen Beschreibung von Ereignissen ähneln. Das macht die Suche intuitiver und verringert die Schulungszeit für neue Bediener. Gleichzeitig sorgt serverseitige Verarbeitung dafür, dass Modelle und Video lokal bleiben und so die Einhaltung von Datenschutzanforderungen und dem EU-KI-Gesetz unterstützt wird.

Drittens sind predictive Search und Anomalieerkennung die nächste Grenze. Machine-Learning-Modelle können anomale Muster aufzeigen, die menschliche Filter übersehen. Beispielsweise markiert ein Anomalie-Detektor Bewegungsmuster, die vom Baseline-Verhalten abweichen. Anschließend kann eine KI-gestützte Suche ähnliche vergangene Ereignisse zurückgeben, was bei Ermittlungen und der Mustererkennung hilft. Die Kombination aus granularen Filtern und prädiktiven Modellen bietet ein mächtiges Werkzeug für proaktives und reaktives Arbeiten.

Schließlich machen praktische Funktionen wie durchsuchbare Vorschaubilder, Zuschneiden der Wiedergabe und Export-Workflows die Ergebnisse vor Gericht nutzbar. Erweiterte Suche unterstützt Verkettung: Eine Abfrage liefert Clips, der Bediener verfeinert anhand visueller Prüfungen und die Plattform annotiert die Teilmenge für den Export als Videobeweis. Dieser Workflow reduziert die kognitive Belastung von Ermittlern und ermöglicht Teams, sich auf Interpretation statt auf Abruf zu konzentrieren.

FAQ

Was ist forensische Videosuche und warum ist sie wichtig?

Forensische Videosuche ist der Prozess, relevante Videobeweise in Überwachungsarchiven zu lokalisieren und zu extrahieren. Sie ist wichtig, weil sie Ermittlern Zeit spart, die Arbeitsbelastung reduziert und die Chancen erhöht, Fälle zu lösen, indem sie schnell relevante Aufnahmen hervorbringt.

Wie verbessert KI forensische Ermittlungen?

KI automatisiert Erkennung, Indexierung und Rangfolge von Ereignissen, was die Sichtung beschleunigt und manuelle Schritte reduziert. KI verknüpft außerdem verwandte Clips über Kameras und Zeitachsen hinweg, sodass Ermittler Ereignissen folgen und Fälle schneller abschließen können.

Können Metadaten wirklich Ermittlungen beschleunigen?

Ja. Metadaten wie Zeitstempel, Kamera-ID und Objekttags können Tausende Stunden Video auf Minuten reduzieren. Dieser gezielte Ansatz reduziert Abruf- und Wiedergabeanforderungen und vereinfacht die Beweissicherung.

Ist es möglich, Aufnahmen von verschiedenen VMS- und Kameramarken zu vereinheitlichen?

Ja. Mithilfe von APIs und Partnerintegrationen können Systeme Drittanbieter-Video und VMS-Ereignisse in ein einzelnes durchsuchbares Repository zusammenführen. Integrationen mit gängigen Plattformen wie Genetec Security Center helfen dabei, eine einheitliche Plattform für standortübergreifende Ermittlungen zu schaffen.

Wie genau ist die Kennzeichenerkennung unter realen Bedingungen?

Die Genauigkeit von LPR hängt von Kamerapositionierung, Beleuchtung und Bildauflösung ab, aber moderne Systeme erzielen hohe Leseraten, wenn sie korrekt konfiguriert sind. Das Verknüpfen von Kennzeichenlesungen über Kameras liefert wertvolle Bewegungsdaten für Ermittlungen.

Welche Rolle spielt Deep Learning in der Videoforensik?

Deep Learning extrahiert robuste Merkmale für Gesichter, Fahrzeuge und Verhaltensweisen, was das Matching über Kamerawinkel und Qualitätsunterschiede hinweg verbessert. Es treibt auch Anomalieerkennung und prädiktive Suche voran, um verdächtige Muster früher zu erkennen.

Wie hilft On-Prem-Verarbeitung bei der Compliance?

On-Prem-Verarbeitung hält Videodaten und Modelle innerhalb der Organisation, reduziert Risiken durch Cloud-Übertragungen und hilft, rechtliche und regulatorische Anforderungen wie das EU-KI-Gesetz zu erfüllen. Sie unterstützt außerdem prüfbare Ketten der Beweissicherung für Videobeweise.

Kann erweiterte forensische Suche mit Kameras ohne eingebaute Analytik arbeiten?

Ja. Serverseitige Indexierung und maschinelle Bildverarbeitung können aufgezeichnetes Video von Kameras ohne eingebettete Analytik analysieren. Die Plattform kann Metadaten und Vorschaubilder generieren, um durchsuchbaren Zugriff zu ermöglichen.

Wie unterstützen KI-Agenten Bediener im Kontrollraum?

KI-Agenten verifizieren Alarme, liefern kontextuelle Erklärungen und empfehlen Maßnahmen basierend auf korrelierten Daten aus Video, Zutrittskontrolle und Verfahren. Das reduziert Fehlalarme und unterstützt schnellere Entscheidungsfindung.

Wo kann ich mehr über auf Flughäfen fokussierte forensische Suchfunktionen erfahren?

Für flughafenspezifische Lösungen siehe Ressourcen zu forensischer Suche an Flughäfen und verwandten Erkennungsfunktionen wie Personenerkennung und ANPR/LPR an Flughäfen. Diese Seiten erklären, wie integrierte Analytik operative und sicherheitsrelevante Anforderungen unterstützt: forensische Durchsuchungen in Flughäfen, Personenerkennung an Flughäfen, und ANPR/LPR an Flughäfen.