Recherche vidéo par IA : Fondamentaux de l’analyse vidéo événementielle en vidéosurveillance

La recherche CCTV basée sur les événements change la manière dont les équipes gèrent de grands volumes d’images. La recherche vidéo par IA indexe les séquences par événements, et non par le temps. Cette approche remplace la revue manuelle lente par une récupération rapide et ciblée. La revue vidéo traditionnelle obligeait les opérateurs à regarder des heures d’enregistrements. En revanche, les systèmes événementiels extraient le sens, étiquettent les incidents et rendent la vidéo enregistrée consultable en quelques secondes. Le résultat transforme la réponse et la gestion des dossiers pour les opérations de sûreté et de sécurité. De plus, les systèmes d’IA utilisent l’apprentissage profond et des modèles d’apprentissage pour créer des descriptions structurées des personnes ou des objets. Par exemple, la détection d’objets moderne et l’IA visuelle peuvent étiqueter les classes d’objets, identifier des personnes ou des objets, et signaler des événements spécifiques sans intervention humaine. En conséquence, les enquêteurs trouvent instantanément les séquences pertinentes, ce qui aide les investigations et réduit les erreurs humaines.

Les composants centraux incluent des moteurs de détection, des extracteurs de métadonnées, des services d’indexation et une interface de recherche. L’IA prend en charge la détection et la description. Ensuite, les métadonnées stockent des attributs tels que l’heure, l’emplacement, la classe_d_objet et le comportement. Les métadonnées rendent les données vidéo consultables et permettent aux utilisateurs d’interroger l’archive en langage naturel. Grâce à la recherche intelligente par IA, les opérateurs peuvent saisir une requête en langage courant et obtenir des résultats précis sur l’ensemble des flux de caméras. Cette capacité de recherche alimentée par l’IA réduit le temps par alarme et accélère les inspections. Pour les aéroports et les déploiements vidéo d’entreprise, il est courant d’associer l’IA aux systèmes de gestion vidéo (VMS) pour un fonctionnement fiable. visionplatform.ai s’appuie sur ce principe en ajoutant une couche de raisonnement pour transformer les détections en informations opérationnelles et en aide à la décision.

L’indexation basée sur les événements accélère les opérations de sécurité dans de nombreux cas d’usage. Pour les équipes de sécurité, elle permet une vérification rapide des menaces et des preuves exportables pour les forces de l’ordre. Pour les opérations, elle soutient les audits de contrôle d’accès et la détection d’anomalies de processus. Pour la surveillance du trafic, la reconnaissance des plaques et le suivi des véhicules réduisent le temps d’investigation. Des études montrent que les systèmes intelligents peuvent améliorer les taux de détection mais rencontrent encore des problèmes en conditions nocturnes ; par exemple, un système de surveillance du trafic a rapporté une précision de 56,7 % en conditions nocturnes, suggérant le besoin de données synthétiques et de modèles améliorés (56,7 % de précision en conditions nocturnes). Dans l’ensemble, la recherche basée sur les événements transforme la vidéo en renseignements consultables et exploitables tout en réduisant la fatigue liée aux alarmes et en rendant de grandes quantités d’enregistrements de nouveau utiles.

Intégration des métadonnées et de la détection d’objets entre caméras dans le VMS

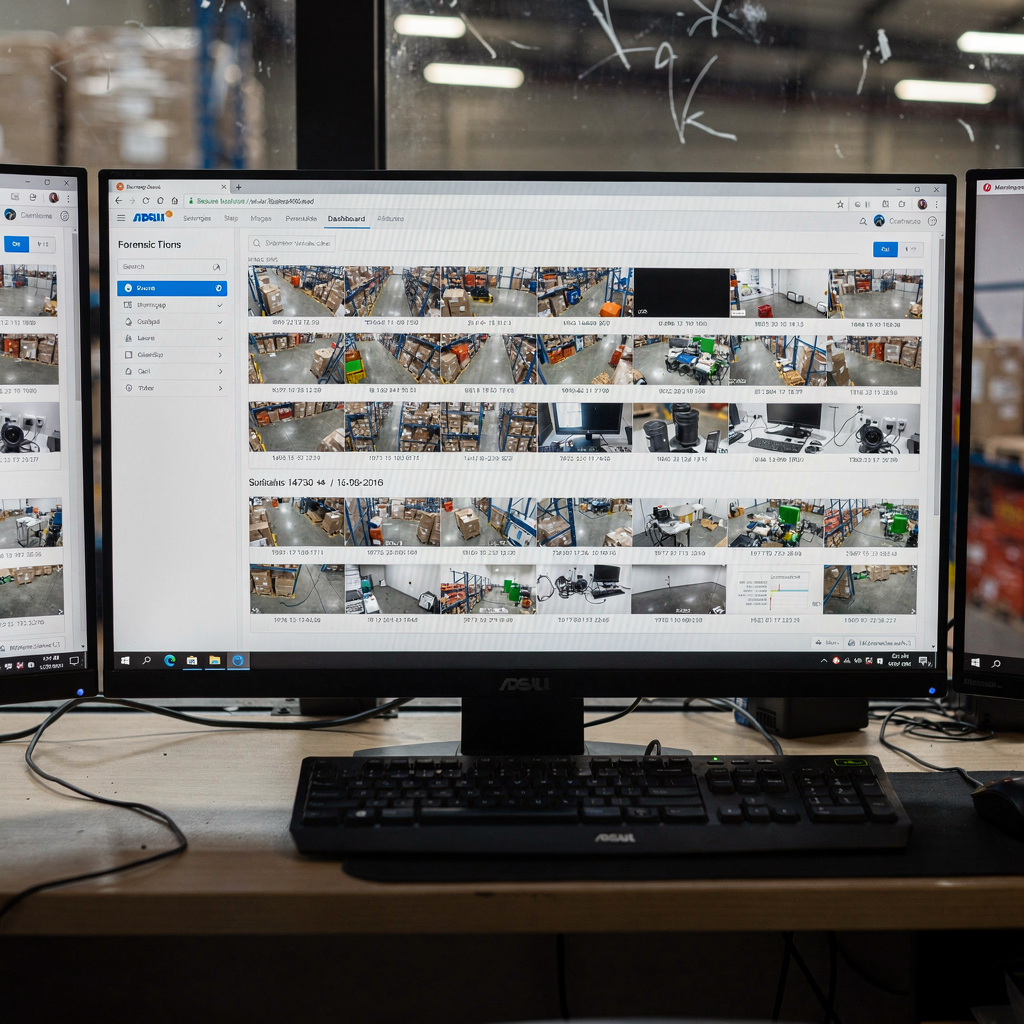

L’étiquetage des métadonnées et la détection d’objets fonctionnent de concert pour indexer les séquences afin que les opérateurs puissent retrouver rapidement des événements spécifiques. D’abord, la détection d’objets identifie les personnes, véhicules et autres cibles. Ensuite, les métadonnées enregistrent des attributs tels que la couleur, la direction, le comportement et le texte de la plaque d’immatriculation. Puis le VMS indexe ces tags pour que les utilisateurs puissent interroger l’archive. En pratique, une configuration moderne de système de gestion vidéo diffuse les événements issus de l’analytique des caméras et stocke des métadonnées compactes au lieu des séquences brutes. Cette approche évolue mieux et réduit les coûts tout en préservant la possibilité de rouvrir les séquences brutes si nécessaire. La recherche médico-légale en bénéficie car seules les séquences pertinentes sont extraites pour une revue détaillée et une exportation de preuves.

La liaison de plusieurs flux de caméras crée une recherche unifiée sur un site. Un flux de travail inter-caméras permet aux opérateurs de retracer une personne à travers les systèmes de caméras et de construire une chronologie des actions. Par exemple, un membre du personnel peut rechercher quelqu’un qui traîne près d’une porte et ensuite suivre automatiquement cette personne à travers plusieurs vues de caméras. Cette corrélation inter-caméras aide à vérifier les alarmes et réduit les faux positifs. visionplatform.ai prend en charge ces flux de travail avec un VP Agent qui expose les données du VMS et convertit la vidéo en descriptions lisibles par l’humain afin que les utilisateurs puissent rechercher sans identifiants de caméra. Pour en savoir plus sur les détecteurs de flânage et leur intégration, voir notre page sur la détection de flânage (détection de flânage dans les aéroports).

Les exigences du VMS pour un échange transparent de métadonnées incluent des API ouvertes, des schémas d’événements standardisés, et la prise en charge de MQTT ou des webhooks. De plus, les systèmes doivent permettre un contrôle bidirectionnel afin que l’IA puisse signaler un incident et que le VMS puisse appeler un rappel pour la récupération des séquences enregistrées. L’intégration avec les systèmes de contrôle d’accès et de gestion des affaires ajoute du contexte à la prise de décision. Pour ceux qui déploient à grande échelle, considérez la compatibilité avec des plateformes tierces comme Genetec Security Center pour des rapports centraux et des tableaux de bord unifiés (recherche médico-légale dans les aéroports). Enfin, assurez-vous que le VMS et les modules d’IA maintiennent la localité des données si la conformité exige un traitement sur site. Cela préserve la confidentialité et répond à l’alignement sur le règlement européen sur l’IA pour les sites sensibles.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Optimisation des alertes et de la détection pilotées par l’IA pour accélérer les enquêtes

Les alertes pilotées par l’IA modifient la manière dont les équipes réagissent aux incidents. Plutôt que de recevoir des alarmes brutes, les opérateurs obtiennent des notifications vérifiées et expliquées qui incluent le contexte et des scores de confiance. Par exemple, une alerte peut signaler une violation de périmètre, inclure des instantanés vidéo et lister les journaux de contrôle d’accès corroborants. Cela rend chaque notification actionnable et réduit le temps nécessaire au triage. Le VP Agent Reasoning de visionplatform.ai vérifie les alarmes en corrélant les événements du VMS, les métadonnées et les contrôles procéduraux, ce qui aide les enquêteurs et diminue les faux positifs.

Les règles de détection incluent le flânage, la violation de périmètre, l’intrusion et les objets abandonnés. Lorsqu’un système détecte une personne qui flâne près d’une entrée sécurisée, il déclenche une notification et stocke l’événement comme métadonnée consultable. Cet événement devient partie intégrante de l’index de recherche médico-légale afin que les utilisateurs puissent ultérieurement interroger des incidents similaires. Pour les workflows de plaques d’immatriculation, la détection d’une plaque peut être comparée à des listes de surveillance et signaler instantanément les véhicules d’intérêt. Des études montrent que les systèmes IVS multi-caméras améliorent la détection d’événements et soutiennent des infrastructures de ville intelligente plus performantes (avantages des caméras en réseau).

En quantifiant l’impact, les alertes automatisées peuvent réduire les temps de revue de plusieurs ordres de grandeur. Par exemple, remplacer la revue manuelle d’heures de vidéo par des clips basés sur des événements peut réduire le temps d’enquête de plusieurs heures à quelques minutes. De plus, l’IA qui valide une alarme en recoupant des capteurs additionnels réduit les faux positifs et diminue ainsi les interventions inutiles. En pratique, les équipes rapportent des décisions plus rapides et moins d’escalades lorsque des agents IA fournissent des actions suggérées et des dossiers d’enquête préremplis. Un flux de travail clair qui lie les alertes à la gestion des affaires et à l’exportation de preuves rend la salle de contrôle plus efficiente et permet aux opérateurs de se concentrer sur les incidents complexes plutôt que sur la validation de routine.

Exploiter la vidéo intelligente pour une recherche médico-légale évolutive et la revue de vidéos brutes

Les fonctionnalités vidéo intelligentes filtrent la vidéo brute en clips spécifiques à des événements et rendent les archives consultables. Au lieu de parcourir des heures d’images, un enquêteur peut extraire des clips pertinents filtrés par comportement, classe d’objet ou plaque d’immatriculation. L’outil de recherche médico-légale fournit ensuite un accès au niveau de l’image et des preuves exportables. Ce flux transforme la vidéo brute en renseignements exploitables tout en gardant les séquences brutes disponibles pour les procédures légales. Pour des archives massives, des architectures évolutives indexent les métadonnées séparément des blobs vidéo afin de réduire le stockage et d’accélérer les requêtes.

Les stratégies de stockage évolutives incluent la rétention à niveaux, l’accélération GPU sur site et des magasins d’objets indexés. Par exemple, les événements chauds et leurs images associées peuvent rester sur un stockage haute vitesse, tandis que les séquences brutes plus anciennes sont archivées. Lorsqu’un enquêteur interroge l’archive, le système ne diffuse que les images pertinentes, pas les fichiers entiers, ce qui réduit les temps de récupération et la bande passante. Cette approche rend les solutions vidéo d’entreprise pratiques pour des sites disposant de milliers de caméras et de grandes quantités de données enregistrées. Pour les environnements à haute sécurité comme un aéroport, une combinaison d’inférence IA locale et de politiques de rétention robustes soutient la conformité et la récupération rapide des preuves (plaques d’immatriculation et ANPR dans les aéroports).

La recherche médico-légale nécessite des outils qui prennent en charge les requêtes en langage naturel, les chronologies et la corrélation multi-sources. Avec un modèle Vision-Langage, les opérateurs peuvent demander « toutes les alarmes où il n’y a pas eu d’intrusion réelle » et recevoir des clips exportables, des horodatages et des notes contextuelles. Cette capacité de recherche alimentée par l’IA réduit la dépendance à l’étiquetage manuel et accélère les revues juridiques. De plus, l’intégration à la gestion des affaires automatise la création de rapports et les enregistrements de chaîne de possession afin que les preuves restent recevables. En conséquence, les équipes obtiennent des résultats précis plus rapidement, ce qui améliore les résultats tant pour la sécurité que pour les enquêtes opérationnelles.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Amélioration des capacités de recherche avec la reconnaissance de plaques et la détection de flânage

Les workflows de reconnaissance de plaques sont au cœur du suivi des véhicules et des listes de surveillance. D’abord, un moteur ANPR lit la plaque d’un véhicule en mouvement. Ensuite, le système compare la plaque aux listes et déclenche une alerte pour les véhicules d’intérêt. Cette alerte est liée à des horodatages et des flux de caméras pour que les opérateurs puissent instantanément retrouver les déplacements antérieurs et exporter des preuves. La combinaison de la reconnaissance de plaques et du suivi inter-caméras permet aux enquêteurs de retracer des itinéraires sur un campus ou une ville. Pour les déploiements aéroportuaires, l’ANPR soutient la gestion du bord et le filtrage de sécurité, et s’associe naturellement à d’autres analytiques caméra pour offrir une image plus complète.

Les algorithmes de détection de flânage signalent les comportements piétonniers anormaux en surveillant le temps passé sur place, la proximité des zones restreintes et les motifs de mouvement. Lorsqu’une personne reste près d’infrastructures sensibles, le système crée un événement qui devient consultable. Dans ces cas, la recherche se transforme d’une simple recherche par mot-clé en une chronologie basée sur le comportement. Les outils qui prennent en charge à la fois le flânage et l’ANPR peuvent corréler une personne suspecte avec un véhicule, offrant une reconstitution rapide de l’incident et des pistes d’enquête claires.

Combinées, l’ANPR et la détection de flânage produisent une puissante corrélation inter-événements. Par exemple, si un flânage est détecté près d’un quai de chargement et qu’une observation de plaque correspond à un véhicule d’intérêt, le système crée un dossier lié avec les clips pertinents, les métadonnées et les étapes suggérées suivantes. Ces résultats exportables réduisent la revue humaine et aident les enquêteurs à se concentrer sur les incidents à forte probabilité. En pratique, déployer ces fonctionnalités sur plusieurs emplacements de caméras réduit le temps de résolution et améliore la conscience situationnelle. Pour en savoir plus sur la détection spécifique au flânage sur les sites de passage, consultez notre ressource sur la détection de flânage dans les aéroports (détection de flânage dans les aéroports).

Réduction de la bande passante et aide aux équipes de sécurité avec l’analytique IA

Les coûts de bande passante et de stockage augmentent rapidement avec les séquences brutes. L’analytique IA aide en traitant la vidéo en périphérie et en n’envoyant que les métadonnées ou les clips d’événements sur le réseau. Par exemple, un nœud en périphérie peut exécuter la détection d’objets par IA et ne diffuser que des alertes et des vignettes à faible débit vers la salle de contrôle. Cela préserve la bande passante tout en tenant les opérateurs informés instantanément. L’utilisation de l’IA en périphérie réduit la quantité de données vidéo quittant un site, ce qui soutient la confidentialité et les exigences de conformité locale. Visionplatform.ai met l’accent sur le traitement sur site pour garder les modèles et la vidéo à l’intérieur de l’environnement et éviter des sorties cloud inutiles.

Les techniques pour un streaming efficace en bande passante incluent des fréquences d’images adaptatives, l’extraction sélective d’images pour les événements, et des feuilles de métadonnées compactes pour chaque incident. De plus, le VMS et l’IA peuvent négocier pour maintenir les flux des caméras à faible priorité à des débits réduits jusqu’à ce qu’un événement déclenche un streaming de meilleure qualité. Ces méthodes réduisent les coûts et permettent à des milliers de caméras de rester gérables sans dégrader la capacité d’enquête. En conséquence, les équipes de sécurité reçoivent des alertes exploitables et peuvent retrouver instantanément les images critiques sans épuiser le réseau.

Des tableaux de bord centralisés agrègent les alertes, les métadonnées et les statuts des dossiers afin que les opérateurs obtiennent des informations opérationnelles en une seule vue. Ces tableaux de bord prennent en charge des flux de travail guidés et réduisent la charge cognitive en recommandant des actions ou en préremplissant des rapports. En combinant des alertes pilotées par l’IA avec la gestion des dossiers et l’automatisation des procédures, les équipes traitent davantage d’événements avec le même personnel. Finalement, l’utilisation intelligente de l’analytique IA et du traitement en périphérie rend les systèmes de surveillance évolutifs, rentables et plus utiles pour la sécurité comme pour la sûreté.

FAQ

Qu’est-ce que la recherche CCTV basée sur les événements ?

La recherche CCTV basée sur les événements indexe la vidéo par événements détectés plutôt que par le temps. Cela permet aux opérateurs de récupérer rapidement des clips liés à des comportements, objets ou incidents spécifiques sans regarder des heures d’enregistrements.

Comment les métadonnées améliorent-elles la recherche ?

Les métadonnées enregistrent des attributs comme l’heure, l’emplacement, le type d’objet et le comportement. En conséquence, les recherches retournent des résultats ciblés et les enquêteurs peuvent interroger l’archive par termes descriptifs ou critères de recherche au lieu d’identifiants de caméra.

L’IA peut-elle réduire les faux positifs ?

Oui. Les systèmes d’IA qui corrèlent plusieurs sources et appliquent des contrôles contextuels réduisent les faux positifs. Les systèmes qui vérifient les alertes avec le contrôle d’accès ou plusieurs perspectives caméra fournissent des résultats plus précis et diminuent les réponses inutiles.

Quel rôle joue la reconnaissance de plaques ?

La reconnaissance de plaques aide à suivre les véhicules et à les comparer aux listes de surveillance. Elle soutient la médecine légale des véhicules, la gestion du bord et l’identification rapide des véhicules d’intérêt à travers les flux de caméras.

Ai-je besoin de nouvelles caméras pour utiliser la recherche par IA ?

Pas toujours. De nombreux déploiements exploitent des caméras existantes et ajoutent l’IA en périphérie ou dans le VMS. Toutefois, des caméras à plus haute résolution ou compatibles IR peuvent améliorer la précision pour certaines tâches de détection.

Comment fonctionne la recherche médico-légale ?

La recherche médico-légale indexe les métadonnées et offre un accès au niveau de l’image aux clips pertinents. Les enquêteurs peuvent interroger par comportements ou descriptions et exporter des clips et des horodatages pour la gestion des preuves.

Les analytiques IA peuvent-elles fonctionner sur site pour la conformité ?

Oui, l’IA sur site garde la vidéo et les modèles à l’intérieur de votre environnement et réduit l’exposition au cloud. Cela soutient la conformité, l’auditabilité et s’aligne sur des régimes de protection des données plus stricts.

Combien de bande passante l’IA peut-elle économiser ?

Des quantités significatives. En ne diffusant que des événements, des vignettes ou des métadonnées au lieu des flux complets, les systèmes réduisent les coûts de bande passante et de stockage. Le traitement en périphérie réduit encore la charge réseau tout en préservant l’accès aux séquences nécessaires.

Quel est l’avantage de la recherche inter-caméras ?

La recherche inter-caméras retrace les personnes ou les véhicules à travers plusieurs vues de caméras, permettant une reconstitution d’incident plus rapide. Cette capacité transforme la vidéo en une chronologie opérationnelle plutôt qu’en clips isolés.

À quelle vitesse les équipes peuvent-elles trouver les séquences pertinentes ?

Avec l’indexation basée sur les événements et la recherche pilotée par l’IA, les équipes peuvent trouver les séquences pertinentes en quelques secondes à quelques minutes au lieu de passer des heures en revue manuelle. Cette rapidité améliore les résultats et favorise une prise de décision accélérée.