assistant IA dans les enquêtes de sécurité : naviguer dans le paysage des menaces

D’abord, définissez ce qu’est un assistant IA. Un assistant IA est un système qui aide les humains en traitant des données, en proposant des suggestions et en accomplissant des tâches répétitives. Ensuite, dans les contextes de sécurité, un assistant IA fournit des analyses contextuelles, des recherches et des recommandations lors d’une enquête de sécurité. Il peut analyser des journaux, étiqueter des événements et mettre en évidence des preuves pertinentes pour un analyste. Par exemple, un assistant de sécurité qui prend en charge la vidéo et la télémétrie aide les opérateurs à prendre des décisions plus rapides et fondées sur des preuves.

Aussi, le paysage des menaces évolue constamment. De nouvelles menaces apparaissent rapidement. Des acteurs malveillants utilisent l’automatisation et des outils sophistiqués. Par conséquent, les équipes humaines ont besoin d’outils évolutifs pour suivre. Les outils d’IA aident les enquêteurs en repérant des motifs dans de grands ensembles de données qu’un seul analyste ne peut pas parcourir rapidement.

Les données montrent une dépendance croissante à ces systèmes. Dans des enquêtes, plus de 60 % des professionnels utilisent l’IA pour des conseils en matière de sécurité pendant le développement et la réponse aux incidents, ce qui reflète une adoption étendue au sein des équipes. Parallèlement, la prudence s’impose. Une étude majeure a constaté que 45 % des réponses de l’IA peuvent comporter des problèmes, donc la relecture reste essentielle.

De plus, un expert a observé que « AI assistants are transforming how security teams approach threat detection by providing real-time insights that were previously impossible to obtain at scale » (Akond Rahman). Cette citation met en évidence à la fois la promesse et la responsabilité. En pratique, les analystes en sécurité doivent associer les résultats de l’IA à une vérification humaine pour éviter les erreurs.

De plus, ce chapitre présente des mots-clés et des capacités que vous reverrez. Par exemple, un assistant IA aide au triage et au traitement rapide des requêtes. Il prend en charge le langage naturel et la recherche contextuelle. Il renforce la posture de sécurité en réduisant le temps nécessaire pour rassembler les informations critiques. Enfin, visionplatform.ai montre comment des systèmes d’IA sur site permettent aux salles de contrôle de rechercher des vidéos en langage naturel et de vérifier des alarmes tout en conservant les données sur place, ce qui favorise la conformité et accélère les enquêtes (préoccupations en matière de confidentialité et de conformité).

automatiser les opérations de sécurité et les alertes avec l’IA

D’abord, les outils pilotés par l’IA automatisent les opérations de sécurité routinières. Ils analysent la télémétrie et les journaux, corrèlent les événements et déclenchent une alerte lorsqu’ils détectent des schémas anormaux. Ensuite, ces outils s’intègrent aux plateformes SIEM pour alimenter les événements vérifiés dans les opérations de sécurité existantes. Par exemple, de nombreuses équipes acheminent les résultats vérifiés par l’IA vers Splunk pour une corrélation et une visualisation supplémentaires. Cela améliore le temps moyen de triage et réduit les tâches répétitives pour les analystes en sécurité.

De plus, l’IA peut rationaliser les flux d’alerte en temps réel. Une plateforme d’IA ingère des flux, attribue des scores aux événements, puis ouvre un ticket avec les éléments de preuve contextuels. Ensuite, un analyste en sécurité peut consulter la chronologie annotée, regarder un court extrait médico-légal et agir. Ce flux de travail libère les humains pour se concentrer sur une analyse à plus forte valeur ajoutée. Il réduit également les faux positifs en vérifiant plusieurs signaux avant de signaler un incident.

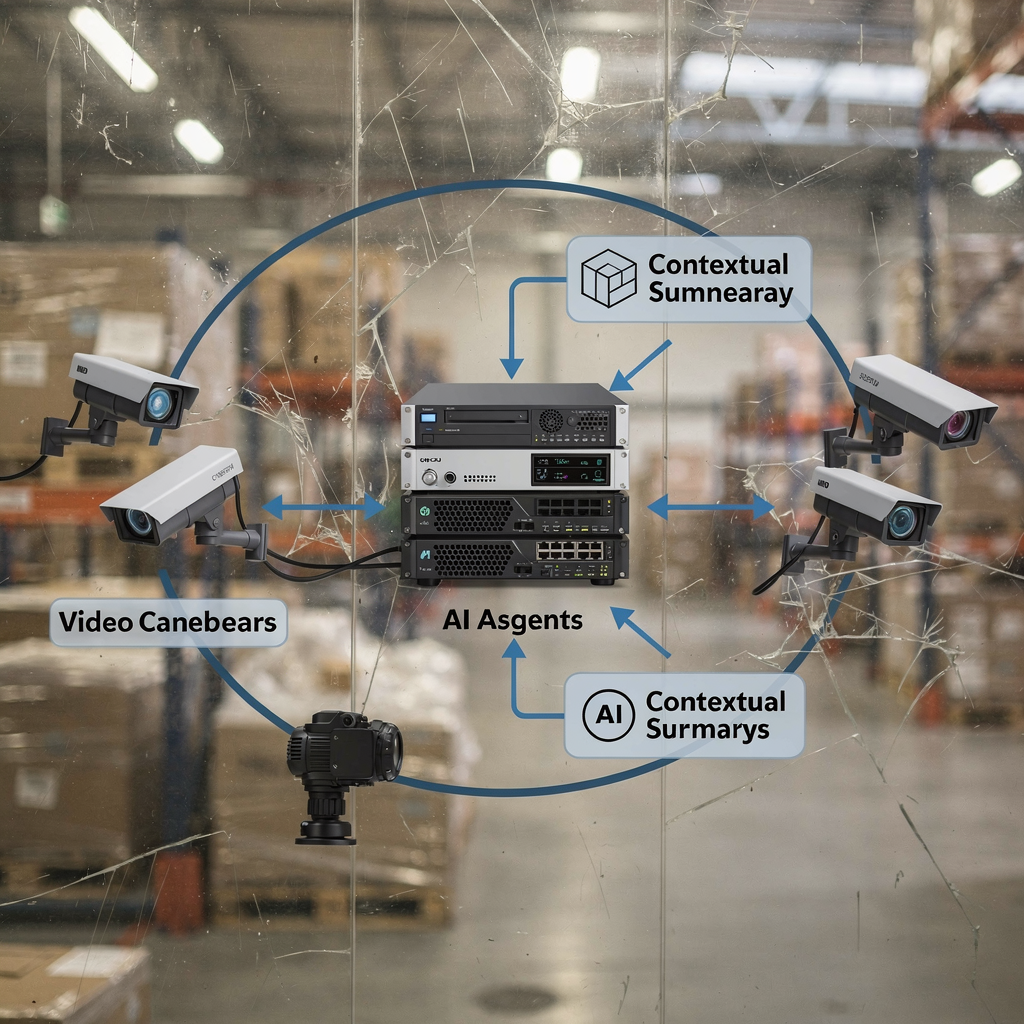

Les données appuient cette approche. Dans les environnements d’entreprise, les outils de surveillance pilotés par l’IA ont amélioré les taux de détection des menaces jusqu’à 30 % d’amélioration de la détection, ce qui réduit les temps d’investigation et de réponse. De plus, fournisseurs et équipes combinent désormais des agents IA et des LLM pour produire des résumés contextuels, ce qui accélère encore la prise de décision.

Par ailleurs, la fatigue liée aux alertes est un vrai problème. La vérification automatisée et la priorisation aident. Par exemple, un assistant de sécurité génératif peut résumer des événements et suggérer la cause la plus probable. Cela réduit la charge sur l’équipe de sécurité et améliore la précision. Une approche pilotée par l’IA doit cependant respecter la gouvernance et les contrôles d’accès. Par conséquent, de nombreuses organisations conservent les modèles sur site ou utilisent des déploiements hybrides pour protéger les données. visionplatform.ai, par exemple, propose un modèle de langage visuel sur site qui explique les événements vidéo et prend en charge l’automatisation agentique sans envoyer la vidéo vers des clouds externes.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Principaux cas d’utilisation d’un assistant IA pour accélérer l’équipe de sécurité

Premièrement, le triage et la priorisation des incidents. Un assistant IA aide à filtrer les alertes bruyantes et à classer les incidents de sécurité les plus urgents. Il vérifie les signaux contextuels, les rapproche des incidents antérieurs et recommande quels éléments nécessitent une attention immédiate. Cette étape de triage raccourcit le temps d’investigation et réduit les interruptions de travail des analystes en sécurité. En conséquence, les humains consacrent plus de temps à l’analyse des menaces complexes plutôt qu’au tri manuel.

Deuxièmement, la chasse aux menaces et la détection d’anomalies. Les modèles d’IA repèrent des motifs subtils et des activités menaçantes émergentes que les outils basés sur des règles manquent. Ils parcourent la télémétrie, les flux réseau et les descriptions vidéo pour détecter des comportements anormaux. Par exemple, la combinaison des métadonnées vidéo avec les journaux d’accès aide l’équipe de renseignement sur les menaces à repérer l’utilisation frauduleuse des identifiants ou une activité interne.

Troisièmement, la criminalistique numérique et la corrélation des preuves. L’IA assiste l’analyse des journaux, la construction de chronologies et la corrélation inter-sources. Les outils de recherche médico-légale permettent aux analystes d’interroger la vidéo, les métadonnées VMS et les journaux. visionplatform.ai propose une recherche médico-légale dans les aéroports qui transforme la vidéo enregistrée et les événements en descriptions lisibles par l’humain afin que les équipes puissent effectuer des recherches en requêtes simples.

Aussi, quantifier l’impact. Le triage automatisé peut réduire le temps de revue initiale de 40–60 % lors de déploiements pilotes. Le support à la chasse aux menaces peut réduire le temps moyen de détection dans une marge similaire. Les investigations médico-légales qui utilisent des résumés IA diminuent souvent le temps d’enquête manuelle de plusieurs heures par incident. Ces gains dépendent de la configuration, de la qualité des données et de la gouvernance.

Enfin, réduire les erreurs. Un flux de travail assisté par l’IA réduit les faux positifs et accélère la réponse confirmée. Ces cas d’utilisation reposent sur un réglage fin et une supervision humaine. En pratique, les équipes adoptent progressivement des assistants pilotés par l’IA. Elles commencent par des recommandations, puis activent des actions, et migrent ensuite vers une automatisation contrôlée. Cette approche progressive protège le programme de sécurité tout en démontrant un ROI clair pour les capacités de sécurité.

Gérer les données de sécurité dans le cloud et les SaaS avec l’IA

Premièrement, les défis de gestion des journaux et de la télémétrie dans des environnements multi-cloud et SaaS sont importants. Les journaux arrivent sous des formats variés. Les systèmes génèrent de grands volumes de télémétrie qui saturent la revue manuelle. De plus, les équipes de sécurité cloud doivent concilier rapidité et conformité. Les règles de résidence des données, comme le RGPD, compliquent le traitement transfrontalier.

Ensuite, l’IA accélère l’analyse des journaux, la corrélation et l’analyse des causes profondes. Un modèle peut normaliser des journaux disparates, étiqueter des entités et relier des événements connexes. Puis le modèle produit un résumé concis et suggère les étapes suivantes. Cette rationalisation réduit le temps passé à fouiller des fichiers bruts. Elle améliore aussi la précision des enquêtes en reliant des contextes que les humains peuvent manquer.

De plus, la confidentialité et la conformité comptent. VeraSafe avertit que « le traitement des informations personnelles par les systèmes d’IA doit être transparent et conforme aux réglementations sur la confidentialité » (VeraSafe sur la confidentialité de l’IA). Par conséquent, de nombreuses équipes choisissent des solutions sur site ou des clouds privés pour les vidéos et la télémétrie sensibles. L’approche sur site de visionplatform.ai soutient l’alignement avec la loi sur l’IA de l’UE et évite le déplacement des vidéos hors site, ce qui aide les équipes à gérer la conformité dans un monde multi‑locataire.

Par ailleurs, les intégrations SaaS nécessitent un contrôle d’accès rigoureux. Les agents IA doivent suivre le principe du moindre privilège lorsqu’ils se connectent aux systèmes. Par exemple, l’intégration des données VMS avec une plateforme IA doit respecter les politiques de conservation et les traces d’audit. Utilisez des exportations structurées, des webhooks et des API tokenisées pour garder le contrôle. De plus, la journalisation des décisions de l’IA et des actions automatisées facilite les audits et aide à établir les responsabilités lorsque des incidents surviennent.

Enfin, adoptez des pratiques pour renforcer la posture de sécurité. Validez les modèles avec des données de test. Suivez la traçabilité des données. Et déployez une surveillance pour la dérive des modèles. Ces étapes réduisent les risques et améliorent la confiance dans les enquêtes assistées par l’IA.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Responsabiliser les experts en sécurité avec l’IA pour une sécurité proactive

Premièrement, utilisez l’IA pour la modélisation prédictive des risques et les alertes précoces. Les modèles peuvent noter les actifs selon leur exposition probable, mettre en évidence les systèmes vulnérables et prédire où les attaquants pourraient agir ensuite. Cela aide les experts en sécurité à prioriser le patching et les contrôles défensifs. En conséquence, les équipes passent d’une posture réactive à une sécurité proactive. L’approche soutient la gestion de la posture sur l’ensemble des actifs et des fournisseurs cloud.

De plus, défendez les systèmes d’IA contre les attaques adverses et la manipulation. Les attaquants peuvent empoisonner les entrées ou concevoir des échantillons adverses qui modifient les sorties du modèle. Des experts notent que sécuriser l’IA est essentiel pour empêcher les attaquants d’exploiter les processus de décision (risques d’attaques contre l’IA). Par conséquent, les équipes doivent ajouter des contrôles d’intégrité, la sanitation des entrées et la surveillance d’un comportement suspect des modèles.

Ensuite, équilibre entre conseils automatisés et jugement humain. Un assistant IA aide à faire émerger des preuves et à suggérer une conduite à tenir. Cependant, les experts en sécurité conservent l’autorité pour les choix critiques. Ce schéma humain-dans-la-boucle réduit le risque lié aux recommandations incorrectes du modèle et préserve l’auditabilité. Par exemple, un flux de travail de sécurité alimenté par l’IA peut pré-remplir des rapports d’incident tout en exigeant qu’un humain approuve les notifications externes.

De plus, intégrez la connaissance du domaine. Le renseignement sur les menaces et les playbooks alimentent les modèles avec des règles contextuelles. Une équipe de renseignement peut fournir des exemples labellisés pour améliorer la détection. En outre, les outils qui tirent parti de l’IA générative produisent des analyses guidées et des résumés qui aident les analystes à poser des questions ciblées en langage naturel. Cette interaction en langage naturel rend les enquêtes plus accessibles et plus rapides.

Enfin, la gouvernance compte. Établissez des politiques pour les mises à jour des modèles, l’accès et la journalisation des incidents. Formez les analystes à valider les sorties de l’IA et à évaluer la confiance du modèle. Ces pratiques aident les équipes à prendre des décisions éclairées et à renforcer la sécurité au sein de l’organisation.

Exploiter l’IA pour accélérer les opérations de sécurité

Premièrement, les tendances futures pointent vers des intégrations plus avancées d’IA générative et de grands modèles de langage dans les enquêtes. Les équipes utiliseront des grands modèles de langage pour résumer des chronologies complexes, proposer des playbooks scriptés et générer des récits d’incident. De plus, des systèmes agentiques coordonneront plusieurs agents IA pour gérer des réponses en plusieurs étapes. Ces capacités accéléreront encore les enquêtes et la réponse.

Ensuite, appliquez les meilleures pratiques en matière de gouvernance, de validation et d’amélioration continue. Pilotez de nouvelles capacités dans un environnement contrôlé. Puis mesurez l’impact sur le temps moyen de détection et le temps moyen de réponse. Suivez aussi les faux positifs et ajustez les seuils. Cette gouvernance réduit les risques et permet de mettre à l’échelle une automatisation efficace.

De plus, créez une feuille de route claire pour une adoption progressive : pilote, montée en charge et mesure d’impact. Commencez par de petits cas d’utilisation tels que le triage des e-mails ou l’analyse des journaux. Ensuite, étendez pour intégrer l’analytique vidéo et les flux SIEM. visionplatform.ai montre comment les fonctionnalités sur site de l’agent VP peuvent faire passer une salle de contrôle de la détection brute à l’action contextuelle. Cette approche par étapes permet aux équipes d’adopter des flux de travail pilotés par l’IA tout en protégeant les données et les opérations.

Par ailleurs, combinez les compétences humaines avec les outils d’IA. Formez les analystes en sécurité aux questions en langage naturel et à l’analyse guidée. Utilisez des outils qui mettent en évidence l’information critique et fournissent des recommandations exploitables. Ce modèle hybride produit des capacités de sécurité renforcées et aide le programme de sécurité à mûrir.

Enfin, surveillez l’écosystème des menaces et des vulnérabilités. Les attaquants évoluent rapidement. Par conséquent, investissez dans des tests continus et des exercices de red teaming des assistants IA. Maintenez également la transparence et des traces d’audit pour toutes les actions automatisées. Ces étapes aident les équipes à accélérer les enquêtes, à renforcer la sécurité et à garder le contrôle à mesure que les technologies d’IA mûrissent.

FAQ

Qu’est-ce qu’un assistant IA dans une enquête de sécurité ?

Un assistant IA est un outil qui aide les enquêteurs en analysant les données, en corrélant les événements et en suggérant les étapes suivantes. Il accélère des tâches telles que l’analyse des journaux, la recherche de preuves et la priorisation des alertes tout en maintenant un humain dans la boucle pour les décisions critiques.

Quelle est la fiabilité des sorties de l’IA pour les décisions de sécurité ?

Les sorties de l’IA peuvent être très utiles mais ne sont pas infaillibles. Une étude majeure a montré que jusqu’à 45 % des réponses de l’IA à des requêtes de sécurité comportaient des problèmes, donc la relecture et la validation humaines restent essentielles.

L’IA peut-elle réduire le temps d’enquête ?

Oui. L’IA raccourcit le temps d’enquête en automatisant le triage, en corrélant les journaux et en faisant remonter les preuves pertinentes. Les organisations signalent des améliorations des taux de détection et des réductions du temps moyen de réponse lorsqu’elles adoptent des flux de travail assistés par l’IA (améliorations de la détection).

Comment l’IA gère-t-elle la sécurité cloud et la télémétrie SaaS ?

L’IA normalise et corrèle la télémétrie provenant de sources multi‑cloud et SaaS pour créer des chronologies unifiées. Les équipes doivent garantir la résidence des données et la conformité à la vie privée et préférer des déploiements sur site ou hybrides pour la vidéo ou les journaux sensibles afin de respecter des réglementations comme le RGPD.

Quels sont les cas d’utilisation courants de l’IA en sécurité ?

Les cas d’utilisation courants comprennent le triage des incidents, la chasse aux menaces, la détection d’anomalies, la criminalistique numérique et la corrélation des preuves. L’IA aide aussi à automatiser les flux de travail répétitifs et à pré-remplir les rapports d’incident pour accélérer les enquêtes.

Comment les organisations doivent-elles gouverner l’IA pour la sécurité ?

La gouvernance nécessite des politiques pour les mises à jour des modèles, l’accès aux données et la journalisation des audits. Pilotez d’abord les fonctionnalités, puis passez à l’échelle avec des métriques claires pour le temps moyen de détection et les faux positifs. Conservez l’approbation humaine pour les actions à haut risque.

Les systèmes d’IA sont-ils vulnérables aux attaques ?

Oui. Les modèles d’IA peuvent être confrontés à des entrées adverses et à des attaques par empoisonnement. Les experts recommandent d’ajouter des contrôles d’intégrité, une validation des entrées et une surveillance du comportement inhabituel des modèles pour réduire les risques (risques d’attaques contre l’IA).

Comment les assistants IA s’intègrent-ils aux outils existants comme SIEM ou Splunk ?

Ils s’intègrent via des API, des webhooks et des connecteurs pour envoyer des alertes enrichies dans les SIEM ou les tableaux de bord Splunk. Ils fournissent des événements annotés, des preuves contextuelles et des actions suggérées pour une réponse plus rapide.

L’IA peut-elle aider les enquêtes basées sur la vidéo ?

Oui. L’IA qui exploite des modèles de vision-langage sur site peut convertir la vidéo en descriptions interrogeables et vérifier les alarmes avec des données contextuelles. Par exemple, les fonctionnalités de recherche médico-légale permettent aux opérateurs de trouver des incidents en utilisant des requêtes simples et des chronologies.

Comment commencer à adopter l’IA dans mon programme de sécurité ?

Commencez petit avec un pilote axé sur un seul cas d’utilisation, comme le triage ou l’analyse des journaux. Mesurez l’impact, affinez les modèles et étendez. Utilisez des solutions sur site lorsque la confidentialité des données ou la conformité est une préoccupation, et formez les analystes à valider les sorties de l’IA.