KI-Assistent in Sicherheitsuntersuchungen: Navigation in der Bedrohungslandschaft

Zuerst definieren wir, was ein KI-Assistent ist. Ein KI-Assistent ist ein System, das Menschen unterstützt, indem es Daten verarbeitet, Vorschläge macht und sich wiederholende Aufgaben übernimmt. Als Nächstes: In Sicherheitskontexten liefert ein KI-Assistent kontextuelle Analysen, Suche und Empfehlungen während einer Sicherheitsuntersuchung. Er kann Protokolle parsen, Ereignisse kennzeichnen und relevante Beweise für einen Analysten hervorheben. Zum Beispiel hilft ein Sicherheitsassistent, der Video- und Telemetrie-Daten unterstützt, Betreiber schneller, evidenzbasierte Entscheidungen zu treffen.

Auch die Bedrohungslandschaft ändert sich laufend. Neue Sicherheitsbedrohungen tauchen schnell auf. Böswillige Akteure nutzen Automatisierung und ausgefeilte Werkzeuge. Daher benötigen menschliche Teams skalierbare Werkzeuge, um Schritt zu halten. KI-Tools unterstützen Ermittler, indem sie Muster über große Datensätze hinweg erkennen, die ein einzelner Analyst nicht schnell genug durchgehen kann.

Daten zeigen eine wachsende Abhängigkeit von diesen Systemen. In Umfragen nutzen über 60 % der Fachleute inzwischen KI für Sicherheitsberatung während der Entwicklung und der Incident-Response, was die breite Akzeptanz in Teams widerspiegelt (60 % nutzen KI für Sicherheitsberatung). Gleichzeitig ist Vorsicht geboten. Eine große Studie ergab, dass 45 % der KI-Antworten auf Sicherheitsanfragen Probleme enthalten, sodass eine Überprüfung weiterhin unerlässlich ist (45 % der KI-Antworten können Probleme enthalten).

Außerdem beobachtete ein Experte, dass „KI-Assistenten die Art und Weise, wie Sicherheitsteams Bedrohungserkennung angehen, verändern, indem sie Echtzeit-Einblicke liefern, die zuvor in dieser Größenordnung nicht möglich waren“ (Akond Rahman). Dieses Zitat hebt sowohl das Potenzial als auch die Verantwortung hervor. In der Praxis müssen Sicherheitsanalysten KI-Ergebnisse mit menschlicher Verifikation koppeln, um Fehltritte zu vermeiden.

Auch dieses Kapitel führt Schlüsselbegriffe und Fähigkeiten ein, die Sie wiedersehen werden. Ein KI-Assistent hilft beispielsweise bei Triage und schneller Abfragebearbeitung. Er unterstützt natürlichsprachliche und kontextuelle Suche. Er stärkt die Sicherheitslage, indem er die Zeit reduziert, die benötigt wird, um kritische Informationen zu sammeln. Schließlich demonstriert visionplatform.ai, wie On-Prem-KI-Systeme Leitstellen erlauben, Video per natürlicher Sprache zu durchsuchen und Alarme zu verifizieren, während die Daten vor Ort bleiben, was Compliance und schnellere Untersuchungen unterstützt (Datenschutz- und Compliance-Bedenken).

automate security operations and alert with ai

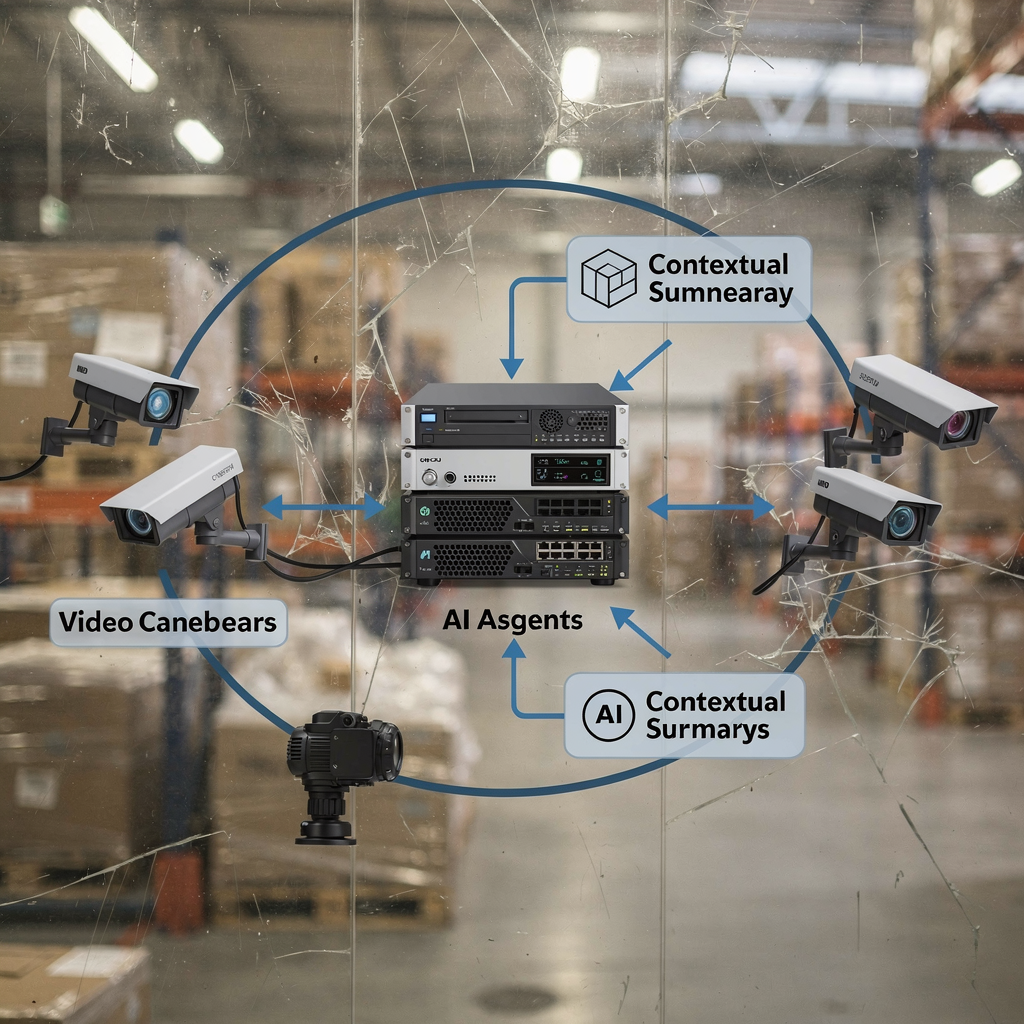

Zuerst automatisieren KI-gesteuerte Werkzeuge routinehafte Sicherheitsoperationen. Sie parsen Telemetrie und Protokolle, korrelieren Ereignisse und geben eine Warnung aus, wenn sie anomale Muster erkennen. Als Nächstes integrieren sich diese Werkzeuge in SIEM-Plattformen, um verifizierte Ereignisse in bestehende Sicherheitsoperationen einzuspeisen. Zum Beispiel leiten viele Teams KI-verifizierte Erkenntnisse in Splunk zur weiteren Korrelation und Visualisierung weiter. Dies verbessert die mittlere Zeit bis zur Triage und reduziert repetitive Aufgaben für Sicherheitsanalysten.

Außerdem kann KI Echtzeit-Alerting-Workflows straffen. Eine KI-Plattform nimmt Streams auf, bewertet Ereignisse und öffnet dann ein Ticket mit den kontextuellen Beweisen. Ein Sicherheitsanalyst kann dann die annotierte Timeline ansehen, einen kurzen forensischen Clip betrachten und handeln. Dieser Workflow entlastet Menschen, sodass sie sich auf analysespezifische Aufgaben mit höherem Wert konzentrieren können. Er reduziert auch False Positives, indem er mehrere Signale prüft, bevor ein Vorfall gemeldet wird.

Daten untermauern diesen Ansatz. In Unternehmensumgebungen haben KI-gesteuerte Überwachungstools die Erkennungsraten um bis zu 30 % verbessert, was Untersuchungs- und Reaktionszeiten verkürzt (bis zu 30 % Verbesserung der Erkennungsraten). Zusätzlich kombinieren Anbieter und Teams jetzt KI-Agenten und LLMS, um kontextuelle Zusammenfassungen zu erstellen, die Entscheidungen weiter beschleunigen.

Auch Alert-Fatigue ist ein reales Problem. Automatisierte Verifizierung und Priorisierung helfen. Zum Beispiel kann ein generativer KI-Sicherheitsassistent Ereignisse zusammenfassen und die wahrscheinlichste Ursache vorschlagen. Dies reduziert die Belastung des Sicherheitsteams und erhöht die Genauigkeit. Ein KI-gestützter Ansatz muss weiterhin Governance und Zugriffskontrollen respektieren. Daher halten viele Organisationen Modelle vor Ort oder nutzen hybride Bereitstellungen, um sensible Daten zu schützen. visionplatform.ai bietet beispielsweise ein On-Prem Vision Language Model, das Videoereignisse erklärt und agentische Automatisierung unterstützt, ohne Video an externe Clouds zu senden.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Key use cases of ai assistant to accelerate the security team

Erstens: Incident-Triage und Priorisierung. Ein KI-Assistent hilft, laute Alerts zu filtern und die dringendsten Sicherheitsvorfälle zu priorisieren. Er prüft kontextuelle Signale, gleicht sie mit früheren Vorfällen ab und empfiehlt, welche Punkte sofortige Aufmerksamkeit benötigen. Dieser Triage-Schritt verkürzt die Untersuchungszeit und reduziert Unterbrechungen in den Arbeitsabläufen der Sicherheitsanalysten. Infolgedessen verbringen Menschen mehr Zeit mit komplexer Bedrohungsanalyse anstatt mit manuellem Aussortieren.

Zweitens: Threat Hunting und Anomalieerkennung. KI-Modelle finden subtile Muster und aufkommende Bedrohungsaktivitäten, die regelbasierte Werkzeuge übersehen. Sie durchsuchen Telemetrie, Netzwerkflüsse und Videobeschreibungen, um abweichendes Verhalten zu erkennen. Zum Beispiel hilft die Kombination von Videometadaten mit Zugriffprotokollen dem Threat-Intelligence-Team, Missbrauch von Zugangsdaten oder Insider-Aktivitäten zu erkennen.

Drittens: Digitale Forensik und Beweiskorrelation. KI unterstützt beim Parsen von Logs, beim Aufbau von Zeitachsen und bei der Quellverknüpfung. Forensische Suchwerkzeuge ermöglichen Analysten Abfragen über Video, VMS-Metadaten und Protokolle hinweg. visionplatform.ai bietet forensische Suche, die aufgezeichnetes Video und Ereignisse in menschenlesbare Beschreibungen verwandelt, sodass Teams in einfachen Abfragen suchen können (forensische Suche in Flughäfen).

Außerdem: Auswirkungen quantifizieren. Triage-Automatisierung kann in Pilotprojekten die anfängliche Prüfzeit um 40–60 % reduzieren. Threat-Hunting-Unterstützung kann die mittlere Zeit bis zur Erkennung in ähnlichem Maße senken. Forensik, die KI-Zusammenfassungen nutzt, reduziert oft die manuelle Untersuchungszeit um Stunden pro Vorfall. Diese Gewinne hängen von der Einrichtung, der Datenqualität und der Governance ab.

Schließlich: Fehler reduzieren. Ein KI-unterstützter Workflow reduziert False Positives und beschleunigt bestätigte Reaktionen. Diese Anwendungsfälle beruhen auf sorgfältigem Tuning und menschlicher Aufsicht. In der Praxis übernehmen Teams KI-gestützte Assistenten schrittweise. Sie beginnen mit Empfehlungen, erlauben dann Aktionen und gehen später zu kontrollierter Automatisierung über. Dieser gestufte Ansatz schützt das Sicherheitsprogramm und zeigt gleichzeitig klaren ROI für Sicherheitsfunktionen.

Managing security data in cloud security and saas with ai

Zuerst: Die Herausforderungen beim Umgang mit Logs und Telemetrie in Multi-Cloud- und SaaS-Umgebungen sind erheblich. Logs liegen in unterschiedlichen Formaten vor. Systeme erzeugen große Mengen an Telemetrie, die manuelle Überprüfung überfordern. Zudem müssen Cloud-Sicherheitsteams Geschwindigkeit und Compliance austarieren. Datenresidenzregelungen wie die DSGVO erschweren grenzüberschreitende Verarbeitung.

Als Nächstes beschleunigt KI das Parsen von Logs, die Korrelation und Root-Cause-Analysen. Ein Modell kann unterschiedliche Logs normalisieren, Entitäten kennzeichnen und zusammenhängende Ereignisse verknüpfen. Anschließend erzeugt das Modell eine prägnante Zusammenfassung und schlägt nächste Schritte vor. Diese Straffung reduziert die Zeit, die für das Durchsuchen von Rohdateien benötigt wird. Sie verbessert auch die Genauigkeit der Untersuchung, indem Kontext verknüpft wird, den Menschen eventuell übersehen.

Auch Datenschutz und Compliance sind wichtig. Organisationen müssen Richtlinien einführen, die Trainingsdaten und Modellausgaben kontrollieren. VeraSafe warnt, dass „der Umgang mit personenbezogenen Daten durch KI-Systeme transparent und konform mit Datenschutzvorschriften sein muss“ (VeraSafe zu KI und Datenschutz). Deshalb entscheiden sich viele Teams für On-Prem-Lösungen oder private Clouds für sensible Video- und Telemetriedaten. Der On-Prem-Ansatz von visionplatform.ai unterstützt die Ausrichtung an dem EU AI Act und vermeidet das Verschieben von Video in die Cloud, was Teams hilft, Compliance in einer Multi-Tenant-Welt zu managen.

Weiterhin erfordern SaaS-Integrationen sorgfältige Zugriffskontrollen. KI-Agenten sollten das Least-Privilege-Prinzip befolgen, wenn sie sich mit Systemen verbinden. Zum Beispiel muss die Integration von VMS-Daten mit einer KI-Plattform Aufbewahrungsrichtlinien und Audit-Trails respektieren. Verwenden Sie strukturierte Exporte, Webhooks und tokenisierte APIs, um die Kontrolle zu behalten. Außerdem unterstützt die Protokollierung von KI-Entscheidungen und automatisierten Aktionen Audits und hilft, Verantwortlichkeiten bei Vorfällen nachzuverfolgen.

Schließlich: Praktiken übernehmen, um die Sicherheitslage zu stärken. Validieren Sie Modelle mit Testdaten. Verfolgen Sie die Datenherkunft. Und implementieren Sie Monitoring für Modelldrift. Diese Schritte reduzieren Risiko und erhöhen das Vertrauen in KI-unterstützte Untersuchungen.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Empowering security experts with ai for proactive security

Zuerst: Nutzen Sie KI für prädiktive Risikomodellierung und Frühwarnungen. Modelle können Assets nach wahrscheinlicher Exposition bewerten, verwundbare Systeme hervorheben und vorhersagen, wo Angreifer als Nächstes handeln könnten. Dies hilft Sicherheitsexperten, Patch- und Schutzmaßnahmen zu priorisieren. Infolgedessen bewegen sich Teams von reaktiver zu proaktiver Sicherheit. Der Ansatz unterstützt das Posture-Management über Assets und Cloud-Anbieter hinweg.

Auch: Verteidigen Sie KI-Systeme gegen adversariale Angriffe und Manipulation. Angreifer können Eingaben vergiften oder adversariale Beispiele erstellen, die Modellausgaben verändern. Experten betonen, dass die Sicherung von KI wesentlich ist, um zu verhindern, dass Angreifer Entscheidungsprozesse ausnutzen (Risiken durch Angriffe auf KI). Daher müssen Teams Integritätsprüfungen, Eingabesanitisierung und Monitoring für verdächtiges Modellverhalten hinzufügen.

Als Nächstes: Balancieren Sie automatisierte Empfehlungen mit menschlichem Urteil. Ein KI-Assistent hilft, Beweise aufzuzeigen und einen Handlungsvorschlag zu unterbreiten. Sicherheitsexperten behalten jedoch die Entscheidungsbefugnis für kritische Entscheidungen. Dieses Human-in-the-Loop-Muster reduziert das Risiko durch falsche Modellempfehlungen und bewahrt die Prüfbarkeit. Zum Beispiel könnte ein KI-gestützter Sicherheitsworkflow Vorfallberichte automatisch ausfüllen, während ein Mensch die Freigabe für externe Benachrichtigungen erteilt.

Auch: Domain-Wissen integrieren. Threat Intelligence und Playbooks speisen Modelle mit kontextuellen Regeln. Ein Threat-Intelligence-Team kann gelabelte Beispiele bereitstellen, um die Erkennung zu verbessern. Zudem erzeugen Tools, die generative KI nutzen, geführte Analysen und Zusammenfassungen, die Analysten helfen, gezielte Fragen in natürlicher Sprache zu stellen. Diese natürlichsprachliche Interaktion macht Untersuchungen zugänglicher und schneller.

Schließlich: Governance ist wichtig. Legen Sie Richtlinien für Modellupdates, Zugriff und Incident-Logging fest. Schulen Sie Sicherheitsanalysten darin, KI-Ausgaben zu validieren und Modellvertrauenswerte zu bewerten. Diese Praktiken helfen Teams, fundierte Entscheidungen zu treffen und die Sicherheit in der gesamten Organisation zu stärken.

Harnessing ai to accelerate security operations

Zuerst: Zukünftige Trends deuten auf fortgeschrittenere generative KI- und Large-Language-Model-Integrationen in Untersuchungen hin. Teams werden große Sprachmodelle nutzen, um komplexe Zeitachsen zusammenzufassen, vorgeschriebene Playbooks vorzuschlagen und Incident-Narrative zu generieren. Darüber hinaus werden agentische Systeme mehrere KI-Agenten koordinieren, um mehrstufige Reaktionen zu steuern. Diese Fähigkeiten beschleunigen Untersuchungen und Reaktionen weiter.

Als Nächstes: Wenden Sie Best Practices für Governance, Validierung und kontinuierliche Verbesserung an. Pilotieren Sie neue Fähigkeiten in einer kontrollierten Umgebung. Messen Sie dann die Auswirkungen auf die mittlere Zeit bis zur Erkennung und die mittlere Zeit bis zur Reaktion. Verfolgen Sie außerdem False Positives und passen Sie Schwellenwerte an. Diese Governance reduziert Risiken und skaliert effektive Automatisierung.

Auch: Erstellen Sie einen klaren Fahrplan für schrittweise Einführung: Pilot, Skalierung und Messung der Auswirkungen. Beginnen Sie mit kleinen Anwendungsfällen wie E-Mail-Security-Triage oder Log-Parsing. Erweitern Sie dann die Integration von Videoanalyse und SIEM-Workflows. visionplatform.ai zeigt, wie On-Prem-VP-Agent-Funktionen eine Leitstelle von Roh-Erkennung zu kontextuellen Aktionen führen können. Dieser schrittweise Ansatz erlaubt Teams, KI-gestützte Workflows einzuführen und gleichzeitig Daten und Betrieb zu schützen.

Darüber hinaus: Kombinieren Sie menschliche Fähigkeiten mit KI-Werkzeugen. Schulen Sie Sicherheitsanalysten im Formulieren von Fragen in natürlicher Sprache und in geführter Analyse. Nutzen Sie Tools, die kritische Informationen hervorheben und umsetzbare Empfehlungen geben. Dieses hybride Modell erzeugt stärkere Sicherheitsfähigkeiten und hilft dem Sicherheitsprogramm, zu reifen.

Schließlich: Überwachen Sie das Ökosystem von Bedrohungen und Schwachstellen. Angreifer entwickeln sich schnell weiter. Investieren Sie daher in kontinuierliche Tests und Red-Teaming von KI-Helfern. Pflegen Sie zudem Transparenz und Audit-Trails für alle automatisierten Aktionen. Diese Schritte helfen Teams, Untersuchungen zu beschleunigen, die Sicherheit zu stärken und die Kontrolle zu behalten, während KI-Technologien reifen.

FAQ

What is an AI assistant in a security investigation?

Ein KI-Assistent ist ein Werkzeug, das Ermittler unterstützt, indem es Daten analysiert, Ereignisse korreliert und nächste Schritte vorschlägt. Er beschleunigt Aufgaben wie Log-Parsen, Beweissuche und Priorisierung von Alerts, wobei ein Mensch für kritische Entscheidungen eingebunden bleibt.

How reliable are AI outputs for security decisions?

KI-Ausgaben können sehr nützlich sein, sind aber nicht fehlerfrei. Eine große Studie zeigte, dass bis zu 45 % der KI-Antworten auf Sicherheitsanfragen Probleme hatten, daher bleiben menschliche Überprüfung und Validierung wesentlich (Studie).

Can AI reduce investigation time?

Ja. KI verkürzt Untersuchungszeiten durch Automatisierung der Triage, Korrelation von Logs und Hervorheben relevanter Beweise. Organisationen berichten von Verbesserungen der Erkennungsraten und Verkürzungen der mittleren Zeit bis zur Reaktion, wenn sie KI-gestützte Workflows einführen (Erkennungsverbesserungen).

How does AI handle cloud security and SaaS telemetry?

KI normalisiert und korreliert Telemetrie aus Multi-Cloud- und SaaS-Quellen, um einheitliche Zeitachsen zu erstellen. Teams sollten Datenresidenz und Datenschutzanforderungen sicherstellen und On-Prem- oder hybride Bereitstellungen bevorzugen, wenn sensibles Video oder Logs betroffen sind, um Vorschriften wie die DSGVO einzuhalten.

What are common use cases for AI in security?

Gängige Anwendungsfälle sind Incident-Triage, Threat Hunting, Anomalieerkennung, digitale Forensik und Beweiskorrelation. KI hilft auch, repetitive Workflows zu automatisieren und Incidentberichte vorzubelegen, um Untersuchungen zu beschleunigen.

How should organisations govern AI for security?

Governance erfordert Richtlinien für Modellupdates, Datenzugriff und Audit-Logging. Pilotieren Sie Funktionen zuerst und skalieren Sie dann mit klaren Metriken für mittlere Zeit bis zur Erkennung und False Positives. Behalten Sie menschliche Freigaben für risikoreiche Aktionen bei.

Are AI systems vulnerable to attacks?

Ja. KI-Modelle können adversariale Eingaben und Poisoning-Angriffe ausgesetzt sein. Experten empfehlen, Integritätsprüfungen, Eingabevalidierung und Monitoring für ungewöhnliches Modellverhalten hinzuzufügen, um das Risiko zu verringern (Angriffe auf KI).

How do AI assistants integrate with existing tools like SIEM or Splunk?

KI-Assistenten integrieren sich über APIs, Webhooks und Konnektoren, um angereicherte Alerts in SIEMs oder Splunk-Dashboards zu senden. Sie liefern annotierte Ereignisse, kontextuelle Beweise und empfohlene Aktionen für schnellere Reaktionen.

Can AI help with video-based investigations?

Ja. KI, die On-Prem-Vision-Language-Modelle nutzt, kann Video in durchsuchbare Beschreibungen umwandeln und Alarme mit kontextuellen Daten verifizieren. Beispielsweise erlauben forensische Suchfunktionen Operatoren, Vorfälle mit einfachen Abfragen und Zeitachsen zu finden (forensische Suche).

How do I start adopting AI in my security program?

Beginnen Sie klein mit einem Pilot, der sich auf einen einzelnen Anwendungsfall wie Triage oder Log-Parsing konzentriert. Messen Sie die Auswirkungen, verfeinern Sie Modelle und erweitern Sie. Verwenden Sie On-Prem-Lösungen, wenn Datenschutz oder Compliance ein Thema sind, und schulen Sie Sicherheitsanalysten darin, KI-Ausgaben zu validieren.