asistente de IA en investigaciones de seguridad: navegando el panorama de amenazas

Primero, defina qué es un asistente de IA. Un asistente de IA es un sistema que ayuda a las personas procesando datos, ofreciendo sugerencias y realizando tareas repetitivas. A continuación, en contextos de seguridad un asistente de IA proporciona análisis contextual, búsqueda y recomendaciones durante una investigación de seguridad. Puede analizar registros, etiquetar eventos y sacar a la superficie evidencia relevante para un analista. Por ejemplo, un asistente de seguridad que admite video y telemetría ayuda a los operadores a tomar decisiones más rápidas y basadas en evidencia.

Además, el panorama de amenazas sigue cambiando. Nuevas amenazas de seguridad aparecen rápidamente. Los actores maliciosos usan automatización y herramientas sofisticadas. Por lo tanto, los equipos humanos necesitan herramientas escalables para mantenerse al día. Las herramientas de IA apoyan a los investigadores al detectar patrones en grandes conjuntos de datos que un solo analista no puede examinar con rapidez.

Los datos muestran una creciente dependencia de estos sistemas. En encuestas, más del 60% de los profesionales ahora usan IA para asesoría de seguridad durante el desarrollo y la respuesta a incidentes, lo que refleja una amplia adopción entre los equipos (60% usan IA para asesoría de seguridad). Al mismo tiempo, se requiere cautela. Un estudio importante encontró que el 45% de las respuestas de IA a consultas de seguridad contienen problemas, por lo que la revisión sigue siendo esencial (45% de las respuestas de IA pueden contener problemas).

Además, un experto observó que “los asistentes de IA están transformando la forma en que los equipos de seguridad abordan la detección de amenazas al proporcionar información en tiempo real que antes era imposible obtener a escala” (Akond Rahman). Esta cita destaca tanto la promesa como la responsabilidad. En la práctica, los analistas de seguridad deben combinar los resultados de la IA con la verificación humana para evitar errores.

Además, este capítulo introduce palabras clave y capacidades que verá nuevamente. Por ejemplo, un asistente de IA ayuda con la triaje y el manejo rápido de consultas. Admite lenguaje natural y búsqueda contextual. Fortalece la postura de seguridad al reducir el tiempo necesario para reunir información crítica. Finalmente, visionplatform.ai demuestra cómo los sistemas de IA on‑prem permiten a las salas de control buscar video en lenguaje natural y verificar alarmas mientras mantienen los datos dentro del sitio, lo que favorece el cumplimiento y acelera las investigaciones (preocupaciones de privacidad y cumplimiento).

automatizar operaciones de seguridad y alertar con IA

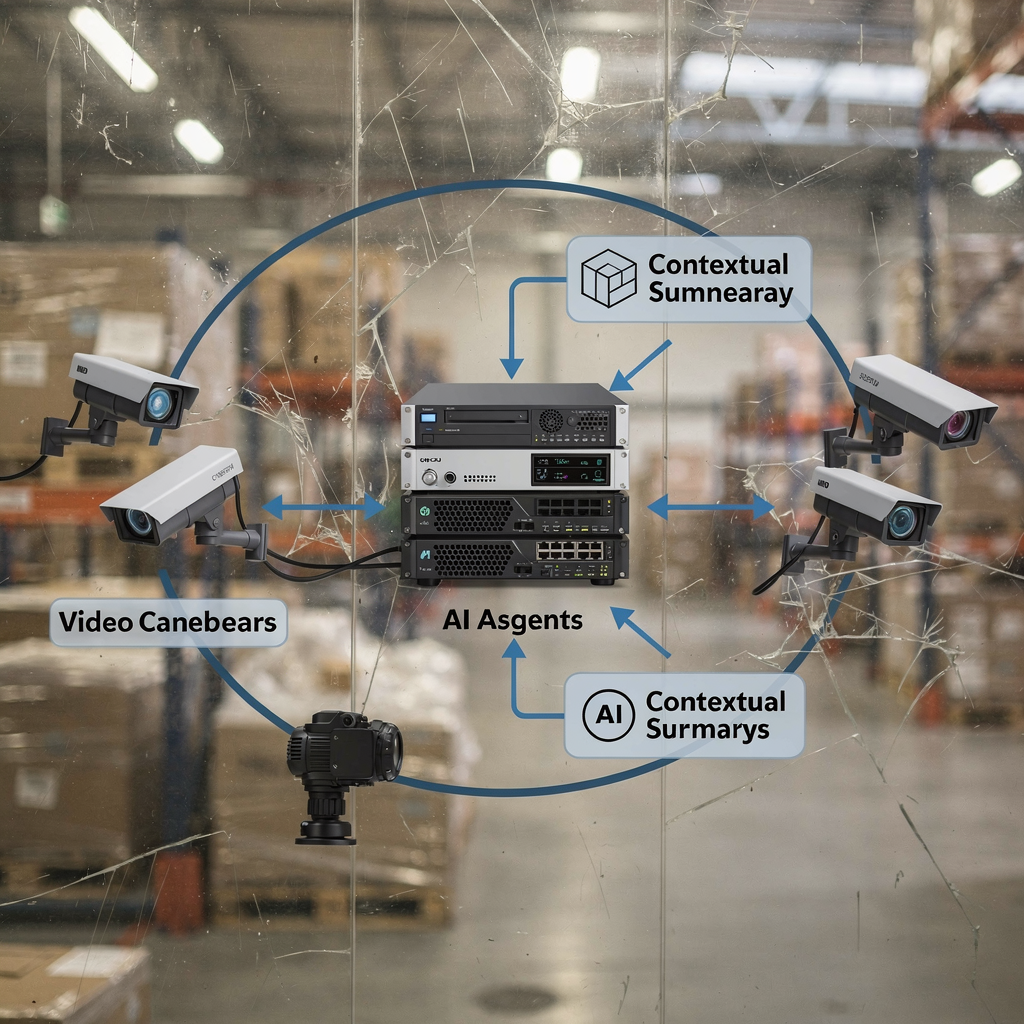

Primero, las herramientas impulsadas por IA automatizan las operaciones de seguridad rutinarias. Analizan telemetría y registros, correlacionan eventos y generan una alerta cuando detectan patrones anómalos. A continuación, estas herramientas se integran con plataformas SIEM para alimentar eventos verificados en las operaciones de seguridad existentes. Por ejemplo, muchos equipos envían hallazgos verificados por IA a Splunk para una mayor correlación y creación de paneles. Esto mejora el tiempo medio hasta la triaje y reduce las tareas repetitivas para los analistas de seguridad.

Además, la IA puede optimizar los flujos de trabajo de alertas en tiempo real. Una plataforma de IA ingiere flujos, puntúa eventos y luego abre un ticket con la evidencia contextual. A continuación, un analista de seguridad puede ver la línea de tiempo anotada, ver un clip forense corto y actuar. Este flujo de trabajo libera a los humanos para centrarse en análisis de mayor valor. También reduce los falsos positivos al comprobar múltiples señales antes de marcar un incidente.

Los datos respaldan este enfoque. En entornos empresariales, las herramientas de monitorización impulsadas por IA han mejorado las tasas de detección de amenazas hasta en un 30%, lo que reduce el tiempo de investigación y respuesta (mejora de hasta el 30% en la detección). Además, hoy en día proveedores y equipos combinan agentes de IA y LLMs para producir resúmenes contextuales, lo que acelera aún más las decisiones.

Además, la fatiga por alertas es un problema real. La verificación y priorización automatizadas ayudan. Por ejemplo, un asistente de seguridad generativo puede resumir eventos y sugerir la causa más probable. Esto reduce la carga del equipo de seguridad y mejora la precisión. Un enfoque potenciado por IA aún debe respetar la gobernanza y los controles de acceso. Por ello, muchas organizaciones mantienen modelos in situ o usan implementaciones híbridas para proteger datos sensibles. visionplatform.ai, por ejemplo, ofrece un Vision Language Model on‑prem que explica eventos de video y admite automatización agentic sin enviar video a nubes externas.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Casos de uso clave del asistente de IA para acelerar al equipo de seguridad

Primero, triaje y priorización de incidentes. Un asistente de IA ayuda a filtrar alertas ruidosas y a clasificar los incidentes de seguridad más urgentes. Comprueba señales contextuales, las compara con incidentes previos y recomienda qué elementos necesitan atención inmediata. Este paso de triaje acorta el tiempo de investigación y reduce las interrupciones en el flujo de trabajo de los analistas de seguridad. Como resultado, los humanos pasan más tiempo en análisis de amenazas complejas en lugar de en el procesamiento manual.

Segundo, caza de amenazas y detección de anomalías. Los modelos de IA encuentran patrones sutiles y actividad de amenazas emergentes que las herramientas basadas en reglas no detectan. Escanean telemetría, flujos de red y descripciones de video para detectar comportamientos anormales. Por ejemplo, combinar metadatos de video con registros de acceso ayuda al equipo de inteligencia de amenazas a detectar uso indebido de credenciales o actividad interna.

Tercero, informática forense digital y correlación de evidencias. La IA ayuda con el análisis de registros, la construcción de líneas de tiempo y la correlación entre fuentes. Las herramientas de búsqueda forense permiten a los analistas consultar video, metadatos del VMS y registros. visionplatform.ai ofrece búsqueda forense que transforma video grabado y eventos en descripciones legibles por humanos para que los equipos puedan buscar con consultas sencillas (búsqueda forense en aeropuertos).

Además, cuantificar el impacto. La automatización del triaje puede reducir el tiempo de revisión inicial entre un 40% y un 60% en despliegues piloto. El apoyo a la caza de amenazas puede reducir el tiempo medio hasta la detección en un margen similar. Las forenses que usan resúmenes de IA a menudo disminuyen el tiempo de investigación manual en horas por incidente. Estas mejoras dependen de la configuración, la calidad de los datos y la gobernanza.

Finalmente, reducir errores. Un flujo de trabajo asistido por IA reduce los falsos positivos y acelera la respuesta confirmada. Estos casos de uso requieren un ajuste cuidadoso y supervisión humana. En la práctica, los equipos adoptan asistentes potenciados por IA gradualmente. Empiezan con recomendaciones, luego habilitan acciones y más tarde pasan a automatización controlada. Este enfoque por fases protege el programa de seguridad y al mismo tiempo demuestra un ROI claro en las capacidades de seguridad.

Gestionar datos de seguridad en la nube y SaaS con IA

Primero, los desafíos de manejar registros y telemetría en entornos multi‑nube y SaaS son significativos. Los registros vienen en formatos variados. Los sistemas generan grandes volúmenes de telemetría que sobrecargan la revisión manual. Además, los equipos de seguridad en la nube deben equilibrar la velocidad con el cumplimiento. Las reglas de ubicación de datos, como el RGPD, complican el procesamiento transfronterizo.

A continuación, la IA acelera el análisis de registros, la correlación y el análisis de causa raíz. Un modelo puede normalizar registros dispares, etiquetar entidades y enlazar eventos relacionados. Luego, el modelo produce un resumen conciso y sugiere siguientes pasos. Esta simplificación reduce el tiempo dedicado a buscar en archivos sin procesar. También mejora la precisión de la investigación al vincular contexto que los humanos podrían pasar por alto.

Además, la privacidad y el cumplimiento importan. Las organizaciones deben adoptar políticas que controlen los datos de entrenamiento y las salidas del modelo. VeraSafe advierte que “el manejo de información personal por sistemas de IA debe ser transparente y cumplir con las regulaciones de privacidad” (VeraSafe sobre la privacidad de la IA). Por ello, muchos equipos eligen soluciones on‑prem o nubes privadas para video y telemetría sensibles. El enfoque on‑prem de visionplatform.ai apoya la alineación con la EU AI Act y evita mover video fuera del sitio, lo que ayuda a los equipos a gestionar el cumplimiento en un mundo multiusuario.

Asimismo, las integraciones SaaS requieren un control de accesos cuidadoso. Los agentes de IA deben seguir principios de privilegio mínimo al conectarse a sistemas. Por ejemplo, integrar datos VMS con una plataforma de IA debe respetar las políticas de retención y las pistas de auditoría. Use exportaciones estructuradas, webhooks y APIs tokenizadas para mantener el control. Además, el registro de decisiones de la IA y las acciones automatizadas apoya las auditorías y ayuda a asignar responsabilidades cuando ocurren incidentes.

Finalmente, adopte prácticas para reforzar la postura de seguridad. Valide los modelos con datos de prueba. Rastree la procedencia de los datos. Y despliegue monitorización para la deriva del modelo. Estos pasos reducen el riesgo y mejoran la confianza en las investigaciones asistidas por IA.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Empoderar a los expertos en seguridad con IA para una seguridad proactiva

Primero, use la IA para modelos de riesgo predictivos y advertencias tempranas. Los modelos pueden puntuar activos según la probabilidad de exposición, destacar sistemas vulnerables y predecir dónde podrían actuar los atacantes a continuación. Esto ayuda a los expertos en seguridad a priorizar parches y controles defensivos. Como resultado, los equipos pasan de una seguridad reactiva a una proactiva. Este enfoque apoya la gestión de la postura en todos los activos y proveedores en la nube.

Además, defienda los sistemas de IA frente a ataques adversarios y manipulaciones. Los atacantes pueden envenenar entradas o crear muestras adversarias que alteren las salidas del modelo. Los expertos señalan que asegurar la IA es esencial para evitar que los atacantes exploten procesos de decisión (Riesgos de ataques a la IA). Por lo tanto, los equipos deben añadir verificaciones de integridad, saneamiento de entradas y monitorización para comportamientos sospechosos del modelo.

A continuación, equilibre el consejo automatizado con el juicio humano. Un asistente de IA ayuda a sacar a la superficie evidencia y sugerir un curso de acción. Sin embargo, los expertos en seguridad conservan la autoridad para las decisiones críticas. Este patrón con intervención humana reduce el riesgo de recomendaciones incorrectas del modelo y preserva la auditabilidad. Por ejemplo, un flujo de trabajo de seguridad potenciado por IA podría rellenar automáticamente informes de incidentes mientras exige que un humano apruebe las notificaciones externas.

Además, integre el conocimiento del dominio. La inteligencia de amenazas y los playbooks alimentan a los modelos con reglas contextuales. Un equipo de inteligencia de amenazas puede proporcionar ejemplos etiquetados para mejorar la detección. Además, las herramientas que aprovechan la IA generativa producen análisis guiados y resúmenes que ayudan a los analistas a formular preguntas centradas en lenguaje natural. Esta interacción en lenguaje natural hace que las investigaciones sean más accesibles y rápidas.

Finalmente, la gobernanza importa. Establezca políticas para las actualizaciones de modelos, el acceso y el registro de incidentes. Capacite a los analistas de seguridad para validar las salidas de la IA y evaluar la confianza del modelo. Estas prácticas ayudan a los equipos a tomar decisiones informadas y a reforzar la seguridad en toda la organización.

Aprovechar la IA para acelerar las operaciones de seguridad

Primero, las tendencias futuras apuntan a integraciones más avanzadas de IA generativa y modelos de lenguaje en las investigaciones. Los equipos usarán grandes modelos de lenguaje para resumir líneas de tiempo complejas, proponer playbooks scriptados y generar narrativas de incidentes. Además, los sistemas agentic coordinarán múltiples agentes de IA para gestionar respuestas de varios pasos. Estas capacidades acelerarán aún más las investigaciones y la respuesta.

A continuación, aplique las mejores prácticas para gobernanza, validación y mejora continua. Pilotee nuevas capacidades en un entorno controlado. Luego, mida el impacto en el tiempo medio hasta la detección y en el tiempo medio hasta la respuesta. También haga seguimiento de los falsos positivos y ajuste los umbrales. Esta gobernanza reduce el riesgo y escala la automatización efectiva.

Además, cree una hoja de ruta clara para una adopción gradual: piloto, escalado y medición del impacto. Comience con casos de uso pequeños como el triaje de correo electrónico o el análisis de registros. Luego, amplíe para integrar análisis de video y flujos de trabajo SIEM. visionplatform.ai muestra cómo las funciones del VP Agent on‑prem pueden mover una sala de control desde la detección bruta hasta la acción contextual. Este enfoque por fases permite a los equipos adoptar flujos de trabajo impulsados por IA mientras protegen los datos y las operaciones.

Asimismo, combine las habilidades humanas con las herramientas de IA. Capacite a los analistas de seguridad en cómo formular preguntas en lenguaje natural y en análisis guiado. Use herramientas que destaquen información crítica y ofrezcan recomendaciones accionables. Este modelo híbrido produce capacidades de seguridad más sólidas y ayuda a madurar el programa de seguridad.

Finalmente, vigile el ecosistema de amenazas y vulnerabilidades. Los atacantes evolucionan con rapidez. Por ello, invierta en pruebas continuas y red teaming de los ayudantes de IA. Además, mantenga transparencia y registros de auditoría para todas las acciones automatizadas. Estos pasos ayudan a los equipos a acelerar las investigaciones, fortalecer la seguridad y mantener el control a medida que las tecnologías de IA maduran.

Preguntas frecuentes

¿Qué es un asistente de IA en una investigación de seguridad?

Un asistente de IA es una herramienta que ayuda a los investigadores analizando datos, correlacionando eventos y sugiriendo siguientes pasos. Acelera tareas como el análisis de registros, la búsqueda de evidencia y la priorización de alertas, al tiempo que mantiene a un humano en el circuito para las decisiones críticas.

¿Qué tan fiables son las salidas de la IA para decisiones de seguridad?

Las salidas de la IA pueden ser muy útiles pero no son infalibles. Un estudio importante mostró que hasta el 45% de las respuestas de IA a consultas de seguridad presentaban problemas, por lo que la revisión y validación humana siguen siendo esenciales (estudio).

¿Puede la IA reducir el tiempo de investigación?

Sí. La IA acorta el tiempo de investigación al automatizar el triaje, correlacionar registros y sacar a la superficie la evidencia relevante. Las organizaciones informan mejoras en las tasas de detección y reducciones en el tiempo medio de respuesta cuando adoptan flujos de trabajo asistidos por IA (mejoras en la detección).

¿Cómo maneja la IA la seguridad en la nube y la telemetría SaaS?

La IA normaliza y correlaciona la telemetría de múltiples nubes y fuentes SaaS para crear líneas de tiempo unificadas. Los equipos deben garantizar la residencia de datos y el cumplimiento de la privacidad, y preferir implementaciones on‑prem o híbridas para video o registros sensibles para cumplir con normativas como el RGPD.

¿Cuáles son los casos de uso comunes de la IA en seguridad?

Los casos de uso comunes incluyen triaje de incidentes, caza de amenazas, detección de anomalías, informática forense digital y correlación de evidencias. La IA también ayuda a automatizar flujos de trabajo repetitivos y a rellenar previamente informes de incidentes para acelerar las investigaciones.

¿Cómo deben gobernar las organizaciones la IA para seguridad?

La gobernanza requiere políticas para las actualizaciones de modelos, el acceso a datos y el registro de auditorías. Pilotee las funciones primero y luego escale con métricas claras para el tiempo medio hasta la detección y los falsos positivos. Mantenga la aprobación humana para acciones de alto riesgo.

¿Son vulnerables los sistemas de IA a ataques?

Sí. Los modelos de IA pueden enfrentar entradas adversarias y ataques de envenenamiento. Los expertos recomiendan añadir verificaciones de integridad, validación de entradas y monitorización de comportamientos inusuales del modelo para reducir el riesgo (Riesgos de ataques a la IA).

¿Cómo se integran los asistentes de IA con herramientas existentes como SIEM o Splunk?

Los asistentes de IA se integran mediante APIs, webhooks y conectores para enviar alertas enriquecidas a SIEMs o paneles de Splunk. Proporcionan eventos anotados, evidencia contextual y acciones sugeridas para una respuesta más rápida.

¿Puede la IA ayudar con investigaciones basadas en video?

Sí. La IA que aprovecha modelos de lenguaje visual on‑prem puede convertir video en descripciones buscables y verificar alarmas con datos contextuales. Por ejemplo, las funciones de búsqueda forense permiten a los operadores encontrar incidentes usando consultas en lenguaje natural y líneas de tiempo (búsqueda forense en aeropuertos).

¿Cómo empiezo a adoptar la IA en mi programa de seguridad?

Comience en pequeño con un piloto centrado en un solo caso de uso, como el triaje o el análisis de registros. Mida el impacto, refine los modelos y expanda. Use soluciones on‑prem cuando la privacidad de los datos o el cumplimiento sean una preocupación, y mantenga a los analistas de seguridad capacitados para validar las salidas de la IA.