Búsqueda de vídeo con IA: Fundamentos de la analítica de vídeo basada en eventos en la videovigilancia

La búsqueda CCTV basada en eventos cambia la forma en que los equipos gestionan grandes volúmenes de metraje. La búsqueda de vídeo con IA indexa clips por eventos, no por tiempo. Este enfoque sustituye la revisión manual lenta por una recuperación rápida y dirigida. La revisión tradicional de vídeo obligaba a los operadores a ver horas de grabaciones. En contraste, los sistemas basados en eventos extraen significado, etiquetan incidentes y hacen que el vídeo grabado sea searchable en segundos. El resultado transforma la respuesta y la gestión de casos para las operaciones de seguridad y protección. Además, los sistemas de IA usan aprendizaje profundo y modelos de aprendizaje para crear descripciones estructuradas de personas u objetos. Por ejemplo, la detección de objetos moderna y la visión por IA pueden etiquetar clases de objetos, identificar personas u objetos y marcar eventos específicos sin revisión humana. Como resultado, los investigadores encuentran instantáneamente metraje relevante y clips pertinentes, lo que ayuda a los investigadores y reduce el error humano.

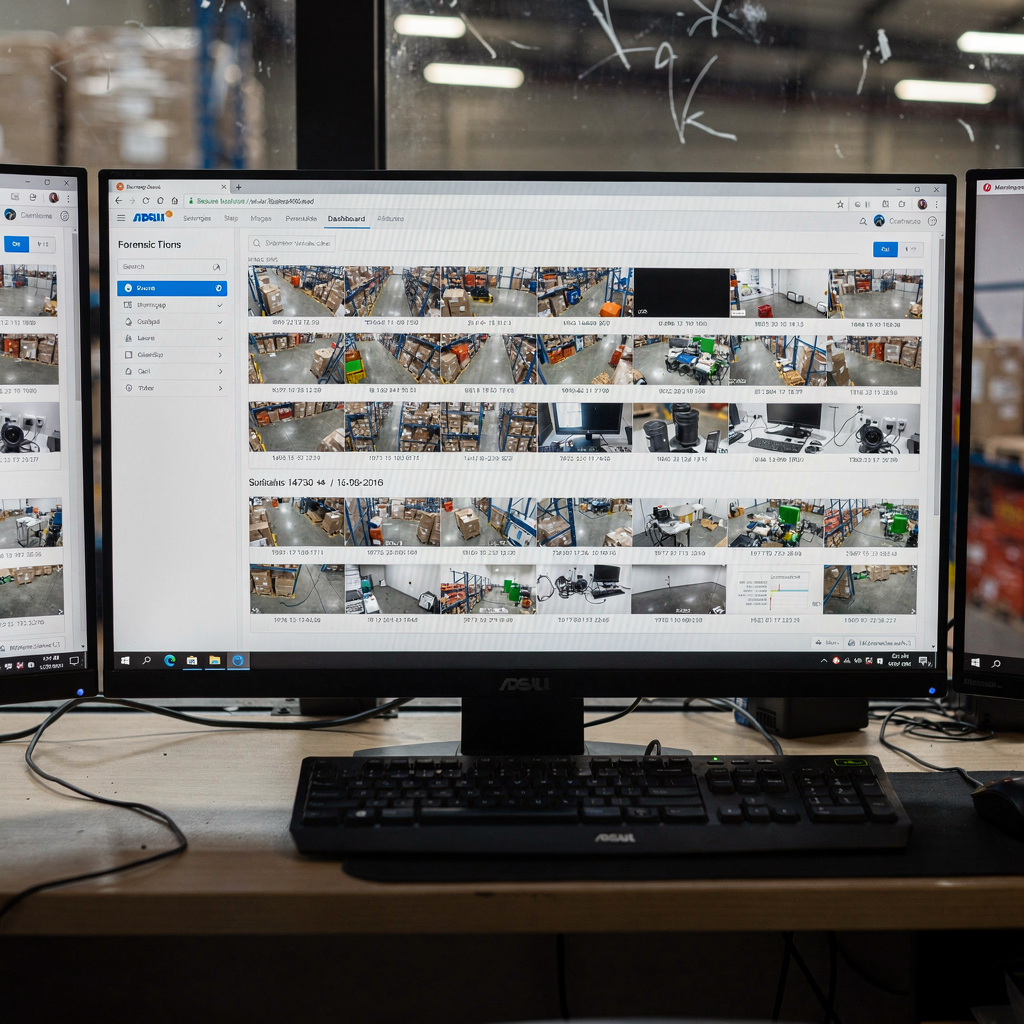

Los componentes centrales incluyen motores de detección, extractores de metadatos, servicios de indexación y una interfaz de búsqueda. La IA se encarga de la detección y la descripción. Luego los metadatos almacenan atributos como time, location, object_class y behavior. Los metadatos hacen que los datos de vídeo sean searchable y permiten a los usuarios consultar el archivo mediante lenguaje natural. Usando búsqueda inteligente con IA, los operadores pueden escribir una consulta en lenguaje corriente y obtener coincidencias precisas en todas las transmisiones de cámaras. Esta capacidad de búsqueda potenciada por IA reduce el tiempo por alarma y acelera las inspecciones. Para aeropuertos y despliegues empresariales de vídeo, es común emparejar la IA con sistemas de gestión de vídeo (VMS) para una operación fiable. visionplatform.ai se basa en este principio añadiendo una capa de razonamiento para convertir las detecciones en información operativa y soporte a la toma de decisiones.

La indexación basada en eventos acelera las operaciones de seguridad en múltiples casos de uso. Para los equipos de seguridad, permite la verificación rápida de amenazas y la exportación de pruebas para las fuerzas de seguridad. Para las operaciones, respalda auditorías de control de acceso y la detección de anomalías en procesos. Para la supervisión del tráfico, el reconocimiento de matrículas y el seguimiento de vehículos reducen el tiempo de investigación. Los estudios muestran que los sistemas inteligentes pueden mejorar las tasas de detección pero aún enfrentan problemas en escenas nocturnas; por ejemplo, un sistema de vigilancia de tráfico informó un 56,7% de precisión en condiciones nocturnas difíciles, lo que sugiere la necesidad de datos sintéticos y modelos mejorados (56,7% de precisión en escenas nocturnas). En general, la búsqueda basada en eventos convierte el vídeo en inteligencia searchable y procesable, a la vez que reduce la fatiga por alarmas y vuelve a hacer útiles grandes cantidades de metraje grabado.

Integración de metadatos y detección de objetos entre cámaras en el VMS

El etiquetado de metadatos y la detección de objetos funcionan juntos para indexar clips y que los operadores puedan encontrar eventos específicos rápidamente. Primero, la detección de objetos identifica personas, vehículos y otros objetivos. A continuación, los metadatos registran atributos como color, dirección, comportamiento y texto de matrícula. Luego el VMS indexa esas etiquetas para que los usuarios puedan consultar el archivo. En la práctica, una configuración moderna de sistemas de gestión de vídeo retransmite eventos desde la analítica de cámaras y almacena metadatos compactos en lugar de metraje bruto. Este enfoque escala mejor y reduce costes al tiempo que conserva la capacidad de reabrir el metraje bruto cuando sea necesario. La búsqueda forense se beneficia porque solo se extraen los clips relevantes para una revisión detallada y la exportación de pruebas.

Vincular múltiples transmisiones de cámaras crea una búsqueda unificada en todo un sitio. Un flujo de trabajo entre cámaras permite a los operadores rastrear a una persona a través de sistemas de cámaras y construir una línea temporal de acciones. Por ejemplo, un miembro del personal puede buscar a alguien merodeando cerca de una puerta y luego seguir automáticamente a esa persona a través de varias vistas de cámara. Esta correlación entre cámaras ayuda a verificar alarmas y reduce los falsos positivos. visionplatform.ai admite estos flujos de trabajo con un VP Agent que expone los datos del VMS y convierte el vídeo en descripciones legibles para humanos para que los usuarios puedan buscar sin IDs de cámara. Para más información sobre detectores de merodeo y cómo se integran, consulte nuestra página de detección de merodeo en aeropuertos (detección de merodeo en aeropuertos).

Los requisitos del VMS para un intercambio de metadatos sin fricciones incluyen API abiertas, esquemas de eventos estandarizados y soporte para MQTT o webhooks. Además, los sistemas deben permitir control bidireccional para que la IA pueda marcar un incidente y el VMS pueda solicitar la recuperación del metraje grabado. La integración con control de acceso y sistemas de gestión de casos añade contexto para la toma de decisiones. Para quienes despliegan a escala, consideren la compatibilidad con plataformas de terceros como Genetec Security Center para informes centrales y paneles unificados (búsqueda forense en aeropuertos). Finalmente, aseguren que el VMS y los módulos de IA mantengan la localidad de los datos si el cumplimiento exige procesamiento on-prem. Esto preserva la privacidad y cumple con la alineación del AI Act de la UE para sitios sensibles.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Optimizando alertas impulsadas por IA y detección para acelerar las investigaciones

Las alertas impulsadas por IA cambian la forma en que los equipos reaccionan ante incidentes. En lugar de recibir alarmas crudas, los operadores obtienen notificaciones verificadas y explicadas que incluyen contexto y puntuaciones de confianza. Por ejemplo, una alerta podría informar de una brecha perimetral, incluir instantáneas de vídeo y listar registros de control de acceso que lo corroboren. Esto hace que cada notificación sea accionable y reduce el tiempo necesario para la triaje. El VP Agent Reasoning de visionplatform.ai verifica las alarmas correlacionando eventos del VMS, metadatos y comprobaciones procedimentales, lo que ayuda a los investigadores y reduce los falsos positivos.

Las reglas de detección incluyen merodeo, brecha perimetral, intrusión y objeto dejado atrás. Cuando un sistema detecta a una persona merodeando cerca de una entrada segura, genera una notificación y almacena el evento como metadato searchable. Ese evento se convierte en parte del índice de búsqueda forense para que los usuarios puedan consultar incidentes similares posteriormente. En los flujos de trabajo de matrículas, la detección de una matrícula puede compararse con listas de vigilancia y marcar vehículos de interés al instante. Los estudios muestran que los sistemas IVS multicámara mejoran la detección de eventos y respaldan infraestructuras de ciudades más inteligentes (beneficios de cámaras en red).

Cuantificando el impacto, las alertas automatizadas pueden reducir los tiempos de revisión por órdenes de magnitud. Por ejemplo, reemplazar la revisión manual de horas de vídeo por clips basados en eventos puede reducir el tiempo de investigación de horas a minutos. Además, la IA que valida una alarma comprobando sensores adicionales reduce los falsos positivos y, por lo tanto, disminuye los despachos innecesarios. En la práctica, los equipos informan decisiones más rápidas y menos escalados cuando los agentes de IA proporcionan acciones sugeridas y datos de caso prellenados. Un flujo de trabajo claro que vincule alertas con la gestión de casos y la exportación de pruebas hace que la sala de control sea más eficiente y permite a los operadores centrarse en incidentes complejos en lugar de la validación rutinaria.

Aprovechando el vídeo inteligente para búsqueda forense escalable y revisión del vídeo bruto

Las funciones de vídeo inteligente filtran el metraje bruto en clips específicos por evento y hacen que los archivos sean searchable. En lugar de escanear horas de metraje, un investigador puede extraer clips relevantes filtrados por comportamiento, clase de objeto o matrícula. La herramienta de búsqueda forense proporciona luego acceso a nivel de fotograma y pruebas exportables. Este flujo de trabajo convierte el metraje bruto en inteligencia accionable y mantiene el material original disponible para procesos legales. Para archivos masivos, las arquitecturas escalables indexan los metadatos por separado de los blobs de vídeo para reducir el almacenamiento y acelerar las consultas.

Las estrategias de almacenamiento escalable incluyen retención por niveles, aceleración GPU on-prem y almacenes indexados de objetos. Por ejemplo, los eventos calientes y sus fotogramas asociados pueden permanecer en almacenamiento de alta velocidad, mientras que el metraje bruto más antiguo se archiva. Cuando un investigador consulta el archivo, el sistema transmite solo los fotogramas relevantes, no archivos completos, lo que reduce los tiempos de recuperación y el ancho de banda. Este enfoque hace que las soluciones de vídeo empresariales sean prácticas para sitios con miles de cámaras y grandes cantidades de datos grabados. Para entornos de alta seguridad como un aeropuerto, una combinación de inferencia local de IA y políticas de retención robustas respalda el cumplimiento y la rápida recuperación de pruebas (reconocimiento de matrículas y ANPR en aeropuertos).

La búsqueda forense requiere herramientas que admitan consultas en lenguaje natural, líneas temporales y correlación multisource. Usando un modelo de lenguaje de visión, los operadores pueden pedir “todas las alarmas donde no ocurrió una intrusión real” y recibir clips exportables, marcas temporales y notas contextuales. Esta capacidad de búsqueda potenciada por IA reduce la dependencia del etiquetado manual y acelera la revisión legal. Además, la integración con la gestión de casos automatiza la creación de informes y los registros de cadena de custodia para que las pruebas sigan siendo admisibles. Como resultado, los equipos obtienen resultados precisos más rápido, lo que mejora los resultados tanto en investigaciones de seguridad como operativas.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Mejorando las capacidades de búsqueda con reconocimiento de matrículas y detección de merodeo

Los flujos de trabajo de reconocimiento de matrículas son fundamentales para el seguimiento de vehículos y las listas de vigilancia. Primero, un motor ANPR lee la matrícula de un vehículo en movimiento. Luego el sistema compara la matrícula con listas y genera una alerta para vehículos de interés. Esta alerta se vincula a marcas temporales y transmisiones de cámara para que los operadores puedan encontrar instantáneamente movimientos previos y exportar pruebas. Combinar el reconocimiento de matrículas con el seguimiento entre cámaras permite a los investigadores trazar rutas a través de un campus o una ciudad. Para despliegues en aeropuertos, el ANPR respalda la gestión del carril de recogida y la inspección de seguridad, y se integra de forma natural con otras analíticas de cámara para crear una imagen más completa.

Los algoritmos de detección de merodeo señalan comportamientos peatonales anómalos mediante la supervisión del tiempo en escena, la proximidad a áreas restringidas y los patrones de movimiento. Cuando alguien se queda cerca de infraestructura sensible, el sistema crea un evento que pasa a ser searchable. En estos casos, la búsqueda se transforma de una simple búsqueda por palabra clave en una línea temporal impulsada por comportamiento. Las herramientas que admiten tanto merodeo como ANPR pueden correlacionar a una persona sospechosa con un vehículo, proporcionando una reconstrucción rápida del incidente y pistas claras para la investigación.

Cuando se combinan, el ANPR y la detección de merodeo producen una poderosa correlación entre eventos. Por ejemplo, si se detecta merodeo cerca de un muelle de carga y se observa una matrícula que coincide con un vehículo de interés, el sistema crea un caso vinculado con clips relevantes, metadatos y pasos siguientes sugeridos. Esos resultados exportables reducen la revisión humana y ayudan a los investigadores a centrarse en incidentes de alta probabilidad. En la práctica, desplegar estas funciones en múltiples ubicaciones de cámara acorta el tiempo de resolución y mejora la consciencia situacional. Para conocer la detección específica de merodeo en puntos de entrada, consulte nuestro recurso de detección de merodeo en aeropuertos (detección de merodeo en aeropuertos).

Reduciendo el ancho de banda y ayudando a los equipos de seguridad usando analítica de IA

Los costes de ancho de banda y almacenamiento aumentan rápidamente con el metraje bruto. La analítica de IA ayuda procesando el vídeo en el edge y enviando solo metadatos o clips de eventos por la red. Por ejemplo, un nodo en el edge puede ejecutar detección de objetos con IA y solo transmitir alertas y miniaturas de baja tasa de bits a la sala de control. Esto preserva el ancho de banda mientras mantiene a los operadores informados al instante. Usar IA en el edge reduce la cantidad de datos de vídeo que salen de un sitio, lo que apoya la privacidad y los requisitos de cumplimiento local. Visionplatform.ai enfatiza el procesamiento on-prem para mantener los modelos y el vídeo dentro del entorno y evitar egresos innecesarios a la nube.

Técnicas para una transmisión eficiente en ancho de banda incluyen tasas de frames adaptativas, extracción selectiva de fotogramas para eventos y hojas de metadatos compactas para cada incidente. Además, el VMS y la IA pueden negociar para mantener feeds de cámaras de baja prioridad a bitrates reducidos hasta que un evento active la transmisión en mayor calidad. Estos métodos reducen costes y permiten que miles de cámaras sean manejables sin degradar la capacidad investigativa. Como resultado, los equipos de seguridad reciben alertas accionables y pueden encontrar instantáneamente metraje crítico sin agotar la red.

Los paneles centralizados agregan alertas, metadatos y estados de casos para que los operadores obtengan información operativa en una sola vista. Estos paneles soportan flujos de trabajo guiados y reducen la carga cognitiva al recomendar acciones o prellenar informes. Al combinar alertas potenciadas por IA con la gestión de casos y la automatización procedimental, los equipos gestionan más eventos con el mismo personal. En última instancia, el uso inteligente de la analítica de IA y el procesamiento en el edge hace que los sistemas de vigilancia sean escalables, rentables y más útiles tanto para la seguridad como para la protección.

FAQ

¿Qué es la búsqueda CCTV basada en eventos?

La búsqueda CCTV basada en eventos indexa el vídeo por eventos detectados en lugar de por tiempo. Esto permite a los operadores recuperar rápidamente clips relacionados con comportamientos, objetos o incidentes específicos sin ver horas de grabaciones.

¿Cómo mejoran los metadatos la búsqueda?

Los metadatos registran atributos como time, location, object type y behavior. Como resultado, las búsquedas devuelven resultados dirigidos y los investigadores pueden consultar el archivo por términos descriptivos o criterios de búsqueda en lugar de por IDs de cámara.

¿Puede la IA reducir los falsos positivos?

Sí. Los sistemas de IA que correlacionan múltiples fuentes y aplican comprobaciones contextuales reducen los falsos positivos. Los sistemas que verifican alertas contra el control de acceso o múltiples perspectivas de cámara proporcionan resultados más precisos y reducen respuestas innecesarias.

¿Qué papel juega el reconocimiento de matrículas?

El reconocimiento de matrículas ayuda a rastrear vehículos y emparejarlos con listas de vigilancia. Soporta la investigación vehicular, la gestión de aceras y la identificación rápida de vehículos de interés a través de las transmisiones de cámara.

¿Necesito cámaras nuevas para usar la búsqueda con IA?

No siempre. Muchos despliegues aprovechan cámaras existentes y añaden IA en el edge o en el VMS. Sin embargo, cámaras de mayor resolución o con capacidad IR pueden mejorar la precisión para ciertas tareas de detección.

¿Cómo funciona la búsqueda forense?

La búsqueda forense indexa metadatos y proporciona acceso a nivel de fotograma a los clips relevantes. Los investigadores pueden consultar por comportamientos o descripciones y exportar clips y marcas temporales para el manejo de pruebas.

¿Pueden las analíticas de IA funcionar on-prem por cumplimiento?

Sí, la IA on-prem mantiene el vídeo y los modelos dentro de su entorno y reduce la exposición a la nube. Esto apoya el cumplimiento, la auditabilidad y se alinea con regímenes de protección de datos más estrictos.

¿Cuánto ancho de banda puede ahorrar la IA?

Cantidades significativas. Al transmitir solo eventos, miniaturas o metadatos en lugar de flujos completos, los sistemas reducen costes de ancho de banda y almacenamiento. El procesamiento en el edge reduce aún más la carga de la red mientras conserva el acceso al metraje necesario.

¿Cuál es el beneficio de la búsqueda entre cámaras?

La búsqueda entre cámaras traza personas o vehículos a través de múltiples vistas, permitiendo una reconstrucción de incidentes más rápida. Esta capacidad convierte el vídeo en una línea temporal operativa en lugar de clips aislados.

¿Con qué rapidez pueden los equipos encontrar metraje relevante?

Con la indexación basada en eventos y la búsqueda potenciada por IA, los equipos pueden encontrar metraje relevante en segundos o minutos en lugar de dedicar horas a la revisión manual. Esta velocidad mejora los resultados y facilita una toma de decisiones más rápida.