Videovigilancia contextual: definición y beneficios

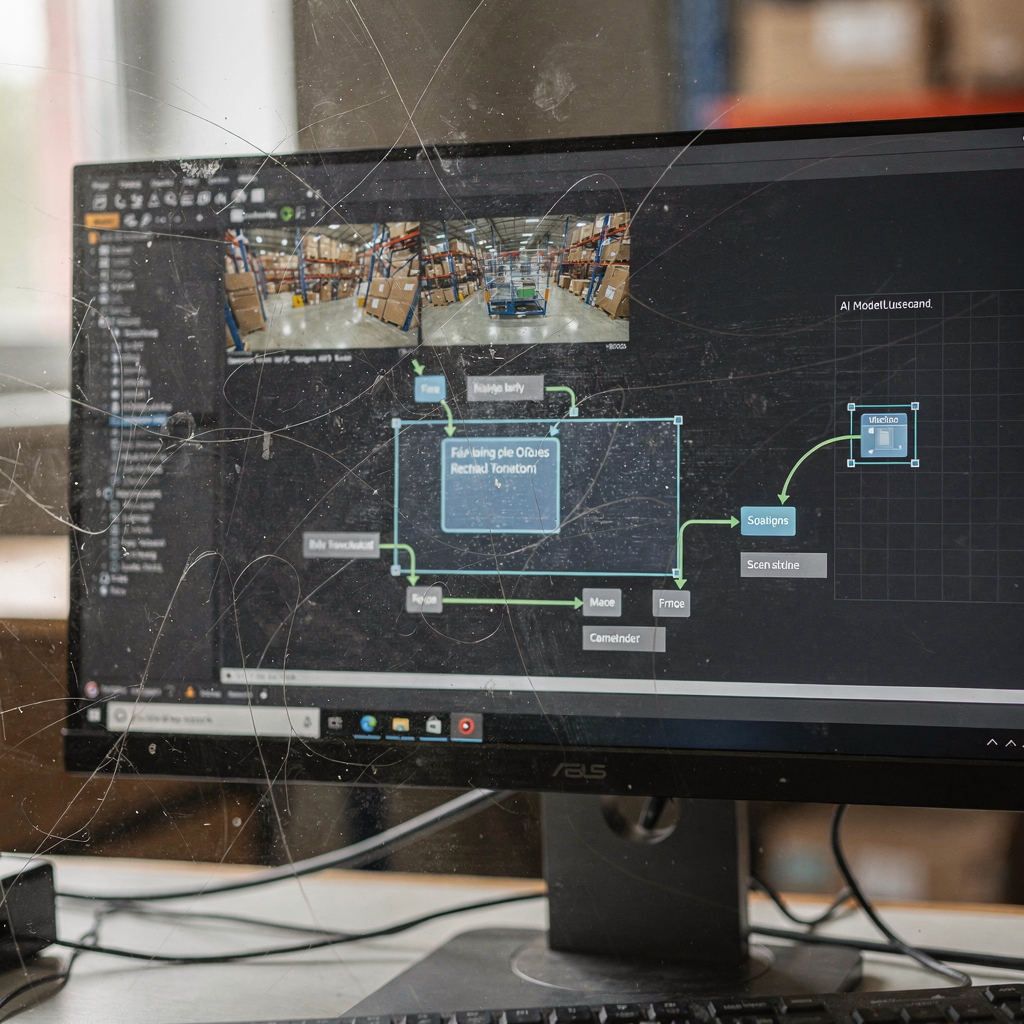

La videovigilancia contextual reúne las señales visuales y la información adicional para crear una comprensión más rica. También lo hace combinando las entradas de CÁMARA con otros SENSORES y metadatos. Además, este enfoque permite que la IA razone sobre quién, cuándo y dónde de una forma que los sistemas tradicionales no pueden. Por lo tanto, los operadores obtienen INFORMACIÓN significativa que orienta una RESPUESTA oportuna. El término «context-aware» se refiere a sistemas que UNIFICAN el VÍDEO con marcadores situacionales como la HORA DEL DÍA, los registros de control de acceso y las señales ambientales. En la práctica, el VIDEO contextual vincula un flujo de IMÁGENES visuales a disparadores de un sensor o un conjunto de datos para que el sistema pueda decidir si una ALERTA es accionable o rutinaria. Por ejemplo, vincular los registros de entrada con la alimentación de una CÁMARA ayuda a determinar si un empleado está autorizado o si se trata de un ACCESO NO AUTORIZADO. Asimismo, la IA contextual puede ajustar los umbrales de movimiento y comportamiento a un sitio específico y así REDUCIR los falsos positivos y mejorar la concentración del operador.

Además, los beneficios incluyen la reducción de falsas alarmas, la detección proactiva de AMENAZAS y una mejor ASIGNACIÓN de recursos. Por ejemplo, investigaciones muestran que las redes multimodales pueden mejorar el reconocimiento en aproximadamente un 10–20% respecto a las bases de referencia de una sola modalidad (estudio NIH). Además, añadir REGULARIZACIÓN contextual reduce los disparos espurios por MOVIMIENTO en escenas con desorden. Por lo tanto, los equipos de seguridad pueden priorizar eventos más rápido y asignar PERSONAL donde realmente se les necesita. visionplatform.ai aplica estas ideas convirtiendo las CÁMARAS y VMS existentes en una capa operativa que explica lo que ocurrió y por qué. Asimismo, el modelo de lenguaje visual local y los agentes de la plataforma permiten a los operadores buscar, verificar y ACTUAR sobre incidentes sin enviar el VÍDEO a la NUBE. Finalmente, este enfoque de IA contextual ayuda a GARANTIZAR el cumplimiento de las normas regionales mientras permite la gestión proactiva de incidentes rutinarios y escaladas.

Limitaciones de la videovigilancia tradicional y falsas alarmas

Los sistemas de vigilancia tradicionales dependen principalmente de las señales visuales. Como resultado, tienen dificultades para interpretar escenas ambiguas. Además, a menudo marcan cualquier MOVIMIENTO inesperado como una alerta. Por lo tanto, los operadores se enfrentan a muchos falsos positivos. Las investigaciones indican que las configuraciones convencionales pueden tener tasas de falsas alarmas de hasta el 70% (encuesta MDPI). En consecuencia, los equipos pierden tiempo persiguiendo no-eventos. Esta sobrecarga reduce la VISIBILIDAD situacional y aumenta la carga cognitiva del personal. Además, sin CONTEXTO, comportamientos simples como una MULTITUD que se reúne para un evento programado pueden parecer sospechosos. Así, la ausencia de información circundante dificulta la interpretación precisa del COMPORTAMIENTO.

Además, la analítica tradicional suele ser rígida. Se basa en reglas predefinidas y modelos de caja negra que no se ajustan a la realidad específica del sitio. Asimismo, estos sistemas suelen enviar las grabaciones a la NUBE para su procesamiento, complicando el cumplimiento normativo y aumentando los costes. En contraste, una estrategia contextual integra registros de acceso, la hora del día y entradas ambientales para filtrar alertas irrelevantes. Por ejemplo, vincular los horarios de turnos a las zonas de cámaras reduce las alarmas causadas por PERSONAL autorizado. Otro ejemplo es almacenar patrones de movimiento como un conjunto de datos y luego usar esa tendencia histórica para contextualizar una alerta actual. Por lo tanto, los despliegues contextuales pueden reducir significativamente las falsas alarmas y permitir que los operadores se centren en AMENAZAS reales. visionplatform.ai ayuda proporcionando VP Agent Reasoning para verificar y explicar las alarmas, lo que reduce el tiempo por alarma y facilita una RESPUESTA más rápida.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Integración multimodal de sensores en la videovigilancia

La integración multimodal de SENSORES combina vídeo de CÁMARA con RFID, cámaras de profundidad, micrófonos y sensores ambientales para crear una imagen más rica. Además, fusionar estas señales permite al sistema confirmar que un movimiento observado es significativo. Por ejemplo, RFID y los registros de control de acceso pueden confirmar si una persona en un ÁREA RESTRINGIDA está autorizada, lo que ayuda a REDUCIR falsas alarmas. Asimismo, las CÁMARAS DE PROFUNDIDAD ayudan a separar la silueta humana del desorden de fondo, lo que mejora la precisión de la DETECCIÓN. Las investigaciones muestran que combinar modalidades mejora consistentemente el reconocimiento de actividad en un 10–20% (estudio NIH). Por lo tanto, un marco de SENSORES MIXTOS conduce a resultados más fiables y a menos minutos de operador desperdiciados.

Además, el middleware desempeña un papel clave. Las ARQUITECTURAS de middleware gestionan el flujo de datos entre dispositivos mientras aplican privacidad y cumplimiento normativo. Por ejemplo, un middleware con conciencia de privacidad puede mantener el VÍDEO y los conjuntos de datos sensibles en las instalaciones mientras expone eventos estructurados para el razonamiento. visionplatform.ai utiliza tales enfoques on-prem para evitar una GESTIÓN innecesaria en la NUBE y ofrecer control total sobre los conjuntos de datos y los modelos. Además, el middleware unifica las corrientes de eventos para que los agentes de IA puedan correlacionar una alarma de cámara con registros de acceso o una alerta de temperatura. Asimismo, este enfoque unificado soporta la BÚSQUEDA forense a través de las grabaciones; vea la capacidad VP Agent Search para consultas en lenguaje natural y análisis retrospectivo. Finalmente, la integración de sensores permite a las operaciones AUTOMATIZAR flujos de trabajo de bajo riesgo manteniendo la supervisión humana en incidentes críticos, lo que mejora la seguridad y la eficiencia operativa en múltiples sectores.

Aprendizaje profundo e IA para la detección de anomalías

El aprendizaje profundo y la IA transforman la forma en que los sistemas analizan patrones espaciotemporales. Las redes neuronales convolucionales extraen características espaciales de los fotogramas, y los modelos recurrentes o las convoluciones temporales capturan el movimiento a lo largo del tiempo. Además, estos modelos pueden entrenarse con conjuntos de datos curados para reconocer el movimiento normal y así detectar ANOMALÍAS. Por ejemplo, los sistemas modernos han alcanzado una precisión de alerta temprana por encima del 85% en tareas de reconocimiento de comportamiento (estudio PLOS). Por lo tanto, la vigilancia impulsada por IA puede detectar comportamientos irregulares antes y con mayor confianza que las reglas heurísticas.

Además, las técnicas de REGULARIZACIÓN contextual incorporan priors ambientales en el aprendizaje. Estos métodos penalizan combinaciones improbables de eventos, lo que filtra el ruido en escenas concurridas. Por ejemplo, un modelo puede aprender que merodear cerca de una puerta segura fuera de horario es más sospechoso que un comportamiento similar durante un cambio de TURNOS programado. Asimismo, la IA contextual en vigilancia permite que los sistemas se adapten a la hora del día y a los patrones específicos del sitio. VP Agent Reasoning de visionplatform.ai correlaciona VÍDEO, metadatos del VMS y control de acceso para explicar por qué una alerta importa. Además, el PROCESAMIENTO en tiempo real es esencial para una RESPUESTA oportuna. Las implementaciones en el EDGE y on-prem reducen la latencia y mantienen el VÍDEO sensible dentro de la organización. En resumen, los modelos de aprendizaje profundo, cuando se combinan con señales contextuales, permiten una detección de ANOMALÍAS más INTELIGENTE y explicaciones accionables en las que los operadores pueden confiar.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Impacto cuantitativo y métricas de rendimiento

Las métricas clave para evaluar sistemas contextuales incluyen la reducción de falsos positivos, la precisión de detección, la latencia de procesamiento y el tiempo del operador por alerta. Además, los estudios muestran que los métodos contextuales pueden reducir las falsas alarmas hasta en un 40% (encuesta MDPI). Asimismo, los enfoques de aprendizaje profundo han llevado la precisión del reconocimiento de comportamiento por encima del 85% en muchas pruebas del mundo real (estudio PLOS). Por lo tanto, las ganancias cuantitativas son medibles y relevantes operativamente.

Además, combinar modalidades produce mejoras consistentes de reconocimiento en el rango del 10–20% (estudio NIH). También, la compensación entre coste computacional y ganancias de seguridad depende de las opciones de despliegue. Por ejemplo, el PROCESAMIENTO en el borde reduce el ancho de banda y la latencia pero puede requerir GPUs o dispositivos especializados. En contraste, las soluciones en la nube pueden escalar pero generan preocupaciones sobre privacidad y costes. visionplatform.ai aborda este equilibrio ofreciendo despliegues VP Agent on-prem que mantienen el VÍDEO y los modelos localmente mientras transmiten eventos estructurados para el razonamiento. Además, las organizaciones pueden evaluar métricas como el tiempo medio para verificar una ALERTA y el porcentaje de incidentes resueltos sin escalamiento. Estos KPI proporcionan evidencia concreta de que los marcos contextuales mejoran la seguridad y la eficiencia operativa en distintos sectores. Finalmente, un despliegue medido con validación clara de conjuntos de datos y auditorías de modelos asegura que las ganancias persistan durante la expansión y que el sistema permanezca alineado con la política.

Consideraciones éticas y de privacidad en la vigilancia contextual

Las cuestiones éticas son centrales para un despliegue generalizado. Además, los expertos advierten sobre la extralimitación de la vigilancia y el posible uso indebido de información personal. Por ejemplo, una revisión señaló que «la ausencia de soluciones aplicables de manera universal para abordar las preocupaciones de privacidad sigue siendo un desafío crítico» (ScienceDirect). Por lo tanto, cualquier despliegue debe incluir fuertes salvaguardas de PRIVACIDAD. En la práctica, esto significa minimización de datos, políticas claras de retención y auditorías transparentes. Además, se deben aplicar reglas de control de acceso y autorización para que solo el PERSONAL permitido pueda ver las grabaciones sensibles. La arquitectura on-prem de visionplatform.ai respalda estos requisitos manteniendo el vídeo dentro de la organización y proporcionando registros auditables para apoyar el cumplimiento de regulaciones como la AI Act de la UE.

Además, los marcos éticos deben equilibrar la seguridad y las libertades civiles. Por ejemplo, la vigilancia impulsada por IA debe evitar resultados sesgados validando los modelos con conjuntos de datos representativos. Asimismo, las organizaciones deben informar a los usuarios y partes interesadas sobre las prácticas de monitorización y proporcionar canales para reclamaciones. Además, medidas técnicas como la anonimización, el procesamiento selectivo y la limitación de propósito reducen el impacto sobre la privacidad. Finalmente, la gobernanza debe definir cuándo un agente de IA puede actuar de forma autónoma y cuándo se requiere la aprobación humana. Al diseñar con principios de privacidad ante todo, los equipos pueden garantizar que los sistemas contextuales mejoren la seguridad respetando los derechos y manteniendo la confianza pública.

FAQ

¿Qué es la videovigilancia contextual?

La videovigilancia contextual vincula las grabaciones de cámara con información adicional como registros de acceso, la hora del día y sensores ambientales. Esta fusión ayuda al sistema a decidir si un evento es realmente sospechoso o rutinario.

¿Cómo mejora la precisión la integración multimodal?

Combinar modalidades como RFID y cámaras de profundidad proporciona señales corroborantes que reducen la ambigüedad. Como resultado, mejora el reconocimiento de actividades y disminuyen los falsos positivos.

¿Pueden estos sistemas operar sin la nube?

Sí. El procesamiento local (on-prem) mantiene el vídeo y los modelos dentro de la organización, lo que ayuda a cumplir los requisitos de privacidad y cumplimiento. visionplatform.ai ofrece soluciones on-prem para evitar transferencias innecesarias a la nube.

¿Qué métricas debo controlar después del despliegue?

Controle las tasas de falsos positivos, la precisión de detección, la latencia de procesamiento y el tiempo medio para verificar una alerta. Estos KPI muestran cómo el sistema afecta la eficiencia operativa.

¿Los métodos contextuales reducen realmente las falsas alarmas?

La evidencia muestra reducciones notables; algunos estudios informan hasta un 40% de disminución en las falsas alarmas (encuesta MDPI). Eso conduce a menos respuestas innecesarias y a prioridades más claras para los equipos.

¿Existen riesgos de detecciones sesgadas?

Sí. Los modelos entrenados con conjuntos de datos limitados pueden reflejar sesgos, por lo que es esencial probarlos con datos representativos y auditar los modelos. La validación continua ayuda a prevenir resultados injustos.

¿Cuál es un caso de uso práctico para la IA contextual?

Un caso de uso es correlacionar los registros de control de acceso con eventos de cámara para detectar accesos no autorizados. Esto reduce las alertas de PERSONAL autorizado y resalta las AMENAZAS reales.

¿Cómo ayudan los agentes de IA a los operadores?

Los agentes de IA pueden verificar alarmas, proporcionar explicaciones y recomendar acciones. Por ejemplo, VP Agent Reasoning correlaciona vídeo y metadatos para aconsejar a los operadores sobre los siguientes pasos.

¿Qué salvaguardas de privacidad deben implementarse?

Implemente minimización de datos, límites de retención, control de acceso estricto y registros de auditoría. Políticas transparentes y aviso a los usuarios apoyan una operación ética.

¿Dónde puedo aprender más sobre detecciones especializadas?

Para soluciones enfocadas, consulte los recursos sobre detección de personas, detección de merodeo y búsqueda forense en visionplatform.ai. Por ejemplo, explore la detección de personas en aeropuertos para entender aplicaciones a medida: detección de personas en aeropuertos.