AI video search: Fundamentals of Event-based Video analytics in Video surveillance

A pesquisa de CFTV baseada em eventos muda a forma como as equipes lidam com grandes volumes de filmagens. A pesquisa de vídeo com IA indexa clipes por eventos, não por tempo. Essa abordagem substitui a revisão manual lenta por uma recuperação rápida e direcionada. A revisão tradicional forçava os operadores a assistir horas de filmagem. Em contraste, sistemas baseados em eventos extraem significado, etiquetam incidentes e tornam o vídeo gravado pesquisável em segundos. O resultado transforma a resposta e a gestão de casos para operações de segurança e proteção. Além disso, sistemas de IA usam deep learning e modelos de aprendizagem para criar descrições estruturadas de pessoas ou objetos. Por exemplo, detecção moderna de objetos e visão por computador podem rotular classes de objetos, identificar pessoas ou objetos e sinalizar eventos específicos sem revisão humana. Como resultado, investigadores encontram instantaneamente filmagens e clipes relevantes, o que ajuda nas investigações e reduz erro humano.

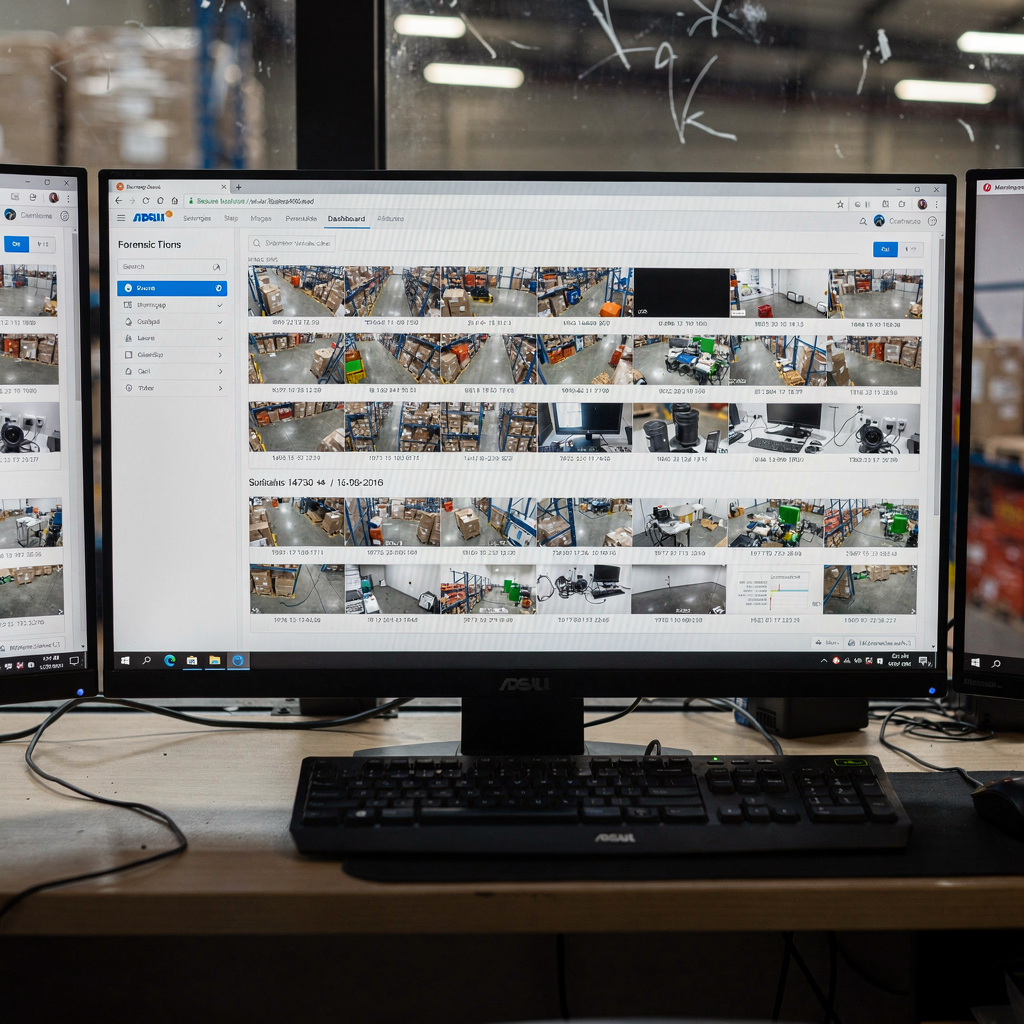

Os componentes principais incluem motores de detecção, extratores de metadados, serviços de indexação e uma interface de busca. A IA lida com detecção e descrição. Em seguida, os metadados armazenam atributos como hora, local, object_class e comportamento. Os metadados tornam os dados de vídeo pesquisáveis e permitem que usuários consultem o arquivo por linguagem natural. Usando busca inteligente com IA, os operadores podem digitar uma consulta em inglês simples e obter resultados precisos em fluxos de câmeras. Essa capacidade de busca com IA reduz o tempo por alarme e acelera as inspeções. Para aeroportos e implantações empresariais de vídeo, é comum emparelhar IA com sistemas de gestão de vídeo para operação confiável. visionplatform.ai baseia-se nesse princípio ao adicionar uma camada de raciocínio para transformar detecções em insights operacionais e suporte à decisão.

A indexação baseada em eventos acelera operações de segurança em vários casos de uso. Para equipes de segurança, ela possibilita verificação rápida de ameaças e evidências exportáveis para as autoridades. Para operações, apoia auditorias de controle de acesso e detecção de anomalias de processo. Para monitoramento de tráfego, reconhecimento de placas e rastreamento de veículos reduzem o tempo de investigação. Estudos mostram que sistemas inteligentes podem melhorar taxas de detecção, mas ainda enfrentam problemas em cenas noturnas; por exemplo, um sistema de monitoramento de tráfego reportou 56.7% de precisão em condições noturnas difíceis, sugerindo necessidade de dados sintéticos e modelos aprimorados (56,7% de precisão em cenas noturnas). No geral, a busca baseada em eventos transforma vídeo em inteligência pesquisável e acionável ao mesmo tempo que reduz fadiga de alarmes e torna grandes quantidades de filmagem gravada úteis novamente.

Integrating Metadata and Object detection Across cameras in VMS

Marcação de metadados e detecção de objetos trabalham juntas para indexar clipes de modo que operadores possam encontrar rapidamente eventos específicos. Primeiro, a detecção de objetos identifica pessoas, veículos e outros alvos. Em seguida, os metadados registram atributos como cor, direção, comportamento e texto da placa. Depois, o VMS indexa essas etiquetas para que os usuários possam consultar o arquivo. Na prática, uma configuração moderna de sistema de gestão de vídeo transmite eventos da análise de câmeras e armazena metadados compactos em vez de filmagens brutas. Essa abordagem escala melhor e reduz custos enquanto preserva a capacidade de reabrir a filmagem bruta quando necessário. A busca forense se beneficia porque apenas clipes relevantes são puxados para revisão detalhada e exportação de evidências.

Vincular múltiplos fluxos de câmeras cria uma busca unificada em todo o local. Um fluxo de trabalho cross-camera permite que operadores rastreiem uma pessoa através dos sistemas de câmera e construam uma linha do tempo de ações. Por exemplo, um membro da equipe pode buscar alguém perambulando perto de um portão e então seguir automaticamente essa pessoa por várias vistas de câmera. Essa correlação entre câmeras ajuda a verificar alarmes e reduz falsos positivos. visionplatform.ai suporta esses fluxos com um VP Agent que expõe dados do VMS e converte vídeo em descrições legíveis por humanos para que usuários possam buscar sem IDs de câmera. Para mais sobre detectores de permanência e como eles se integram, veja nossa página de detecção de permanência suspeita em aeroportos.

Os requisitos do VMS para troca de metadados sem falhas incluem APIs abertas, esquemas de eventos padronizados e suporte para MQTT ou webhooks. Além disso, os sistemas devem permitir controle bidirecional para que a IA possa sinalizar um incidente e o VMS possa solicitar a recuperação da filmagem gravada. Integração com controle de acesso e sistemas de gerenciamento de casos adiciona contexto para tomada de decisão. Para quem implanta em escala, considere compatibilidade com plataformas de terceiros como Genetec Security Center para relatórios centrais e dashboards unificados (busca forense em aeroportos). Finalmente, assegure que o VMS e os módulos de IA mantenham localidade dos dados se a conformidade exigir processamento on-premises. Isso preserva privacidade e atende ao alinhamento com o AI Act da UE para locais sensíveis.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Optimising AI-powered alerts and Detection to Speed up investigations

Alertas com IA mudam a forma como as equipes reagem a incidentes. Em vez de receber alarmes brutos, os operadores recebem notificações verificadas e explicadas que incluem contexto e pontuações de confiança. Por exemplo, um alerta pode relatar uma violação de perímetro, incluir snapshots do vídeo e listar logs de controle de acesso corroborantes. Isso torna cada notificação acionável e reduz o tempo necessário para triagem. O VP Agent Reasoning da visionplatform.ai verifica alarmes correlacionando eventos do VMS, metadados e checagens procedimentais, o que ajuda os investigadores e reduz falsos positivos.

Regras de detecção incluem permanência, violação de perímetro, intrusão e objeto deixado para trás. Quando um sistema detecta uma pessoa perambulando perto de uma entrada segura, ele dispara uma notificação e armazena o evento como metadado pesquisável. Esse evento passa a fazer parte do índice de busca forense para que usuários possam posteriormente consultar incidentes semelhantes. Para fluxos de trabalho de placas, a detecção de uma placa pode comparar com listas de observação e sinalizar veículos de interesse instantaneamente. Estudos mostram que sistemas IVS multi-câmera aumentam a detecção de eventos e apoiam infraestruturas de cidades mais inteligentes (benefícios de câmeras em rede).

Quantificando o impacto, alertas automatizados podem reduzir tempos de revisão por ordens de magnitude. Por exemplo, substituir revisão manual de horas de vídeo por clipes baseados em eventos pode reduzir o tempo de investigação de horas para minutos. Além disso, IA que valida um alarme checando sensores adicionais reduz falsos positivos e, portanto, diminui despachos desnecessários. Na prática, equipes relatam decisões mais rápidas e menos escalonamentos quando agentes de IA fornecem ações sugeridas e dados de caso pré-preenchidos. Um fluxo de trabalho claro que vincula alertas ao gerenciamento de casos e à exportação de evidências torna a sala de controle mais eficiente e permite que operadores se concentrem em incidentes complexos em vez de validações rotineiras.

Leveraging Smart video for Scalable Forensic search and Raw video review

Recursos de vídeo inteligente filtram vídeo bruto em clipes específicos de eventos e tornam arquivos pesquisáveis. Em vez de vasculhar horas de filmagem, um investigador pode puxar clipes relevantes filtrados por comportamento, classe de objeto ou placa. A ferramenta de busca forense então fornece acesso ao nível de frame e evidências exportáveis. Esse fluxo transforma vídeo bruto em inteligência acionável e mantém a filmagem bruta disponível para processos legais. Para arquivos massivos, arquiteturas escaláveis indexam metadados separadamente dos blobs de vídeo para reduzir armazenamento e acelerar consultas.

Estratégias de armazenamento escaláveis incluem retenção em camadas, aceleração por GPU on-premises e stores indexados de objetos. Por exemplo, eventos quentes e seus frames associados podem permanecer em armazenamento de alta velocidade, enquanto filmagens brutas mais antigas são arquivadas. Quando um investigador consulta o arquivo, o sistema transmite apenas frames relevantes, não arquivos inteiros, o que reduz tempos de recuperação e largura de banda. Essa abordagem torna soluções de vídeo empresariais práticas para locais com milhares de câmeras e grandes quantidades de dados gravados. Para ambientes de alta segurança como um aeroporto, uma combinação de inferência local de IA e políticas robustas de retenção suporta conformidade e recuperação rápida de evidências (license plate e ANPR em aeroportos).

A busca forense requer ferramentas que suportem consultas em linguagem natural, linhas do tempo e correlação de múltiplas fontes. Usando um Vision Language Model, operadores podem pedir “todos os alarmes onde não houve intrusão real” e receber clipes exportáveis, timestamps e notas contextuais. Essa capacidade de busca com IA reduz a dependência de marcação manual e acelera a revisão legal. Além disso, integrar gerenciamento de casos automatiza a criação de relatórios e registros de cadeia de custódia para que a evidência permaneça admissível. Como resultado, as equipes obtêm resultados precisos mais rapidamente, o que melhora os desfechos tanto em investigações de segurança quanto operacionais.

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

Enhancing Search capabilities with License plate recognition and Loiter detection

Fluxos de trabalho de reconhecimento de placas são centrais para rastreamento de veículos e listas de observação. Primeiro, um motor ANPR lê a placa de um veículo em movimento. Em seguida, o sistema compara a placa com listas e gera um alerta para veículos de interesse. Esse alerta vincula timestamps e feeds de câmera para que operadores possam instantaneamente encontrar movimentos anteriores e exportar evidências. Combinar reconhecimento de placas com rastreamento cross-camera capacita investigadores a traçar rotas em um campus ou cidade. Para implantações em aeroportos, o ANPR apoia gerenciamento de calçadas e triagem de segurança, e se integra naturalmente com outras análises de câmera para criar um quadro mais completo.

Algoritmos de detecção de permanência sinalizam comportamento pedestre anormal ao monitorar tempo no local, proximidade de áreas restritas e padrões de movimento. Quando alguém permanece perto de infraestrutura sensível, o sistema cria um evento que se torna pesquisável. Nesses casos, a busca se transforma de uma simples pesquisa por palavra-chave em uma linha do tempo orientada por comportamento. Ferramentas que suportam tanto permanência quanto ANPR podem correlacionar uma pessoa suspeita com um veículo, entregando reconstrução rápida do incidente e pistas investigativas claras.

Quando combinados, ANPR e detecção de permanência produzem correlação cross-evento poderosa. Por exemplo, se for detectada permanência perto de um doca de carregamento e uma leitura de placa corresponder a um veículo de interesse, o sistema cria um caso vinculado com clipes relevantes, metadados e próximos passos sugeridos. Esses resultados exportáveis reduzem revisão humana e ajudam investigadores a focar em incidentes de alta probabilidade. Na prática, implantar esses recursos em várias localizações de câmera encurta o tempo até a resolução e melhora a consciência situacional. Para saber mais sobre detecção específica de permanência em pontos de passagem, veja nosso recurso de detecção de permanência suspeita em aeroportos.

Reducing Bandwidth and Helping security teams Using AI analytics

Custos de largura de banda e armazenamento aumentam rapidamente com filmagem bruta. Análises de IA ajudam processando vídeo na borda e enviando apenas metadados ou clipes de evento pela rede. Por exemplo, um nó de edge pode executar detecção de objetos por IA e apenas transmitir alertas e miniaturas em baixo bitrate para a sala de controle. Isso preserva largura de banda enquanto mantém operadores instantaneamente informados. Usar IA na borda reduz a quantidade de dados de vídeo saindo de um local, o que apoia privacidade e requisitos de conformidade local. A visionplatform.ai enfatiza processamento on-premise para manter modelos e vídeo dentro do ambiente e evitar egresso desnecessário para a nuvem.

Técnicas para streaming eficiente em largura de banda incluem taxas de quadros adaptativas, extração seletiva de frames para eventos e folhas de metadados compactas para cada incidente. Além disso, VMS e IA podem negociar para manter feeds de câmeras de baixa prioridade em bitrates reduzidos até que um evento acione streaming em maior qualidade. Esses métodos reduzem custos e permitem que milhares de câmeras permaneçam gerenciáveis sem degradar a capacidade investigativa. Como resultado, equipes de segurança recebem alertas acionáveis e podem encontrar instantaneamente filmagens críticas sem sobrecarregar a rede.

Dashboards centralizados agregam alertas, metadados e status de casos para que operadores obtenham insights operacionais em uma única visão. Esses painéis suportam fluxos de trabalho guiados e reduzem carga cognitiva ao recomendar ações ou pré-preencher relatórios. Ao combinar alertas com IA, gerenciamento de casos e automação procedimental, equipes tratam mais eventos com o mesmo efetivo. Em última análise, uso inteligente de análises com IA e processamento na borda torna sistemas de vigilância escaláveis, econômicos e mais úteis tanto para segurança quanto para proteção.

FAQ

What is event-based CCTV search?

A pesquisa de CFTV baseada em eventos indexa vídeo por eventos detectados em vez de por tempo. Isso permite que operadores recuperem rapidamente clipes relacionados a comportamentos, objetos ou incidentes específicos sem assistir horas de filmagem gravada.

How does metadata improve search?

Metadados registram atributos como hora, local, tipo de objeto e comportamento. Como resultado, buscas retornam resultados direcionados e investigadores podem consultar o arquivo por termos descritivos ou critérios de pesquisa em vez de IDs de câmera.

Can AI reduce false positives?

Sim. Sistemas de IA que correlacionam múltiplas fontes e aplicam checagens contextuais reduzem falsos positivos. Sistemas que verificam alertas contra controle de acesso ou perspectivas múltiplas de câmeras fornecem resultados mais precisos e reduzem respostas desnecessárias.

What role does license plate recognition play?

O reconhecimento de placas ajuda a rastrear veículos e confrontá-los com listas de observação. Ele apoia forense veicular, gerenciamento de calçadas e identificação rápida de veículos de interesse em vários fluxos de câmera.

Do I need new cameras to use AI search?

Nem sempre. Muitas implantações aproveitam câmeras existentes e adicionam IA na borda ou no VMS. No entanto, câmeras de maior resolução ou com capacidade IR podem melhorar a precisão para certas tarefas de detecção.

How does forensic search work?

A busca forense indexa metadados e fornece acesso ao nível do frame aos clipes relevantes. Investigadores podem consultar por comportamentos ou descrições e exportar clipes e timestamps para tratamento de evidências.

Can AI analytics work on-prem for compliance?

Sim, IA on-prem mantém vídeo e modelos dentro do seu ambiente e reduz exposição à nuvem. Isso apoia conformidade, auditabilidade e alinha-se a regimes de proteção de dados mais rigorosos.

How much bandwidth can AI save?

Quantidades significativas. Ao transmitir apenas eventos, miniaturas ou metadados em vez de fluxos completos, sistemas reduzem custos de largura de banda e armazenamento. Processamento na borda reduz ainda mais a carga da rede enquanto preserva acesso às filmagens necessárias.

What is the benefit of cross-camera search?

A busca cross-camera traça pessoas ou veículos através de múltiplas vistas de câmera, possibilitando reconstrução de incidentes mais rápida. Essa capacidade transforma vídeo em uma linha do tempo operacional em vez de clipes isolados.

How quickly can teams find relevant footage?

Com indexação baseada em eventos e busca com IA, equipes podem encontrar filmagens relevantes em segundos a minutos em vez de gastar horas em revisão manual. Essa rapidez melhora resultados e apoia tomadas de decisão mais ágeis.