Modelo de linguagem visual resume horas de filmagem em texto conciso com IA generativa

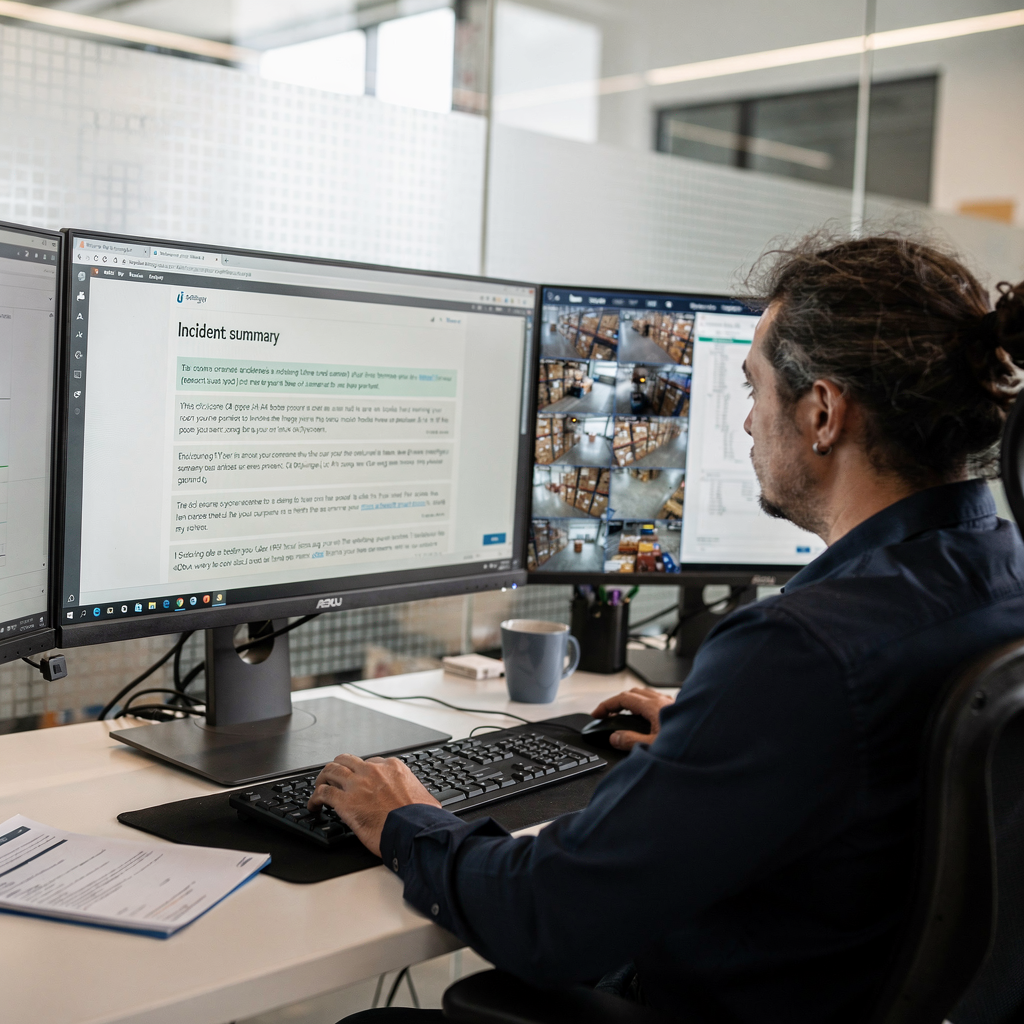

A tecnologia de modelos de linguagem visual transforma longas linhas do tempo de vídeo em narrativas de incidentes legíveis, e essa mudança é relevante para equipes reais. Além disso, esses sistemas combinam processamento de imagem e linguagem para criar descrições semelhantes às humanas do que a câmera capturou. Por exemplo, modelos avançados gerarão um texto que explica ações, objetos e contexto a partir de minutos ou horas de filmagem. Consequentemente, os operadores não precisam mais vasculhar vídeos intermináveis. Em vez disso, podem ler relatórios curtos, pesquisar em linguagem natural e concentrar-se na resposta.

Os VLMs atuais emparelham codificadores visuais com grandes modelos de linguagem, e eles ampliam o que plataformas de vigilância podem fazer. Por exemplo, pesquisas mostram que os principais modelos se destacam em tarefas de percepção enquanto continuam a melhorar em benchmarks de raciocínio (resultados de alta precisão). Além disso, uma revisão abrangente destaca as forças multimodais que possibilitam legendagem de imagens, resposta a perguntas visuais e sumarização (revisão de abordagens de VLM). Portanto, integrar um VLM ao XProtect elimina um grande gargalo: a revisão manual.

Na prática, a nova ferramenta de sumarização de vídeo converte horas de filmagem de câmera em resumos concisos de incidentes. Por exemplo, os operadores podem enviar um clipe de vídeo curto e receber um parágrafo no estilo executivo que lista o que, quem, onde e quando. Além disso, a ferramenta de sumarização analisa as filmagens e descreve o que é relevante. Essa capacidade apoia fluxos de trabalho forenses e acelera investigações ao permitir que as pessoas pesquisem vídeo como um relatório em vez de um conjunto de arquivos.

visionplatform.ai usa VLMs on-prem para que os clientes mantenham o controle dos vídeos e dos modelos. Além disso, nossa VP Agent Suite transforma detecções de vídeo em descrições pesquisáveis e combina a saída do VLM com raciocínio de agentes para sugerir ações. Isso reduz o tempo por alarme e ajuda as equipes a escalar o monitoramento sem mover o vídeo bruto para a nuvem. Relatos iniciais mostram que a sumarização de vídeo pode reduzir o tempo que o operador gasta na revisão manual em aproximadamente 30%, e isso está alinhado com evidências do setor de que a IA acelera a detecção de incidentes (métricas da Milestone).

milestone systems oferece VLM como serviço para estender capacidades de IA a fluxos de trabalho personalizados

A Milestone Systems fornece serviços modulares que permitem a integradores adicionar recursos visão-linguagem a implantações existentes. Além disso, a Milestone introduziu opções em nuvem e on-prem, e a empresa apresenta ambas como formas de entregar inteligência escalável. Por exemplo, os Serviços Profissionais AWS para Milestone XProtect mostram como o XProtect pode ser executado em infraestrutura de nuvem com capacidades de IA adicionais (listagem na AWS). Adicionalmente, a Milestone Systems é líder mundial em vídeo orientado por dados, e o roadmap da plataforma inclui novos serviços multimodais.

A Milestone oferece um modelo de linguagem como serviço e VLM como serviço, e ambos estendem o que os desenvolvedores podem fazer com o XProtect. Além disso, os pontos de integração incluem APIs e SDKs que expõem as saídas do VLM a fluxos de trabalho, painéis e sistemas de incidentes. No XProtect Smart Client – os usuários se beneficiam de resumos clicáveis, e os desenvolvedores podem criar um plug-in com IA para o XProtect para exibir o texto do VLM diretamente no cliente. Diretamente no XProtect Smart, as equipes podem ler resumos de incidentes, saltar para trechos e exportar relatórios.

A nova ferramenta de sumarização de vídeo da Milestone para xprotect® analisa as filmagens e descreve o que é importante. Além disso, o modelo de linguagem visual da Milestone pode ser configurado para enviar um trecho de vídeo e um prompt descrevendo a saída desejada. Então, o modelo irá gerar um resumo em texto e uma pequena linha do tempo com quadros-chave. Esse fluxo de trabalho apoia tanto investigações quanto monitoramento diário. Ademais, as organizações podem adotar um plug-in para o XProtect Smart para habilitar esse recurso dentro das instalações XProtect existentes. A nova sumarização de vídeo da Milestone Systems combina um modelo de linguagem visual de alta precisão com conectores operacionais, e oferece acesso via API a vídeo pronto para produção a parceiros e provedores de serviço.

Para clientes que preferem operação on-prem, a visionplatform.ai complementa esses serviços oferecendo componentes VP Agent on-prem que mantêm o vídeo dentro do ambiente. Além disso, a visionplatform.ai retém o controle dos modelos e logs de auditoria, o que apoia conformidade e preocupações do AI Act da UE. Por fim, a Milestone Systems enfatiza a IA em suas comunicações: “Nosso premiado software XProtect aproveita o poder da IA e de modelos visão-linguagem para proporcionar consciência situacional incomparável e eficiência operacional aos nossos clientes no mundo todo.” (declaração da Milestone).

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

profissionais de gestão de vídeo enfrentam alta carga de trabalho manual, IA pode reduzir tempo de revisão em 30%

Centros de controle relatam sobrecarga de vídeo e revisão manual demorada como realidades diárias. Além disso, os operadores lidam com alarmes, registros e procedimentos, e isso retarda a tomada de decisão sob pressão. Dados do setor indicam que a IA pode reduzir o tempo de revisão em cerca de 30%, e relatos mostram que a sumarização de vídeo poderia reduzir o tempo do operador nessa margem em implantações reais (estudos de caso da Milestone). Portanto, adicionar resumos concisos e pesquisa em linguagem natural altera as cargas de trabalho.

A sumarização orientada por IA resume longas gravações e sinaliza sequências suspeitas para revisão imediata. Consequentemente, os operadores veem menos falsos positivos e passam mais tempo em incidentes verificados. Por exemplo, a Milestone relatou redução de até 40% em alarmes falsos quando a IA e a verificação contextual estão em vigor (redução de falsos alarmes da Milestone). Além disso, benchmarks acadêmicos mostram que VLMs excedem 85% em tarefas complexas de percepção visual, o que sustenta detecção confiável em escala (resultados de pesquisa).

A visionplatform.ai concentra-se em transformar detecções em decisões. Por exemplo, o VP Agent Search permite que equipes executem consultas forenses como “pessoa em permanência suspeita perto do portão fora do horário” em vídeos gravados e retorna resultados legíveis por humanos. Adicionalmente, o VP Agent Reasoning correlaciona eventos de câmera com controle de acesso, procedimentos e contexto histórico para explicar se um alarme é válido. Essa abordagem reduz a carga cognitiva do operador e diminui os passos por incidente.

Porque os sistemas de vídeo capturam enormes quantidades de filmagem, as equipes precisam de triagem automatizada. Além disso, sistemas que combinam descrições VLM em tempo real com ações de agentes podem encerrar falsos alarmes, criar relatórios pré-preenchidos e notificar respondedores. Em suma, adotar inteligência avançada de vídeo e VLMs on-prem dá aos centros de controle as ferramentas para escalar o monitoramento com o mesmo efetivo, e cria um caminho claro da detecção à ação.

modelo de linguagem visual no XProtect Smart Client especializa-se em análise de tráfego

Uma implantação prática de VLM foca no tráfego. Especificamente, um modelo especializado para vídeo de tráfego do mundo real pode identificar colisões, movimentos na contramão e padrões de congestionamento. Além disso, o modelo pode ser afinado nas ângulos de câmera locais para reconhecer marcações de faixa, tipos de veículos e ciclistas em diferentes condições climáticas. O resultado é uma ferramenta de sumarização para vídeo do XProtect que lista eventos-chave, códigos de tempo e curto contexto textual para cada incidente.

Fluxos de trabalho de tráfego se beneficiam de resumos estruturados. Por exemplo, uma ferramenta de sumarização para XProtect permite que usuários enviem um clipe de vídeo curto juntamente com um prompt descrevendo o foco desejado, e o modelo retorna uma lista de incidentes com timestamps. Além disso, esse fluxo de trabalho apoia forças policiais e planejadores urbanos que precisam de extração rápida de evidências e análise de tendências. A ferramenta para vídeo do xprotect® ajuda analistas a revisar eventos de horário de pico e apoia a tomada de decisão em gestão de tráfego.

O modelo de linguagem visual da Milestone usado nesses fluxos é especializado para vídeo de tráfego do mundo real e afinado em conjuntos de dados criteriosamente selecionados. Além disso, a sumarização de vídeo para XProtect permite que os usuários extraiam trechos que mostram infrações ou quase-acidentes, e as equipes podem exportá-los para acompanhamento. Por exemplo, planejadores urbanos podem usar resumos agregados para ajustar tempos de sinalização, e a polícia pode usar os mesmos resumos para priorizar investigações. A visionplatform.ai integra-se ao XProtect para que resumos de incidentes apareçam dentro do XProtect Smart Client e linkem de volta ao segmento gravado completo.

Além disso, o sistema pode enriquecer eventos com saídas de ANPR/LPR e classificação de veículos. Para contexto, veja nosso trabalho de detecção e classificação de veículos em aeroportos, que demonstra saídas em tempo real sobre veículos em movimento (detecção e classificação de veículos em aeroportos). Também, equipes que precisam de busca forense podem estender esses resumos com consultas em texto completo ao longo do tempo usando o VP Agent Search (busca forense em aeroportos).

AI vision within minutes?

With our no-code platform you can just focus on your data, we’ll do the rest

milestone systems relata até 40% de redução em falsos alarmes e 30% mais rápida detecção de incidentes

A Milestone Systems relata melhorias operacionais significativas quando a IA é aplicada ao XProtect. Por exemplo, a nova ferramenta de sumarização de vídeo do sistema e a IA integrada reduziram, segundo relatos, falsos alarmes em até 40% e aceleraram a detecção de incidentes em cerca de 30% em algumas implantações (métricas da Milestone). Além disso, essas cifras estão alinhadas com o feedback de campo de que a automação reduz o tempo-para-ação e aumenta a consciência situacional.

Esses ganhos vêm da combinação das saídas do VLM com motores de regras e verificação contextual. Por exemplo, um evento existente do XProtect pode ser enriquecido por uma descrição do VLM, e então um agente de IA pode perguntar a sistemas complementares se uma leitura de crachá ou um sensor de porta corrobora o evento. Como resultado, o sistema evita enviar alertas brutos que carecem de contexto, e os operadores recebem situações explicadas com ações recomendadas.

Integrações visão-linguagem também melhoram relatórios e conformidade. Especificamente, inteligência de vídeo pronta para produção incorporada em fluxos de trabalho reduz o ônus manual de resumos de incidentes. A plataforma pode criar registros de incidentes estruturados, pré-preencher campos de investigação e exportar pacotes de evidências. Para clientes que trabalham sob restrições regulatórias, manter o vídeo e os modelos on-prem ou em tenancy de nuvem controlada é importante. A abordagem on-prem da visionplatform.ai apoia essa necessidade e complementa as opções em nuvem da Milestone para clientes que preferem serviços hospedados.

Por fim, adicionar inteligência avançada de vídeo ao XProtect apoia objetivos operacionais mais amplos. Por exemplo, equipes de aeroportos que usam contagem de pessoas, ANPR e detecção de intrusão acham que resumos VLM ajudam a correlacionar eventos operacionais com incidentes de segurança (contagem de pessoas). Além disso, ao combinar descrições visuais com metadados, as equipes podem reduzir a carga do operador e focar a atenção humana onde mais importa.

O futuro da gestão de vídeo dependerá de arquiteturas avançadas de modelos visão-linguagem

A pesquisa em arquiteturas de VLM continua a evoluir, e benchmarks como MaCBench impulsionam modelos rumo a raciocínio científico mais forte e compreensão multimodal mais rica (benchmark MaCBench). Além disso, a revisão ICLR 2026 sobre pesquisa visão-linguagem-ação destaca tendências em modelos de difusão e raciocínio que beneficiarão vigilância e IA operacional (análise ICLR VLA). Portanto, integrações futuras do XProtect provavelmente usarão topologias avançadas de modelos visão-linguagem para equilibrar velocidade e precisão.

A Milestone introduziu iniciativas que combinam opções de nuvem e edge, e o conceito hafnia vision language model mostra como os fornecedores planejam oferecer implantações flexíveis. Adicionalmente, conceitos como VLM como serviço e modelo de linguagem como serviço permitirão que integradores escolham modelos hospedados ou on-prem dependendo das necessidades de conformidade. Para clientes que precisam de controle total no local, a visionplatform.ai oferece capacidades VP Agent on-prem que mantêm o vídeo bruto local e ainda assim entregam acesso à inteligência de vídeo pronta para produção.

Olhando adiante, plataformas avançadas de IA para vídeo suportarão fluxos de trabalho de agentes mais ricos. Por exemplo, agentes raciocinarão sobre linhas do tempo, registros de controle de acesso e SOPs para recomendar ações. Isso transforma detecções em decisões e cria um caminho impactante para transformar vídeo em resultados acionáveis. Além disso, os desenvolvedores poderão adicionar recursos avançados de inteligência de vídeo ao XProtect via APIs e plugins, e o ecossistema da Milestone tornará simples acrescentar esses recursos a aplicações.

Finalmente, à medida que a precisão dos modelos melhora, a adoção acelera. Os primeiros adotantes já veem benefícios mensuráveis, e conforme os benchmarks e ferramentas amadurecem, o software de gestão de vídeo XProtect integrará raciocínio multimodal em toda a operação. Em suma, combinar VLMs com uma arquitetura VMS robusta definirá a próxima geração de sistemas de vigilância por vídeo e IA operacional.

FAQ

O que é um modelo de linguagem visual e como ele funciona com o XProtect?

Um modelo de linguagem visual (VLM) processa entradas visuais e gera saídas em linguagem natural que descrevem o que aparece no vídeo. No XProtect, um VLM pode produzir resumos, legendas e descrições pesquisáveis que aparecem no XProtect Smart Client ou via APIs.

Os resumos de VLM realmente podem substituir a revisão manual de vídeo?

Resumos de VLM reduzem a quantidade de vídeo que um analista precisa assistir ao destacar momentos-chave e criar relatórios concisos. Além disso, esses resumos aceleram a triagem e permitem que os operadores se concentrem em incidentes verificados em vez de filmagens brutas.

A Milestone Systems oferece VLMs como parte do XProtect?

A Milestone Systems introduziu capacidades de VLM e serviços relacionados para o XProtect, e a empresa relata reduções mensuráveis em falsos alarmes e detecção mais rápida em implantações (métricas da Milestone). Além disso, a Milestone fornece opções de nuvem e integrações para parceiros e integradores.

Como a visionplatform.ai complementa o Milestone XProtect?

A visionplatform.ai fornece VLMs on-prem, raciocínio de agentes e busca forense em linguagem natural que se integram estreitamente ao XProtect. Além disso, nossa VP Agent Suite transforma detecções em contexto e ações recomendadas enquanto mantém vídeo e modelos sob controle do cliente.

Que melhorias de desempenho as organizações podem esperar?

Relatos de campo indicam até 40% menos falsos alarmes e cerca de 30% mais rápida detecção de incidentes quando IA e resumos de VLM são aplicados. Além disso, estudos acadêmicos mostram forte precisão de percepção em VLMs modernos (pesquisa).

Os VLMs são adequados para gerenciamento de tráfego?

Sim. Modelos especializados para vídeo de tráfego do mundo real podem detectar colisões, congestionamento e infrações, e geram resumos contextuais para apoiar polícia e planejamento urbano. Além disso, esses resumos ajudam a otimizar tempos de sinalização e alocação de recursos.

Os VLMs podem rodar on-prem para locais sensíveis à conformidade?

Podem. A visionplatform.ai e algumas integrações da Milestone suportam implantação on-prem para manter soberania dos dados, cumprir o AI Act da UE e evitar o envio de vídeo bruto para nuvens externas. Isso preserva trilhas de auditoria e controle.

Como integro resumos de VLM em fluxos de trabalho existentes do XProtect?

Integrações geralmente usam as APIs e SDKs da Milestone, ou um plug-in com IA para o XProtect que exibe os resumos dentro do XProtect Smart Client. Desenvolvedores também podem chamar serviços VLM via APIs REST para recuperar resumos e vinculá-los a incidentes.

O que dizer sobre treinamento de modelos e requisitos de conjuntos de dados?

VLMs de alta qualidade precisam de dados de vídeo diversos e anotados e de fine-tuning cuidadoso para vistas de câmera específicas do local; modelos especializados para vídeo de tráfego do mundo real e afinados em conjuntos de dados criteriosamente curados têm o melhor desempenho. Além disso, fornecedores podem oferecer modelos pré-treinados e ferramentas para refiná-los com dados locais.

Onde posso aprender mais sobre busca forense e integração de detecção de veículos?

Veja nossos recursos sobre busca forense em aeroportos para busca de vídeo em linguagem natural e nossa página de detecção e classificação de veículos para saber como resumos de VLM se combinam com metadados em investigações (busca forense, detecção de veículos). Além disso, nossa página de contagem de pessoas mostra como resumos podem apoiar analytics operacionais (contagem de pessoas).